登录MaxCompute控制台,在左上角选择地域。

在左侧导航栏,选择。

在迁移服务页面,单击数据源页签。

在迁移服务页面,单击迁移作业页签。

在迁移服务页面,单击定时任务页签。

在迁移服务页面,单击迁移观测页签。

数据源页签

在数据源页签,单击新增数据源。

在弹出的MaxCompute服务关联角色对话框中,单击确认,即可创建成功。若未自动弹出该对话框,则表明该角色已创建。

在新增数据源页面,配置数据源信息,然后单击新增,完成数据源创建。

Databricks

数据源基本信息

参数名

是否必填

说明

数据源名称

是

数据源名称,可自定义,不能包含字符、数字、汉字之外的特殊字符。

数据源类型

是

选择Databricks。

网络连接

是

选择需要使用的网络连接。

网络连接在MaxCompute 模块创建,用于MMS与VPC通信,最终连接数据源。

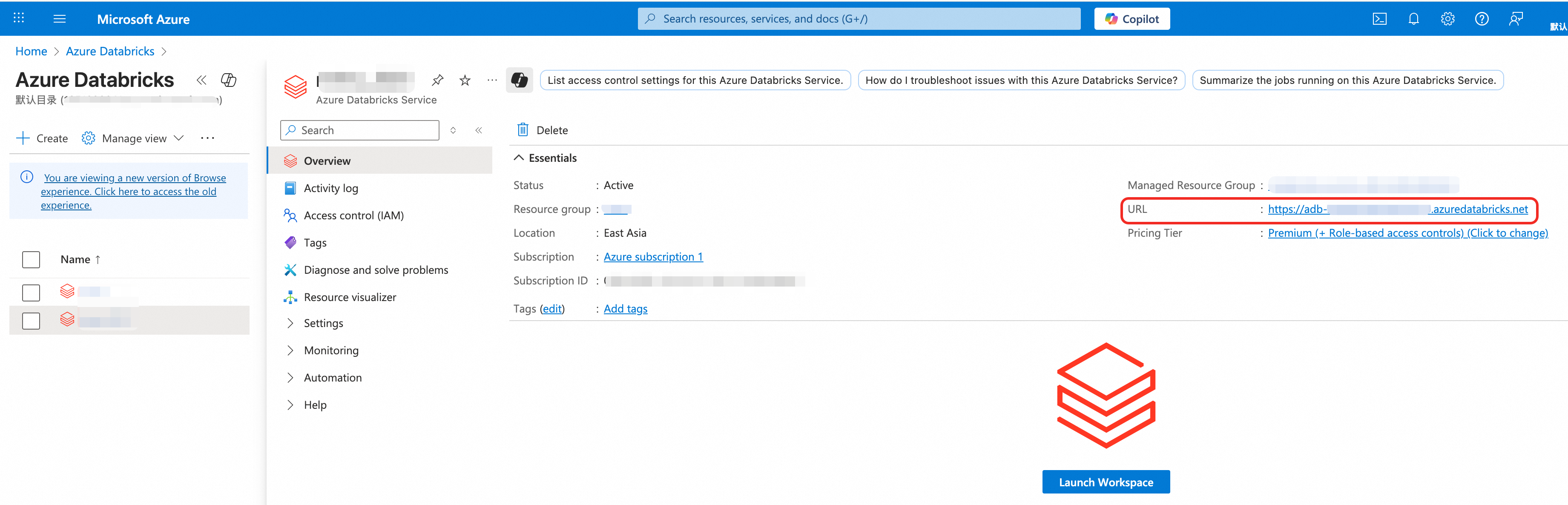

Databricks Workspace URL

是

Databricks的URL地址,可以从Azure portal的Databricks菜单进入相应的Databricks实例查看。

Databricks Unity Catalog名称

是

待迁移的Databricks Unity Catalog,一个MMS数据源只能迁移一个Databricks Unity Catalog。

Databricks集群ID

是

Databricks集群的ID,拉取元数据过程中需要使用该集群执行SQL。

Databricks访问令牌

是

Databricks的个人访问令牌,可以参考Databricks personal access token authentication创建。

使用Databricks JDBC读UnitCatalog里的表

否

是否通过Databricks JDBC读Databricks表。

Azure Authentication

是

SAS:通过Azure Storage Account的SAS访问Storage Account。

Azure Storage Account SAS令牌: 参考Azure官网创建。

Service Principal:通过Azure的Service Principal访问Storage Account。

Azure应用ID

Azure App Client Secret

Azure租户ID

默认目标MaxCompute项目

是

数据迁移时选择映射的目标项目,不可修改。

目标MaxCompute项目列表

否

若一个数据源的数据需要迁移到多个目标项目,需配置目标MaxCompute项目列表。

MaxCompute执行迁移作业的项目

是

迁移过程中,执行在MaxCompute上发起的Spark、SQL等迁移作业的项目,并使用该项目关联的默认计算Quota。

其他信息

参数名

说明

Jdbc page size

默认为100000。

Metastore定时更新

数据源元数据是否定时拉取。取值说明如下:

启用:定时拉取,更新周期支持每天和每小时,支持配置更新开始时间。

每日更新:定时器每天运行一次,运行时刻为选定的24小时内的某一时间(精确到分钟)。

每小时更新:定时器每小时运行一次,运行时刻为选定的60分钟内的某一分钟。

禁用:不定时拉取。

Metastore访问并发量

访问MetaStore的并发量。

Schema白名单

需要迁移的Schema,多个值之间以半角逗号(,)分隔。

Schema黑名单

不需要迁移的Schema,多个值之间以半角逗号(,)分隔。

表黑名单

不需要迁移的Databricks数据表。

单个表的格式为

schema.table或table,多个表之间以半角逗号(,)分隔。表白名单

需要迁移的Databricks数据表。

单个表的格式为

schema.table或table,多个表之间以半角逗号(,)分隔。数据搬迁任务最大并发量

MMS最大迁移任务的并发量。过大的并发量可能造成Databricks的计算负载压力过大。默认20。

MaxCompute迁移任务sql参数

SQL参数。参考Flag参数列表。

表名字符转换配置

格式为JSON,如{"%": "_"}用于将源table里的特殊字符映射为MaxCompute支持的字符。

单个任务处理的最多分区数量

默认50。即一次MMA任务迁移的分区数量,通过批量的分区迁移,可以减少提交SQL的次数,节约SQL提交时间。一般不需要修改。

单个任务处理的最大数量(单位G)

默认5G。一般不需要修改。

分区特殊字符映射

格式为JSON,如{"/": "_"}用于将源分区值中的特殊字符映射为MaxCompute支持的字符。

Hive

数据源基本信息

参数名

是否必填

说明

数据源名称

是

数据源名称,可自定义,不能包含字符、数字、汉字之外的特殊字符。

数据源类型

是

选择Hive。

网络连接

是

选择需要使用的网络连接。

网络连接在MaxCompute 模块创建,用于MMS与VPC通信,最终连接数据源。

元数据服务类型

是

HMS:默认的元数据管理服务

hive meta server,该类型需填写如下参数。Metastore地址

AWS-GLUE:统一元数据管理服务

Glue,该类型需填写如下参数。AWS 地域

AWS Access Key Id

AWS Access Key Secret

存储服务类型

是

可多选:当元数据服务类型为

AWS-GLUE时不支持ALIYUN-OSS。HDFS

ALIYUN-OSS,该类型需填写如下参数。

OSS Endpoint

OSS Access Id

OSS Access Key

AWS-S3:填写用于连接AWS-S3的S3 Endpoint。

Hive版本

是

根据实际情况选择。

Jdbc连接串

否

Hive JDBC的连接信息。格式为

jdbc:hive2://localhost:10000/default。Jdbc用户名

否

Hive JDBC的用户名。

Jdbc密码

否

Hive JDBC的密码。

maxcompute 迁移任务sql参数

否

SQL参数。参考Flag参数列表。

默认目标MaxCompute项目

是

数据迁移时选择映射的目标项目,不可修改。

目标MaxCompute项目列表

否

若一个数据源的数据需要迁移到多个目标项目,需配置目标MaxCompute项目列表。

MaxCompute执行迁移作业的项目

是

迁移过程中,执行在MaxCompute上发起的Spark、SQL等迁移作业的项目,并使用该项目关联的默认计算Quota。

Kerberos信息

参数名

说明

Kerberos认证

Hive metastore是否开启了Kerberos认证。若开启,则需要填写Kerberos Principal。

Kerberos Principal

Kerberos身份认证标识。与krb5.conf里的kdc_realm值保持一致。

其他信息

参数名

说明

Hive Job配置

用于mr, spark, tez等引擎

Metastore定时更新

数据源元数据是否定时拉取。取值说明如下:

启用:定时拉取,更新周期支持每天和每小时,支持配置更新开始时间。

每日更新:定时器每天运行一次,运行时刻为选定的24小时内的某一时间(精确到分钟)。

每小时更新:定时器每小时运行一次,运行时刻为选定的60分钟内的某一分钟。

禁用:不定时拉取。

Metastore访问并发量

访问MetaStore的并发量,默认为3。

库白名单

需要迁移的Schema,多个值之间以半角逗号(,)分隔。

库黑名单

不需要迁移的Schema,多个值之间以半角逗号(,)分隔。

表黑名单

不需要迁移的Hive数据表。

单个表的格式为

schema.table或table,多个表之间以半角逗号(,)分隔。表白名单

需要迁移的Hive数据表。

单个表的格式为

schema.table或table,多个表之间以半角逗号(,)分隔。数据搬迁任务最大并发量

MMS最大迁移任务的并发量。过大的并发量可能造成Databricks的计算负载压力过大。默认20。

表名字符转换配置

格式为JSON,如{"%": "_"}用于将源表里的特殊字符映射为MaxCompute支持的字符。

单个任务处理的最多分区数量

默认50。即一次MMA任务迁移的分区数量,通过批量的分区迁移,可以减少提交SQL的次数,节约SQL提交时间。一般不需要修改。

单个任务处理的最大数量(单位G)

默认5G。一般不需要修改。

分区特殊字符映射

格式为JSON,如{"/": "_"}用于将源分区值中的特殊字符映射为MaxCompute支持的字符。

Spark访问hadoop用户名

简单鉴权模式下,默认使用admin作为Spark访问Hadoop的用户名,也可通过此参数指定。

默认非法分区名

Hive的默认非法分区名称。

BigQuery

数据源基本信息

参数名

是否必填

说明

数据源名称

是

数据源名称,可自定义,不能包含字符、数字、汉字之外的特殊字符。

数据源类型

是

选择BigQuery。

网络连接

是

选择需要使用的网络连接。

网络连接在MaxCompute 模块创建,用于MMS与VPC通信,最终连接数据源。

服务账号密钥文件

是

BigQuery服务账号的密钥文件。

可以通过BigQuery IAM控制台创建服务账号,下载鉴权JSON,详情请参见服务账号概述。

项目 ID

是

待迁移的BigQuery项目名称。

默认目标MaxCompute项目

是

数据迁移时选择映射的目标项目,不可修改。

目标MaxCompute项目列表

否

若一个数据源的数据需要迁移到多个目标项目,需配置目标MaxCompute项目列表。

MaxCompute执行迁移作业的项目

是

迁移过程中,执行在MaxCompute上发起的Spark、SQL等迁移作业的项目,并使用该项目关联的默认计算Quota。

其他信息

参数名

说明

范围分区表迁移方式

BigQuery范围分区表迁移方式。

默认值为Partition。

Cluster。

压缩类型

BigQuery数据的压缩类型。

Bignumeric 类型默认 precision

BigQuery Bignumeric类型数据的精度值,默认值为38。

Bignumeric 类型默认 scale

BigQuery Bignumeric类型数据的小数位数,默认值为18。

MC Auto Partition

自动分区(暂不支持,请先关闭)。

Force the Use of Append 2.0 Table

强制目标表使用Append2.0(暂不支持,请先关闭)。

BigQuery Execution Project

BigQuery端执行作业的Project名称。

Metastore定时更新

数据源元数据是否定时拉取。取值说明如下:

启用:定时拉取,更新周期支持每天和每小时,支持配置更新开始时间。

每日更新:定时器每天运行一次,运行时刻为选定的24小时内的某一时间(精确到分钟)。

每小时更新:定时器每小时运行一次,运行时刻为选定的60分钟内的某一分钟。

禁用:不定时拉取。

Metastore访问并发量

访问MetaStore的并发量。

库白名单

需要迁移的BigQuery数据库,多个库之间以半角逗号(,)分隔。

库黑名单

不需要迁移的BigQuery数据库,多个库之间以半角逗号(,)分隔。

表黑名单

不需要迁移的BigQuery数据表。

单个表的格式为

dbname.tablename,多个表之间以半角逗号(,)分隔。表白名单

需要迁移的BigQuery数据表。

单个表的格式为

dbname.tablename,多个表之间以半角逗号(,)分隔。数据搬迁任务最大并发量

根据需要配置。

MaxCompute迁移任务sql参数

SQL参数。参考Flag参数列表。

表名字符转换配置

表名字符映射,如BigQuery的表名中的中划线

-映射为MaxCompute表名下划线_。

MaxCompute

数据源基本信息

参数名

是否必填

说明

数据源名称

是

数据源名称,可自定义,不能包含字符、数字、汉字之外的特殊字符。

数据源类型

是

选择MaxCompute。

网络连接

是

选择需要使用的网络连接。

网络连接在MaxCompute 模块创建,用于MMS与VPC通信,最终连接数据源。

MaxCompute区域

是

选择数据源所在的区域。

阿里云主账号id

是

源项目阿里云主账号UID。

MaxCompute源项目

是

待迁移的项目名称。

执行Maxcompute源端校验Sql的Project

否

选择目标执行迁移作业的项目。

默认目标MaxCompute项目

是

数据迁移时选择映射的目标项目,不可修改。

目标MaxCompute项目列表

否

若一个数据源的数据需要迁移到多个目标项目,需配置目标MaxCompute项目列表。

MaxCompute执行迁移作业的项目

是

迁移过程中,执行在MaxCompute上发起的Spark、SQL等迁移作业的项目,并使用该项目关联的默认计算Quota。

其他信息

参数名

说明

数据传输服务 Quota Name

源端独享数据传输服务资源组名称。

如果在源端使用Storage API,需填写源端数据传输服务Quota Name:

预付费方式为自定义一级Quota名称。

后付费方式Quota Name为:pay-as-you-go。

使用Vpc Endpoint访问源MaxCompute

是否启用VPC网络进行数据迁移。

Metastore定时更新

数据源元数据是否定时拉取。取值说明如下:

启用:定时拉取,更新周期支持每天和每小时,支持配置更新开始时间。

每日更新:定时器每天运行一次,运行时刻为选定的24小时内的某一时间(精确到分钟)。

每小时更新:定时器每小时运行一次,运行时刻为选定的60分钟内的某一分钟。

禁用:不定时拉取。

元数据访问并发量

访问MaxCompute MetaStore的并发量,用于提高获取MaxCompute元数据的速度。

Schema白名单

需要迁移的Schema,多个值之间以半角逗号(,)分隔。

Schema黑名单

不需要迁移的Schema,多个值之间以半角逗号(,)分隔。

Table黑名单

不需要迁移的MaxCompute数据表。

单个表的格式为

schema.table或table,多个表之间以半角逗号(,)分隔。Table白名单

需要迁移的MaxCompute数据表。

单个表的格式为

schema.table或table,多个表之间以半角逗号(,)分隔。数据搬迁任务最大并发量

数据迁移并发量,默认为20。

MaxCompute迁移任务sql参数

SQL参数。参考Flag参数列表。

单个任务处理的最多分区数量

默认50。即一次MMA任务迁移的分区数量,通过批量的分区迁移,可以减少提交SQL的次数,节约SQL提交时间。一般不需要修改。

单个任务处理的最大数量(单位G)

默认5G。一般不需要修改。

在数据源页签,单击目标数据源对应的操作列的更新元数据。

在数据源页签,可以查看目标数据源的运行状态。