混合云劣化网络下云产品服务能力分析

本实践主要分析在网络时延增大、传输带宽降低、网络丢包率增高三种网络劣化场景下,混合云云产品对外服务能力的变化趋势。其场景适用于项目交付阶段的云产品服务质量评测,用于检测混合云网络在不同劣化程度时,正常提供服务、服务概率性异常、无法提供服务等多种服务分级能力。

前提条件

云平台部署均到达终态,包括云服务器ECS、专有网络VPC、分布式块存储EBS、分布式对象存储OSS。

云平台版本基于企业版V3.12及以上版本。

方案架构

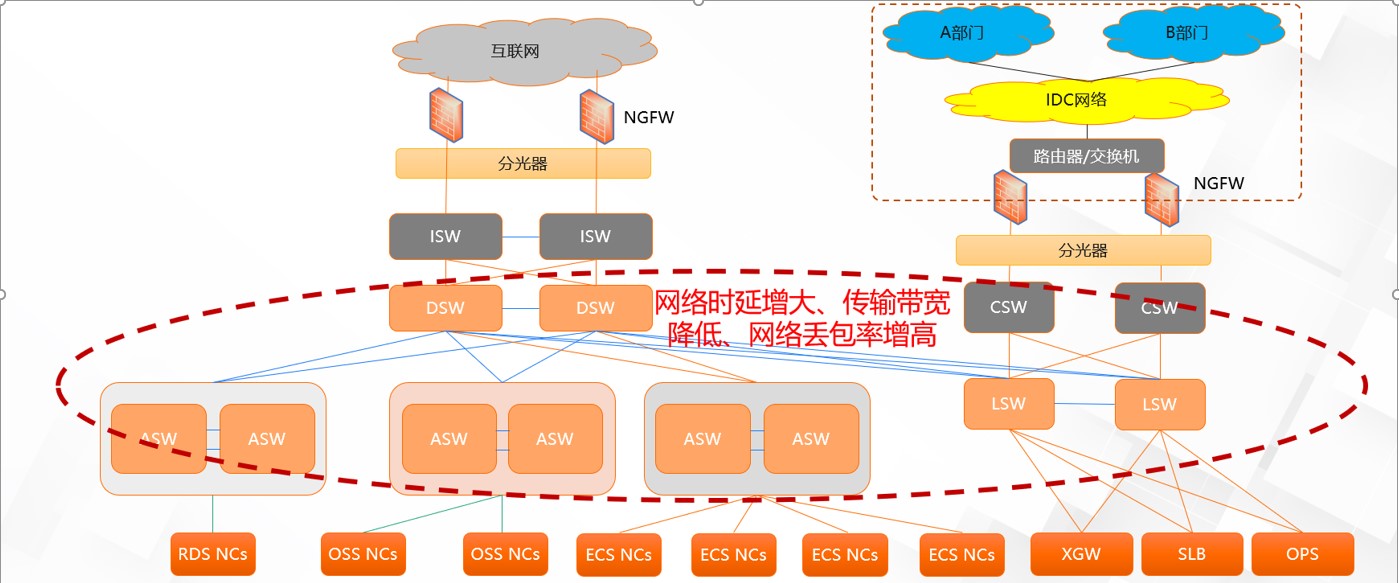

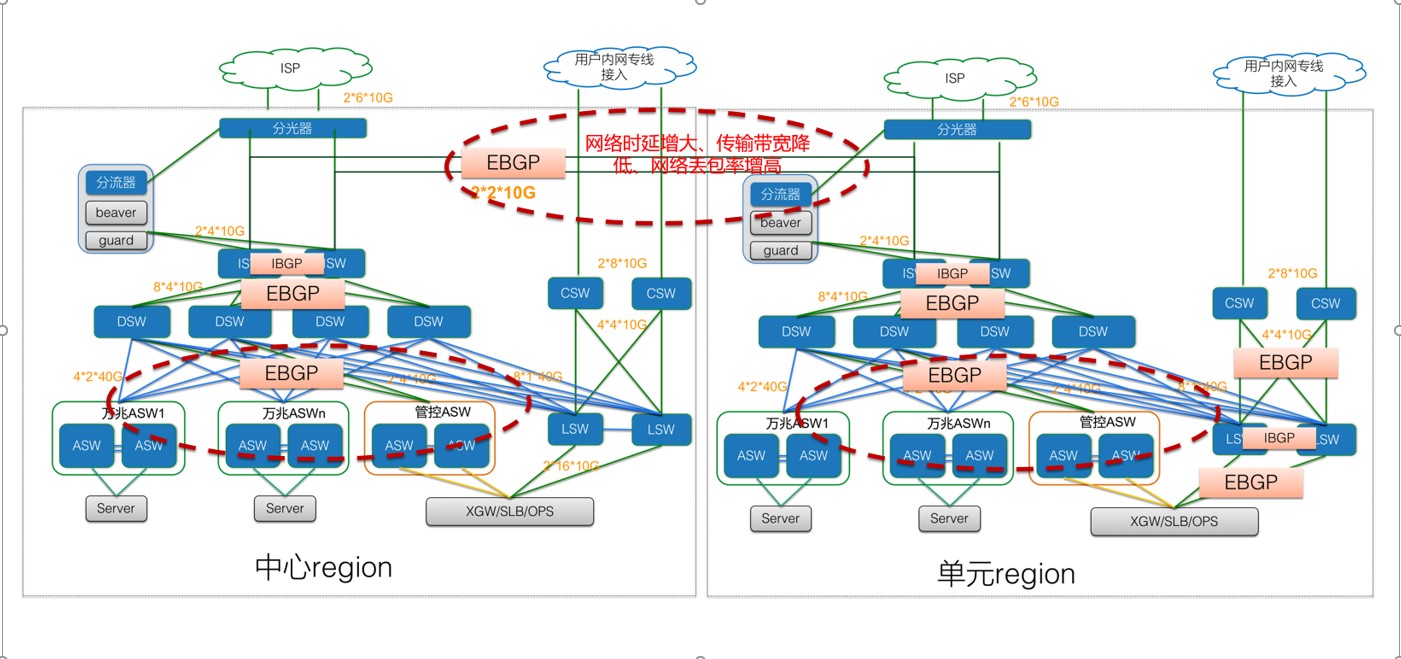

图一:混合云单region劣化网络示意图 混合云单region组网下,混合云网络中出现网络设备故障、老化、端口接续不良等异常情况,导致网络传输带宽降低、丢包率升高、传输时延增大,进而影响云产品对外服务能力发生降级。

混合云单region组网下,混合云网络中出现网络设备故障、老化、端口接续不良等异常情况,导致网络传输带宽降低、丢包率升高、传输时延增大,进而影响云产品对外服务能力发生降级。

针对该情况,通过本实验构建混合云云产品网络服务质量评测方案,量化评定混合云单region网络在遭遇劣化时的云产品服务能力。

图二:混合云多region劣化网络示意图

混合云多region组网下,混合云跨region网络中出现网络设备故障、老化、端口接续不良等异常情况,导致网络传输带宽降低、丢包率升高、传输时延增大,进而影响云产品对外服务能力发生降级。

针对该情况,通过本实验构建混合云云产品网络服务质量评测方案,量化评定混合云多region网络在遭遇劣化时的云产品服务能力。

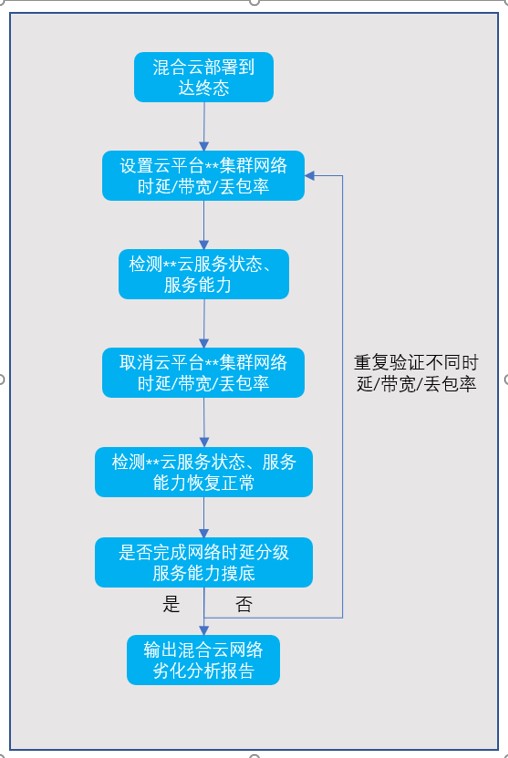

图三:混合云劣化网络云产品服务检测方案流程图

混合云劣化网络云产品服务检测方案步骤:

混合云平台部署到达终态,各产品服务到达终态,无异常服务和告警。

在云产品集群配置时延、带宽、丢包率参数,触发到达该集群的网络报文增加时延、降低带宽、增大丢包率。

通过Apsara Uni-manager运营控制台进行云产品服务发放和使用,检测云服务状态是否正常,通过业务测试检测业务操作是否正常。

在云产品集群的物理服务器网卡上取消时延、带宽丢包率参数。

重复步骤2-4,验证不同时延、带宽、丢包率参数,评估云产品服务劣化程度。

完成混合云网络劣化分析报告。

注意事项

该方案使用会影响系统稳定性和高可用性,需在无业务环境使用。

如在业务环境使用该方案会导致业务受损,禁止带业务局点使用。

步骤一:网络时延劣化场景

计算集群网络时延劣化配置。

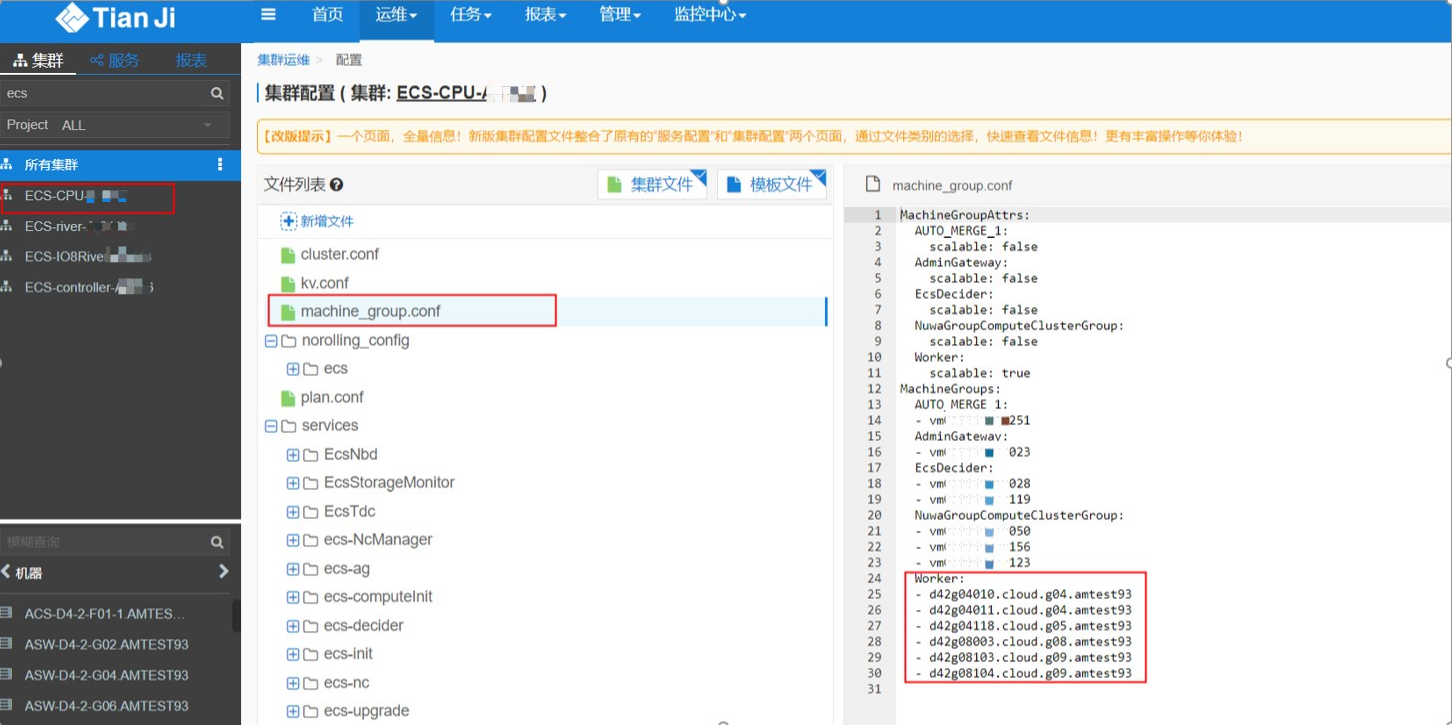

环境信息获取。

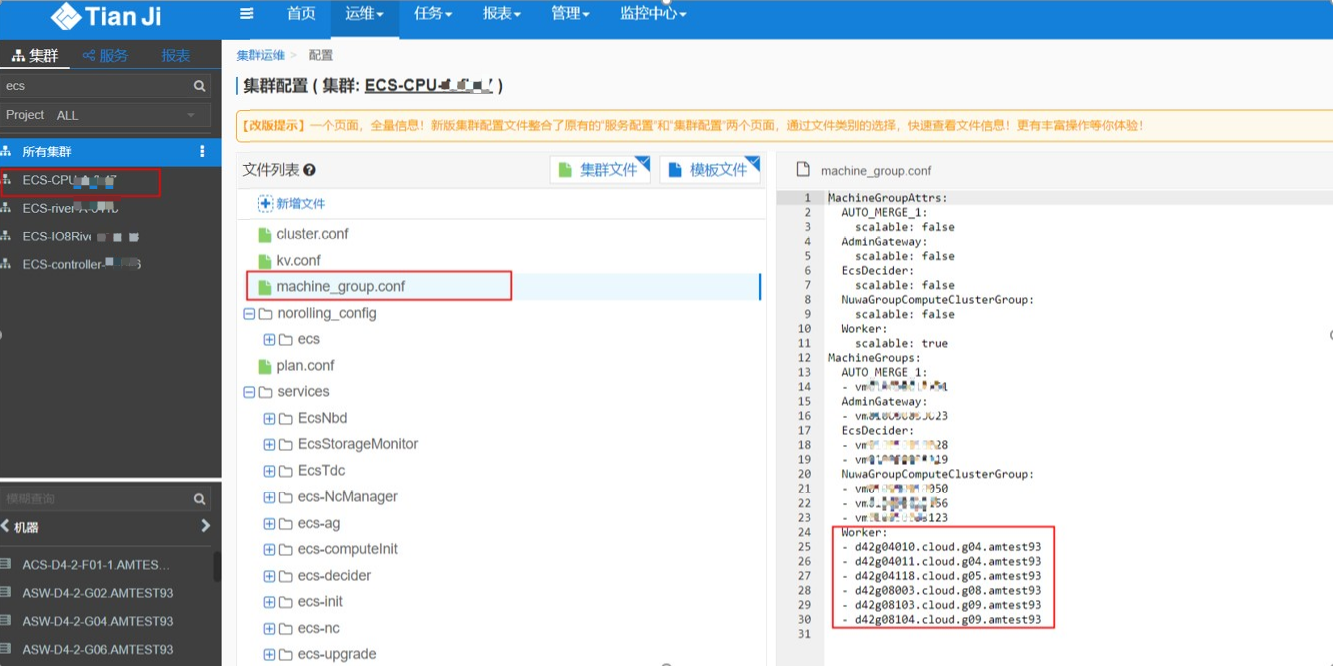

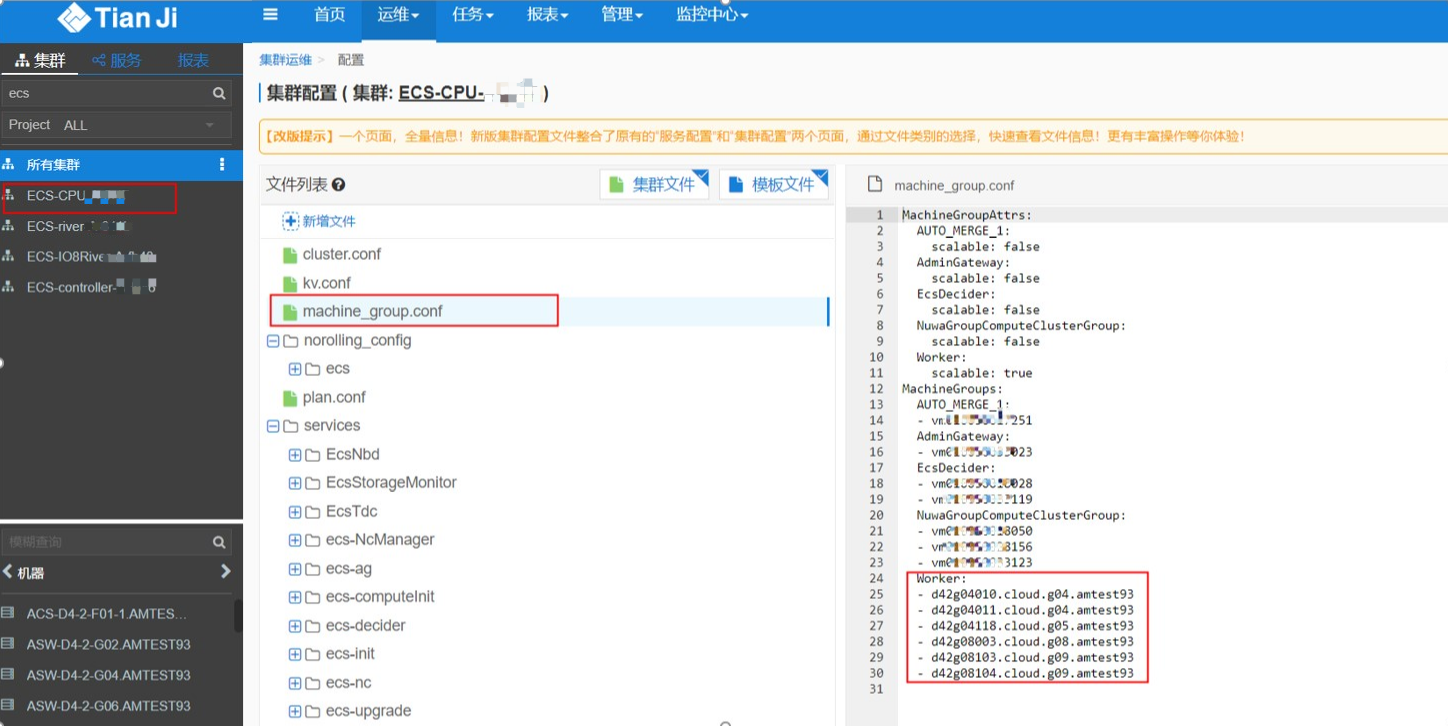

登录天基运维控制台,查找名称为ECS-CPU-*的集群,选择集群配置文件,选择machine_group.conf,记录计算集群Worker物理服务器主机名。

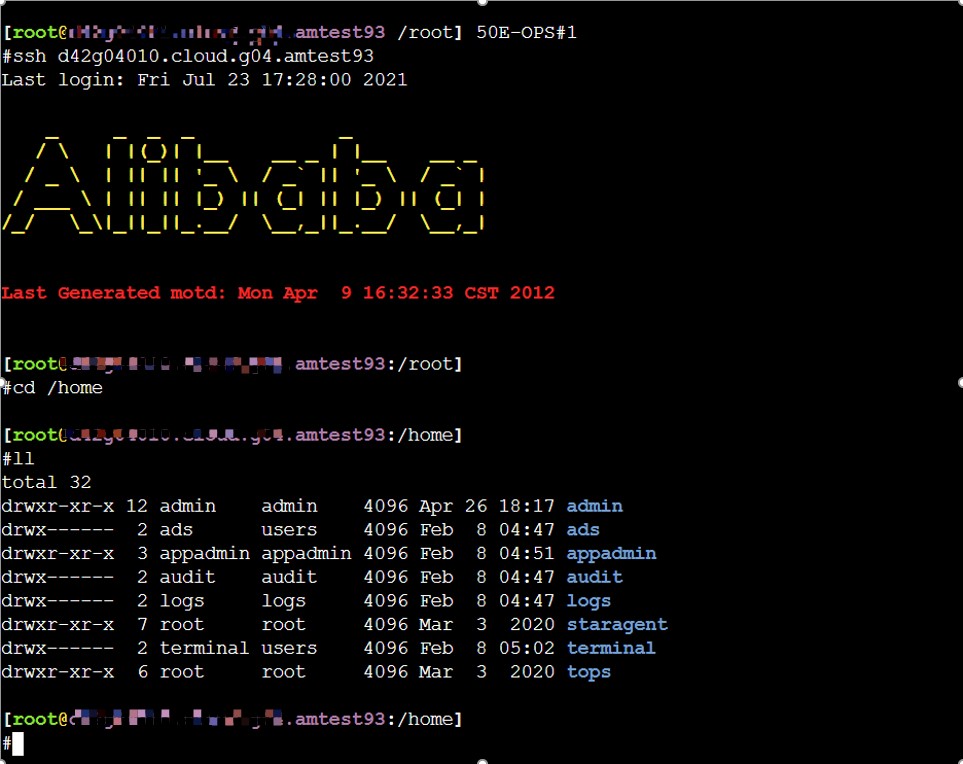

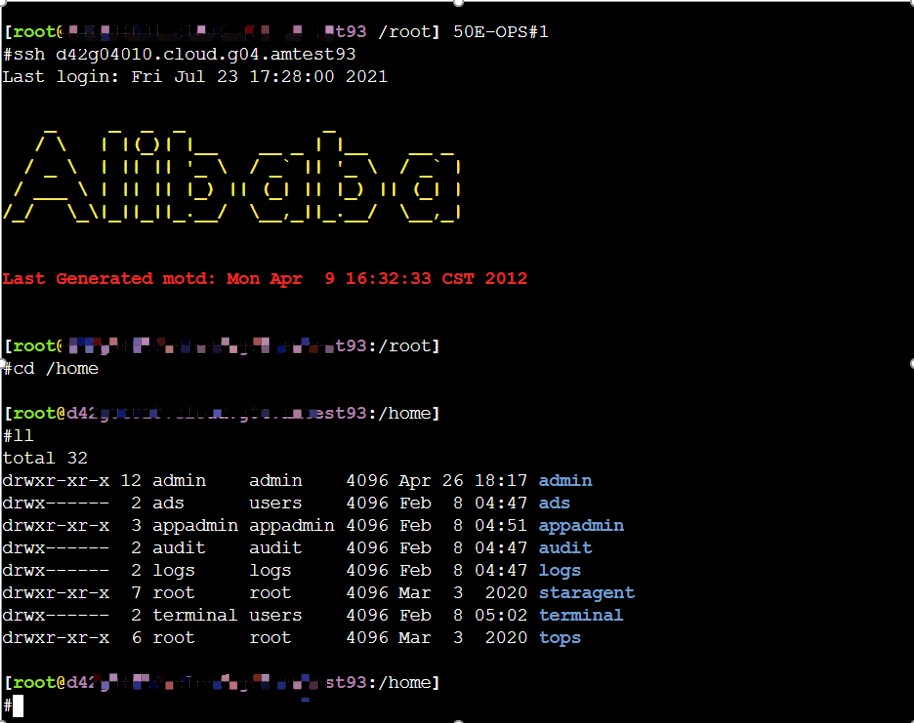

逐个登录配置文件中的各计算集群物理服务器,执行下文步骤ii.网络时延劣化设置到下文步骤iv.网络时延劣化检测。下图为通过OPS集群登录计算节点。

网络时延劣化设置。

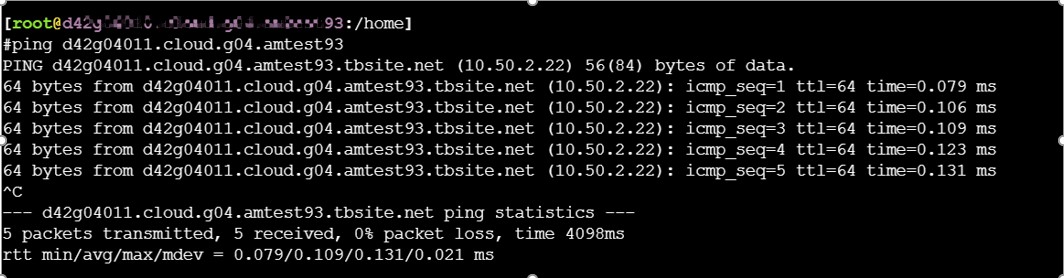

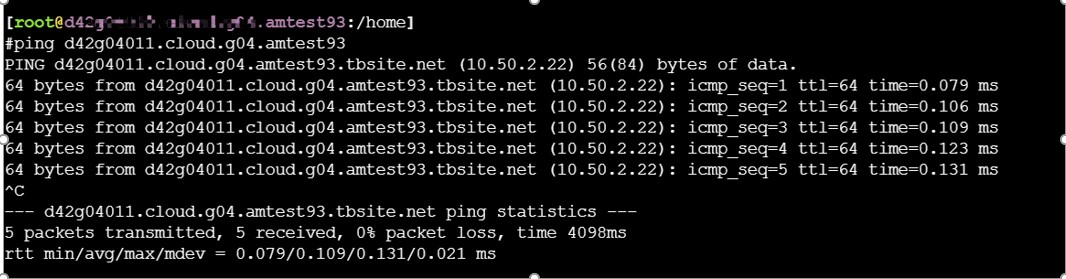

在计算节点1执行ping操作,检查计算集群物理服务器之间的时延情况为1毫秒以下:

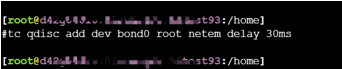

配置命令如下,如执行如下命令配置物理服务器网卡时延30毫秒:

tc qdisc add dev bond0 root netem delay 30ms。

网络时延劣化修改。

执行如下命令修改物理服务器网卡时延为40毫秒:

tc qdisc change dev bond0 root netem delay 40ms。

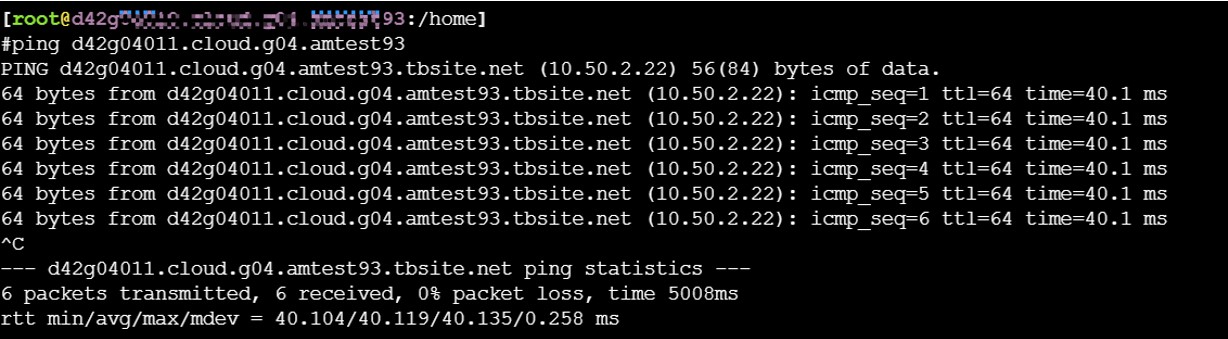

网络时延劣化检测。

在计算节点1执行ping操作,检查计算集群物理服务器之间时延增加到40毫秒:

云产品服务检测。

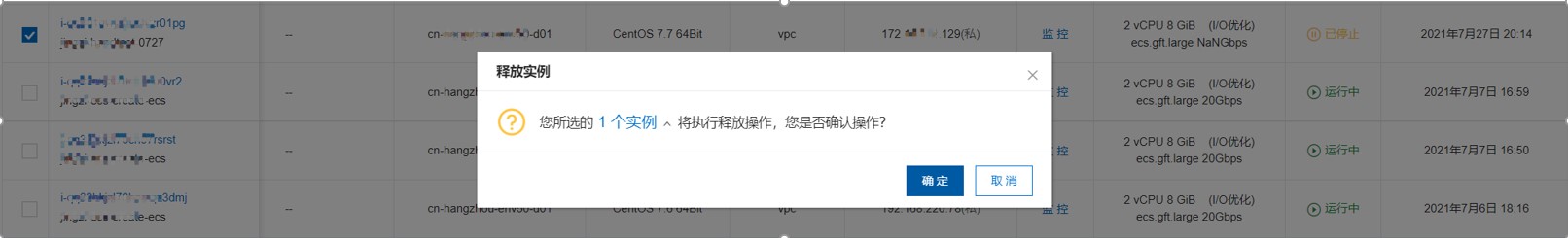

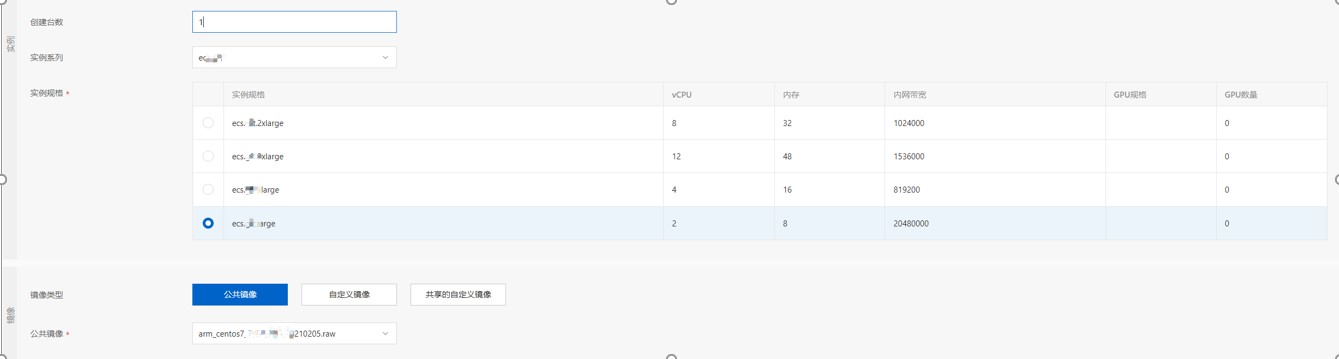

创建云服务实例。

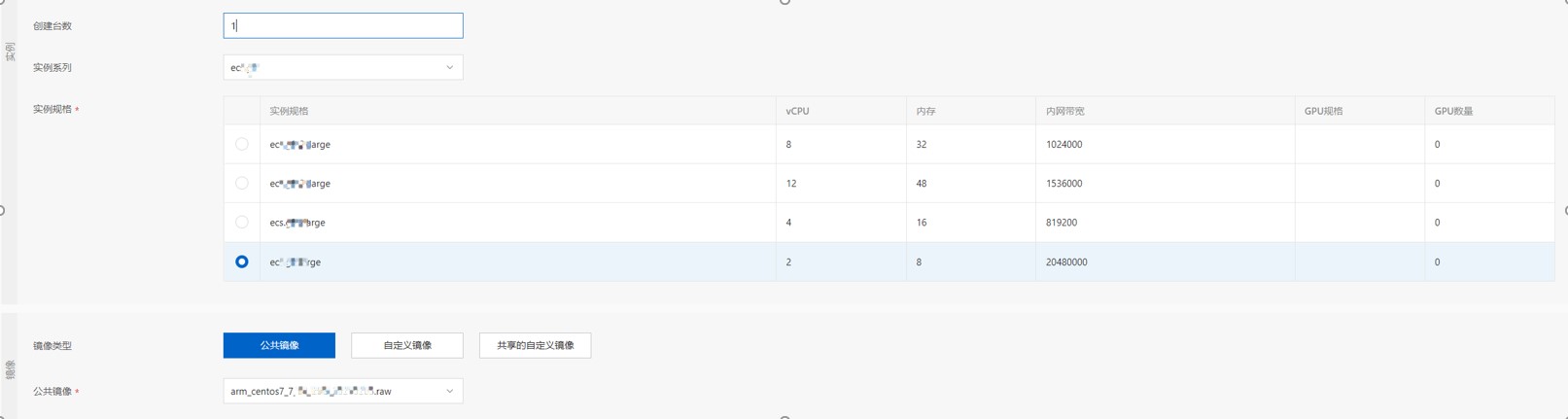

登录Apsara Uni-manager运营控制台,创建1台云服务器:

检查1台云服务器是否创建成功:

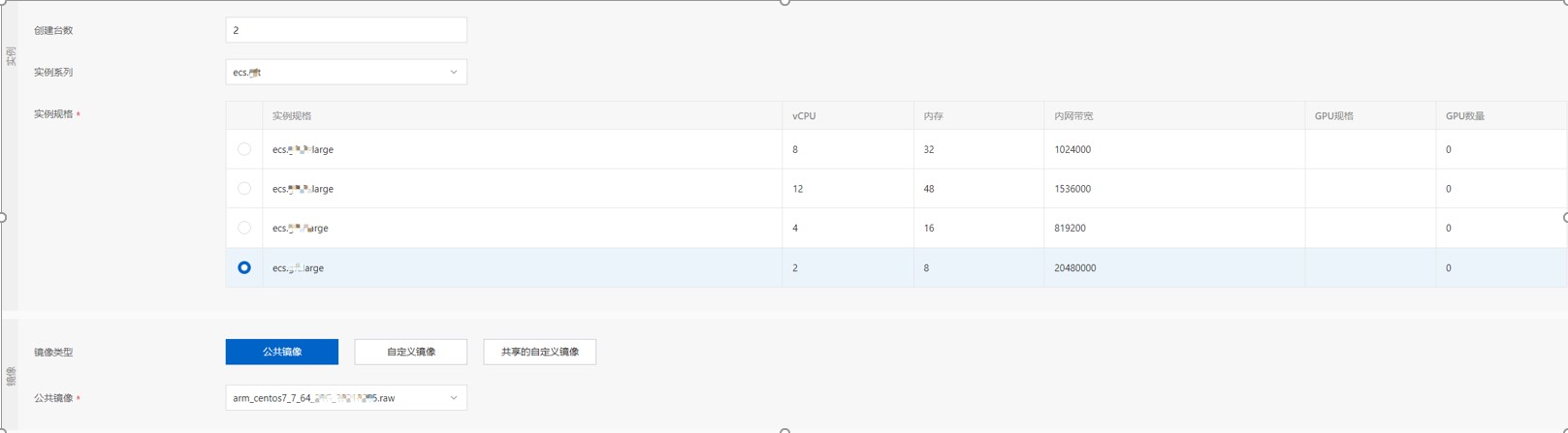

登录Apsara Uni-manager运营控制台,创建N台云服务器:

检查N台云服务器是否创建成功(在设置网络时延逐步增大的过程中,创建云服务器会概率性出现创建失败情况):

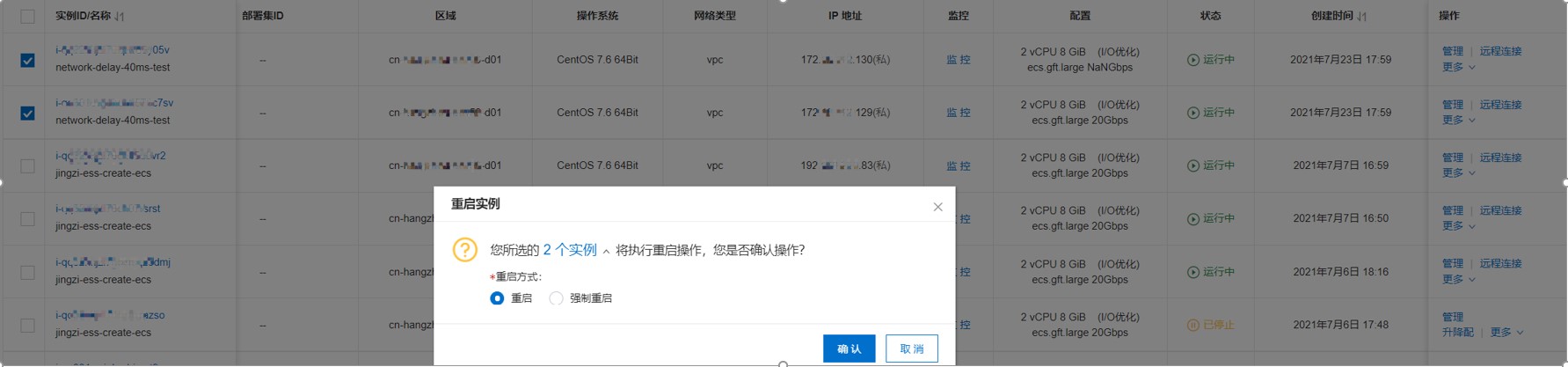

云服务实例生命周期管理。

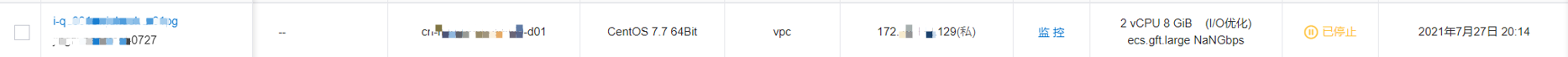

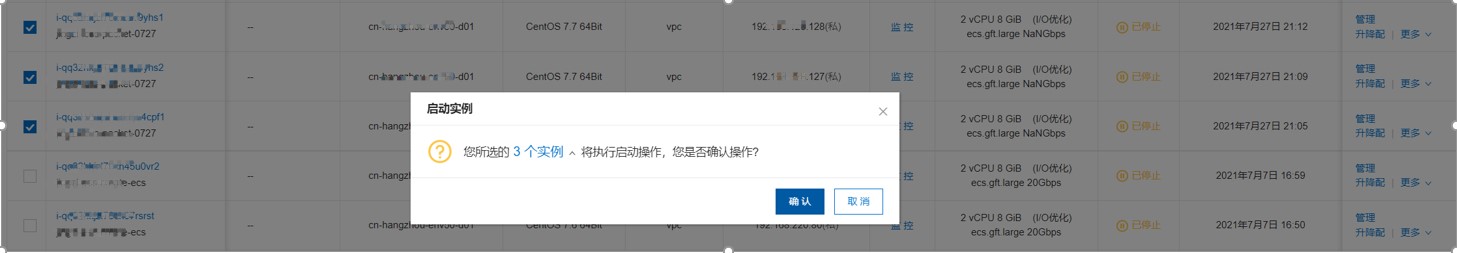

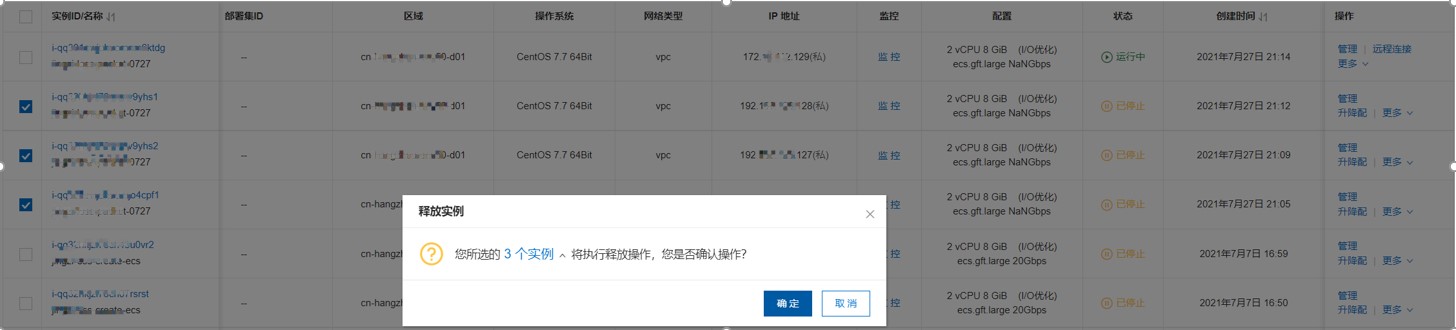

检测云服务器停止是否成功:

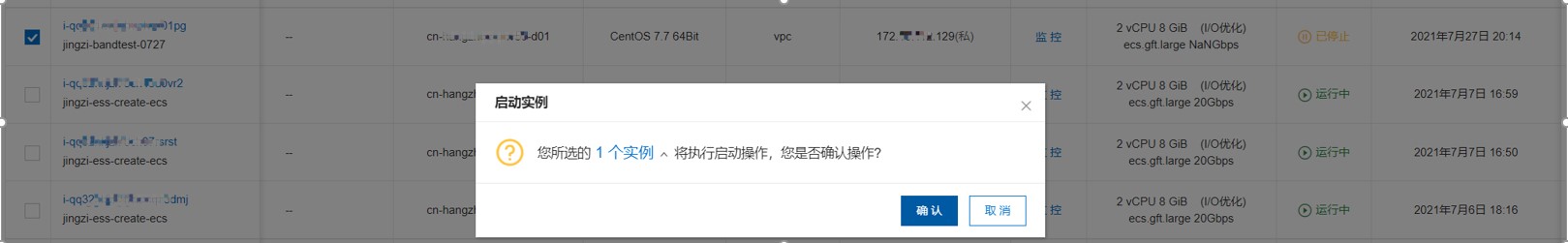

检测云服务器启动是否成功:

检测云服务器重启是否成功:

检测云服务器删除是否成功:

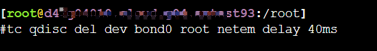

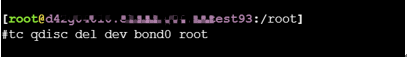

网络时延劣化取消。

执行如下命令取消物理服务器网卡时延:

tc qdisc del dev bond0 root netem delay 40ms。

网络时延劣化循环设置。

经过步骤一:网络时延劣化场景下的:计算集群网络时延劣化设置到上一步骤中:网络时延劣化取消操作,完成一次完整混合云网络时延劣化云产品服务能力分析。

设置不同网络时延,重复步骤a,记录不同网络时延下云产品服务能力变化趋势。

网络时延劣化检测输出。

网络时延劣化检测汇总。

测试编号

云服务集群

单台服务器时延范围

云服务

单台创建

10台创建

10台停止

10台启动

10台重启

10台删除

1

计算集群

0ms<时延<70ms

成功

成功

成功

成功

成功

成功

2

计算集群

70ms<时延<250ms

成功

成功

成功

成功

成功

成功

3

计算集群

250ms<时延

成功

概率性失败

概率性失败

概率性失败

概率性失败

概率性失败

网络时延劣化检测分析。

经过计算集群的网络时延劣化测试,验证在某混合云环境中:

计算集群单台物理服务器出现小于70 ms时延时,云计算产品对外提供服务能力正常,正常支持业务应用使用。

计算集群单台物理服务器出现70 ms至250 ms时延时,云计算产品对外提供服务能力正常,正常支持业务应用使用,建议排查网络时延较大原因,避免时延继续增大导致业务受损。

计算集群单台物理服务器出现大于250 ms时延时,云计算产品对外提供服务概率性失败,支持业务应用使用能力下降,请排查解决网络时延增大原因。

步骤二:网络带宽劣化场景

计算集群网络带宽劣化配置。

环境信息获取。

登录天基运维控制台,查找名称为ECS-CPU-*的集群,选择集群配置文件,选择machine_group.conf,记录计算集群Worker物理服务器主机名。

通过OPS节点登录计算集群的物理服务器。

带宽检测文件创建。

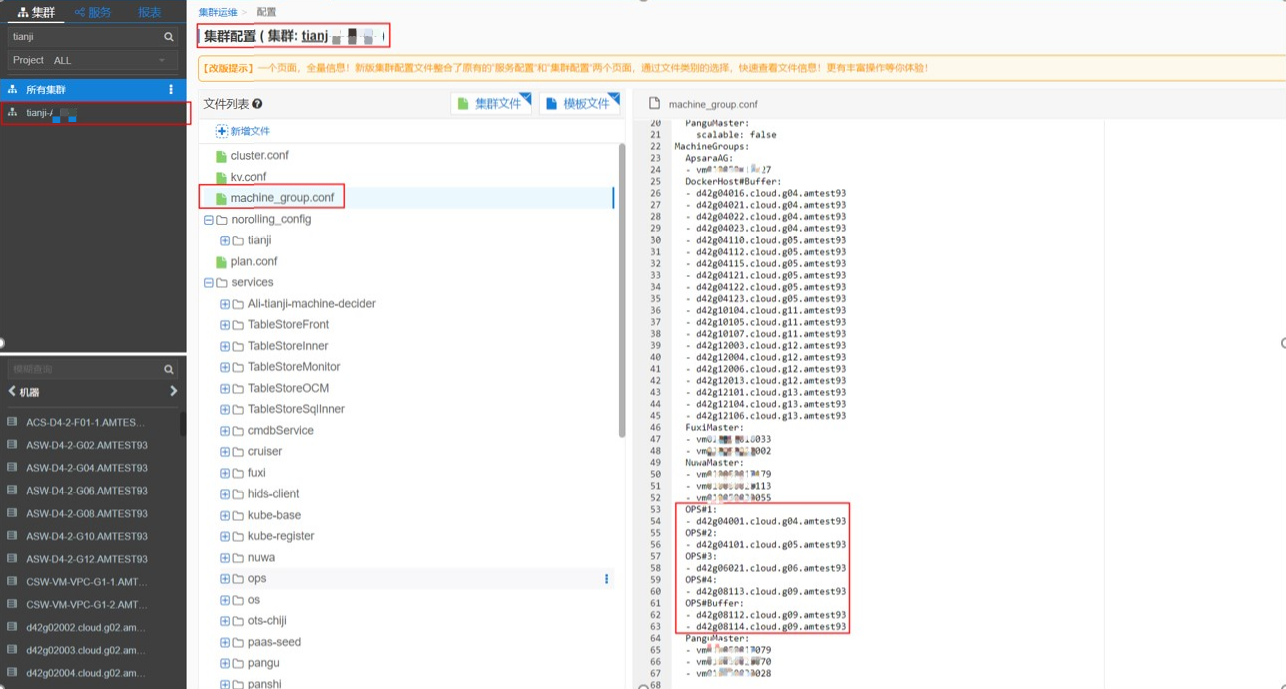

登录天基运维控制台,查找名称为tianji-*的集群,选择集群配置文件,选择machine_group.conf,记录计算集群OPS#1到OPS#4物理服务器主机名。

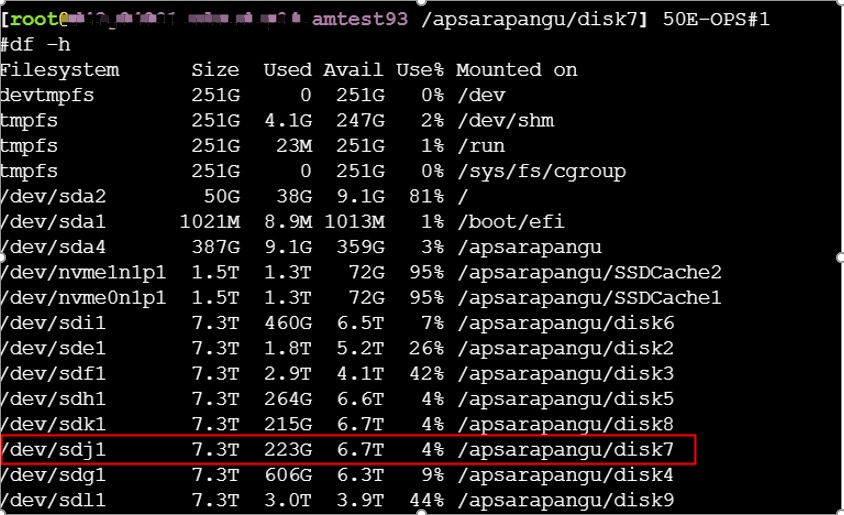

登录OPS#1物理服务器,查询本地磁盘空间/apsarapangu/disk7,确保空间大于等于15 GB,如果本地可用空间不够15 GB,则请按照实际可用空间大小减去5 GB来配置下述步骤c中创建文件。

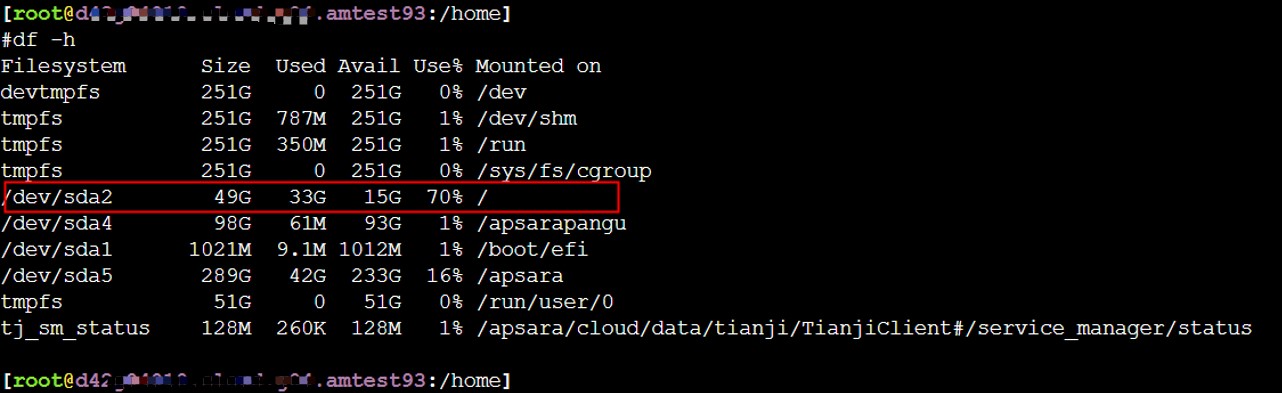

登录计算集群的物理服务器,查询计算集物理服务器的本地可用空间是否大于等于15 GB,如果本地可用空间不够15 GB,则请按照实际可用空间大小减去5 GB来配置下述步骤d中创建的文件。

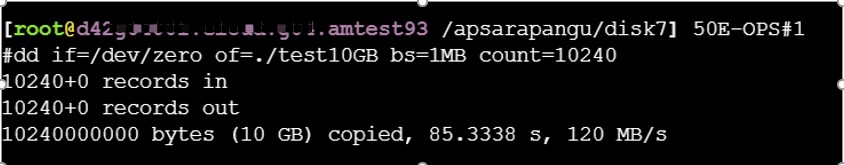

登录OPS#1物理服务器,使用dd命令在/apsarapangu/disk7目录下创建文件(具体拷贝文件大小设置参考上述步骤b和c)。

网络带宽劣化设置。

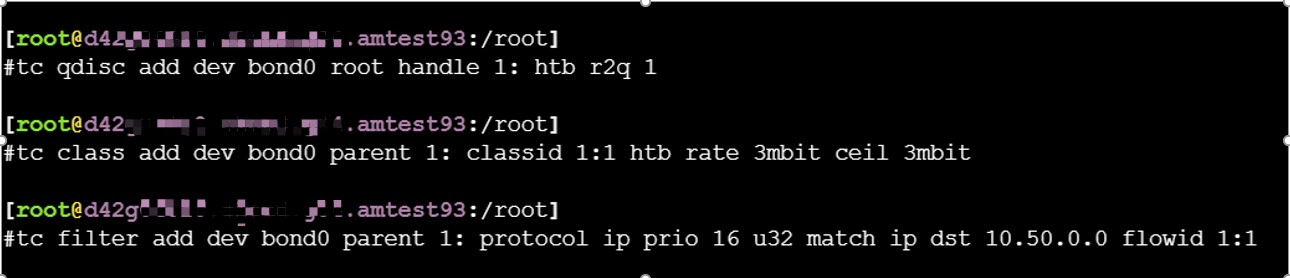

逐个登录计算集群物理服务器,按照如下命令设置物理服务器带宽3 MB:

tc qdisc add dev bond0 root handle 1: htb r2q 1 tc class add dev bond0 parent 1: classid 1:1 htb rate 3mbit ceil 3mbit tc filter add dev bond0 parent 1: protocol ip prio 16 u32 match ip dst 10.50.0.0 flowid 1:1//For example 10.50.0.0

网络带宽劣化检测。

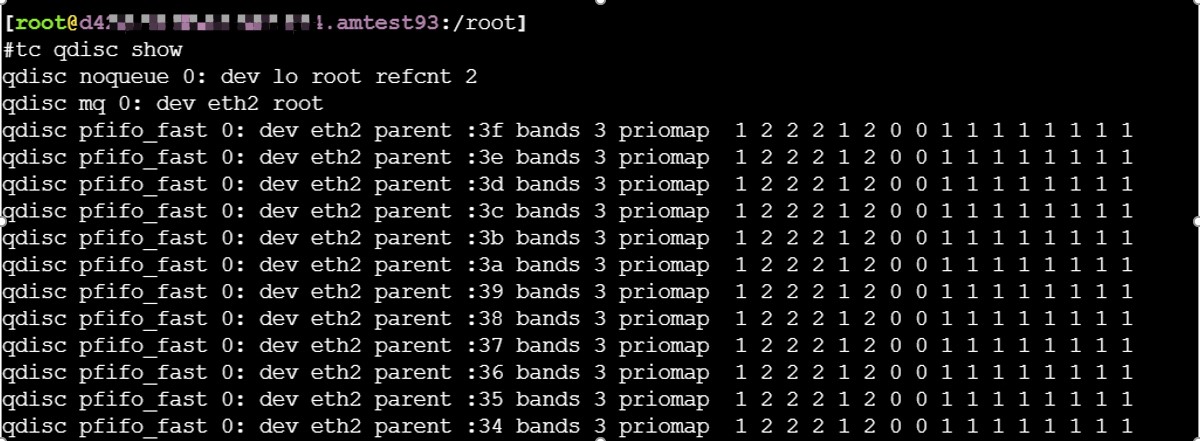

逐个登录计算集群的物理服务器,执行命令

tc qdisc show查询带宽配置成功:

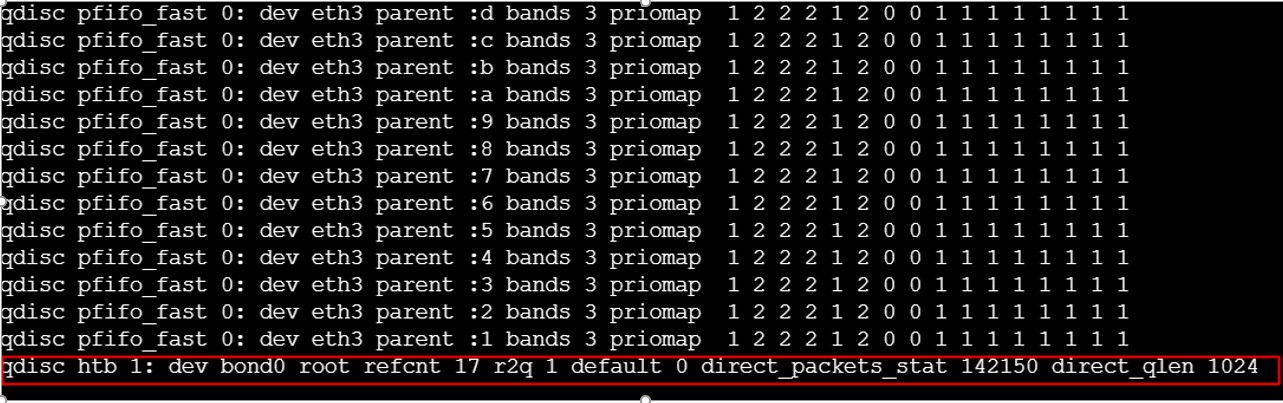

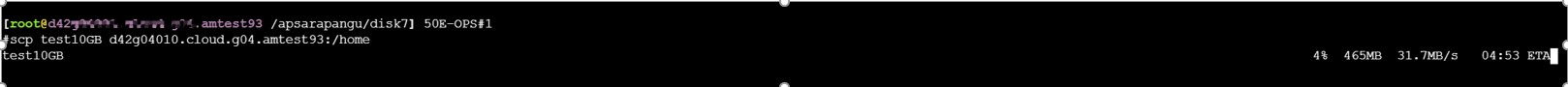

登录OPS#1物理服务器,通过scp命令将文件拷贝到计算集群物理服务器,检查OPS#1物理服务器到计算集群物理服务器之间拷贝带宽符合带宽设置要求:

云产品服务检测。

创建云服务实例。

登录Apsara Uni-manager运营控制台,创建1台云服务器。

检查1台云服务器是否创建成功。

登录Apsara Uni-manager运营控制台,创建N台云服务器。

检查N台云服务器是否创建成功(在设置网络带宽逐步减小的过程中,创建云服务器会概率性出现创建失败情况)。

云服务实例生命周期管理。

检测云服务器停止是否成功。

检测云服务器启动是否成功。

检测云服务器重启是否成功。

检测云服务器删除是否成功。

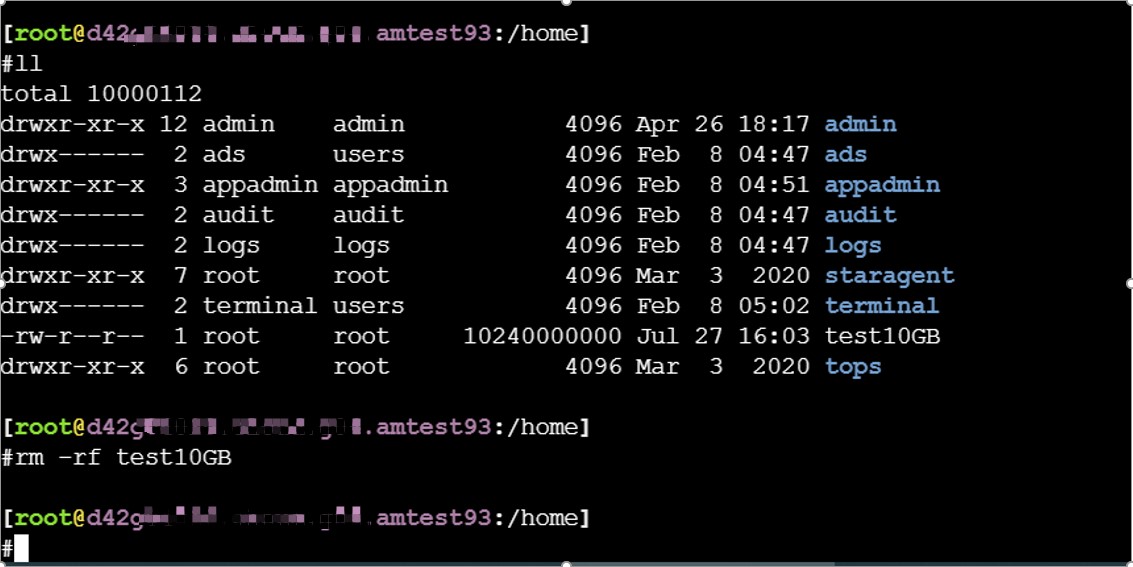

网络带宽劣化取消。

执行如下命令取消物理服务器网卡带宽限制:

tc qdisc del dev bond0 root。

网络带宽劣化循环设置。

经过步骤二:网络带宽劣化场景下的:计算集群网络时延劣化设置到步骤二:网络带宽劣化场景下的:网络时延劣化取消操作,完成一次完整混合云网络时延劣化云产品服务能力分析。

设置不同网络带宽,重复步骤a,记录不同网络带宽下云产品服务能力变化趋势。

带宽检测文件删除。

网络带宽劣化测试完成后,登录OPS#1物理服务器和所有计算集群物理服务器,执行命令

rm -rf /home/test10GB删除带宽检测文件,释放物理服务器空间。

网络带宽劣化检测输出。

网络带宽劣化检测汇总。

测试编号

云服务集群

单台服务器带宽范围

云服务

单台创建

10台创建

10台停止

10台启动

10台重启

10台删除

1

计算集群

0MB<带宽<9MB

概率性失败

概率性失败

概率性失败

概率性失败

概率性失败

概率性失败

2

计算集群

9MB<带宽<27MB

成功

成功

成功

成功

成功

成功

3

计算集群

27MB<带宽

成功

成功

成功

成功

成功

成功

网络带宽劣化检测分析。

经过计算集群的网络带宽劣化测试,验证在某混合云环境中:

计算集群单台物理服务器出现小于9 MB带宽时,云计算产品对外提供服务概率性失败,支持业务应用使用能力下降,请排查解决网络带宽减小原因。

计算集群单台物理服务器出现9 MB至27 MB带宽时,云计算产品对外提供服务能力正常,正常支持业务应用使用,建议排查网络带宽较小原因,避免带宽继续减小导致业务受损。

计算集群单台物理服务器出现大于27 MB带宽时,云计算产品对外提供服务能力正常,正常支持业务应用使用。

步骤三:网络丢包率劣化

计算集群网络丢包率劣化配置。

环境信息获取。

登录天基运维控制台,查找名称为ECS-CPU-*的集群,选择集群配置文件,选择machine_group.conf,记录计算集群Worker物理服务器主机名。

登录计算集群的物理服务器。

网络丢包率劣化设置。

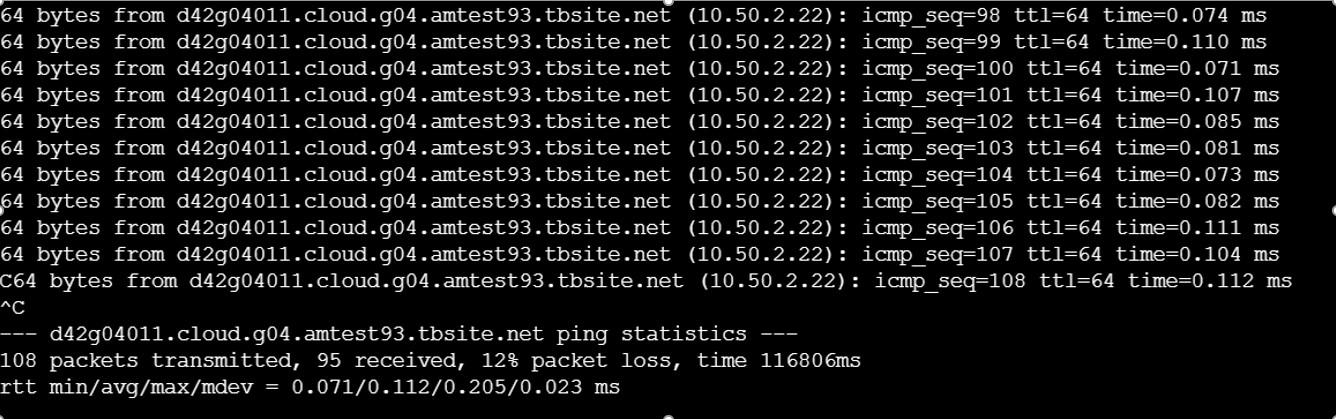

执行ping操作,检查计算集群物理服务器之间的丢包率为0。

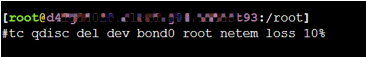

执行如下命令配置物理服务器网卡丢包率10%:

tc qdisc add dev eth0 root netem loss 10%。

网络丢包率劣化检测。

执行ping操作,检查计算集群物理服务器之间丢包增加到12%。

云产品服务检测。

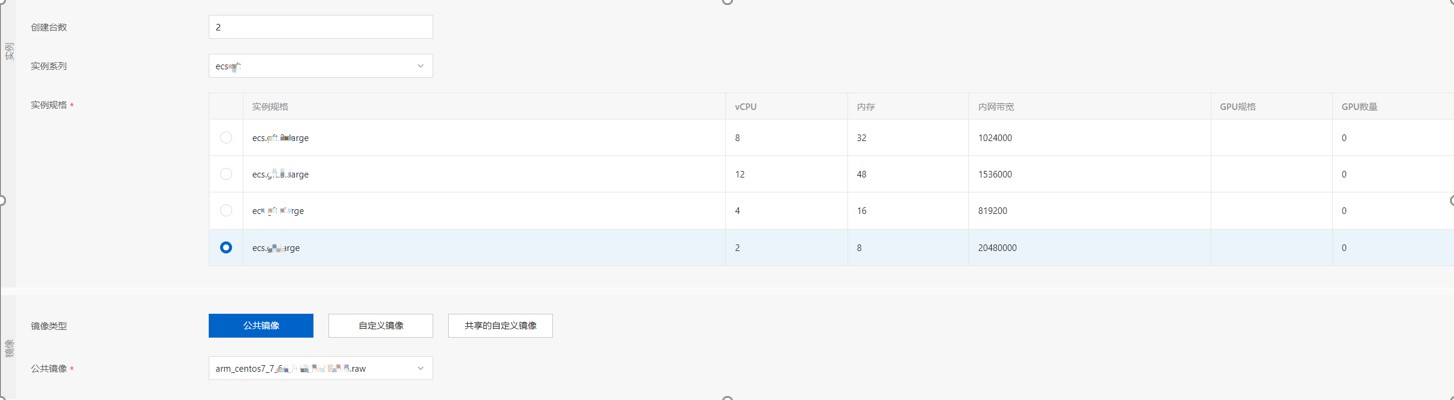

创建云服务检测。

登录Apsara Uni-manager运营控制台,创建1台云服务器:

检查1台云服务器是否创建成功:

Apsara Uni-manager运营控制台,创建N台云服务器:

检查N台云服务器是否创建成功(在设置网络丢包率逐步增大的过程中,创建云服务器会概率性出现创建失败情况):

云服务生命周期管理检测。

检测云服务器停止是否成功:

检测云服务器启动是否成功:

检测云服务器重启是否成功:

检测云服务器删除是否成功:

网络丢包率劣化取消。

执行如下命令取消物理服务器网卡丢包率限制:

tc qdisc del dev bond0 root netem loss 10%。

网络丢包率劣化循环设置。

经过步骤三:网络丢包率劣化下的:计算集群网络丢包率劣化设置到步骤三:网络丢包率劣化下的:网络丢包率劣化取消操作,完成一次完整混合云网络丢包率劣化云产品服务能力分析。

设置不同网络带宽,重复步骤a,记录不同网络丢包率下云产品服务能力变化趋势。

网络丢包率劣化检测输出。

网络丢包率劣化检测汇总。

测试编号

云服务集群

单台服务器丢包率范围

云服务

单台创建

10台创建

10台停止

10台启动

10台重启

10台删除

1

计算集群

0%<丢包率<10%

成功

成功

成功

成功

成功

成功

2

计算集群

10%<丢包率<40%

变慢

变慢

变慢

变慢

变慢

变慢

3

计算集群

40%<丢包率

概率性失败

概率性失败

概率性失败

概率性失败

概率性失败

概率性失败

网络丢包率劣化检测分析。

经过计算集群的网络丢包率劣化测试,验证在某混合云环境中:

计算集群单台物理服务器出现小于10%丢包率时,云计算产品对外提供服务能力正常,正常支持业务应用使用。

计算集群单台物理服务器出现10%至40%丢包率时,云计算产品对外提供服务能力正常,正常支持业务应用使用,建议排查网络丢包率较大原因,避免丢包率继续增大导致业务受损。

计算集群单台物理服务器出现大于40%丢包率时,云计算产品对外提供服务概率性失败,支持业务应用使用能力下降,请排查解决网络丢包率增大原因。