基于NAS动态存储卷,系统可以为工作负载按需自动创建和分配存储空间,无需预先创建PV。这不仅能满足数据持久化和共享(多Pod同时读写)的需求,还可以简化Web应用、日志保存等场景下的存储管理。

工作原理

使用动态存储卷时,应用在创建PVC时,系统会根据PVC指定的StorageClass,按需自动创建一个全新的存储卷及与之对应的PV。此模式更为灵活,且支持存储卷的自动扩容。

挂载模式

可通过StorageClass中的volumeAs参数指定挂载模式,定义PV和NAS文件系统的对应关系。

|

挂载方式 |

说明 |

使用场景 |

|

子目录模式。一个PV对应一个NAS文件系统的独立子目录,便于数据隔离。 |

|

|

|

共享目录模式。所有PV均对应StorageClass中定义的同一个NAS目录,所有使用此StorageClass的PVC都指向NAS上同一个共享目录。 |

多个跨命名空间的Pod需要挂载同一个NAS子目录。 |

|

|

filesystem(不推荐) |

文件系统模式。一个PV对应一个动态新建的、独立的NAS文件系统实例。 |

对性能、安全等有严格隔离要求,需要为应用动态创建和删除独立的NAS文件系统和挂载点。成本较高。 |

通用流程

挂载NAS动态存储卷的主要流程如下。

|

|

准备工作

-

已安装csi-plugin组件和csi-provisioner组件。

CSI组件默认安装,请确保未手动卸载。可在页面查看安装情况。建议升级CSI组件至最新版本。

-

使用subpath和sharepath时,需已创建NAS文件系统,且满足以下条件。否则请重新创建文件系统。

NAS在挂载连通性、文件系统数量、协议类型等方面存在使用限制。

-

协议类型:仅支持NFS。

-

专有网络VPC:NAS文件系统需与集群VPC保持一致。NAS支持跨可用区挂载,不支持跨VPC挂载。

-

挂载点:添加与集群处于同一VPC内且状态可用的挂载点,具体操作请参见管理挂载点。请记录挂载点地址。

-

(可选)加密类型:如需加密存储卷数据,请在创建NAS文件系统时配置加密类型。

-

注意事项

-

禁止删除挂载点:存储卷使用期间,请勿在NAS控制台删除其对应的挂载点,以免导致节点I/O异常。

-

并发写入:NAS为共享存储。当多个Pod同时挂载一个存储卷时,应用自身需要处理并发写入可能带来的数据一致性问题。

关于NAS并发写入的一些限制条件,请参见如何避免多进程或多客户端并发写同一日志文件可能出现的异常?和读写访问文件类问题。

-

挂载性能:若在应用中配置了

securityContext.fsgroup,kubelet会在挂载后递归执行chmod或chown操作,可能导致Pod启动时间显著延长。如需优化,请参见NAS存储卷FAQ。

方式一:使用subpath方式挂载

此方式下,每个PVC会自动在NAS文件系统下创建一个独立的子目录,作为其PV。

1. 创建StorageClass

StorageClass作为动态卷的供应模板,定义了存储资源的来源和行为。

kubectl

-

参见以下内容创建

alicloud-nas-subpath.yaml。apiVersion: storage.k8s.io/v1 kind: StorageClass metadata: # StorageClass名称,需在集群内唯一 name: alicloud-nas-subpath mountOptions: - nolock,tcp,noresvport - vers=3 parameters: # 设置为 subpath volumeAs: subpath # server 字段格式为 <nas-server-address>:/<path> server: "0cd8b4a576-g****.cn-hangzhou.nas.aliyuncs.com:/k8s" archiveOnDelete: "true" provisioner: nasplugin.csi.alibabacloud.com reclaimPolicy: Retain allowVolumeExpansion: true参数

描述

mountOptionsNAS的挂载参数,包括NFS协议版本等。默认使用v3协议挂载,可通过

vers=4.0方式指定协议版本。关于不同NAS类型支持的NFS协议,请参见NFS协议。parameters.volumeAs挂载模式,设置为

subpath。parameters.serverNAS挂载点地址及待挂载的子目录路径,格式为

<nas-server-address>:/<path>。-

<nas-server-address>:NAS文件系统的挂载点地址。可参见管理挂载点查看。 -

:/<path>:待挂载的NAS子目录。如未设置或指定的子目录不存在,则默认挂载到根目录。-

通用型NAS:根目录为

/。 -

极速型NAS:根目录为

/share。挂载子目录时,path需以/share开头(如/share/data)。

-

parameters.archiveOnDelete删除PVC时,若

reclaimPolicy为Delete,后端存储的文件数据是否被真正删除。NAS为共享存储,提供此选项进行双重确认。

-

true(默认):不会真正删除目录或文件,而是将其归档并重命名,格式为archived-{pvName}.{timestamp}。 -

false:后端对应的目录及数据会被真正删除。此处删除的是NAS的subpath目录以及其中文件,NAS文件系统本身不会被删除。

如需删除NAS文件系统,请参见删除文件系统。

在高频创建和删除PV的场景下,设置为

false可能导致CSI控制器任务队列阻塞,新PV无法被创建,请参见使用NAS动态存储卷时Controller的任务队列已满且无法创建新的PV。provisioner驱动类型。使用阿里云NAS CSI组件时固定为

nasplugin.csi.alibabacloud.com。reclaimPolicyPV的回收策略。

-

Delete(默认):删除PVC时,会自动删除PV,但不会实际删除NAS的对应目录。 -

Retain:删除PVC时,PV和NAS文件不会被删除,需手动删除。适用于对数据安全性要求高的场景,以免误删数据。

allowVolumeExpansion仅通用型NAS支持

允许通过修改 PVC 容量来动态扩容由该 StorageClass 创建的 PV。

该 StorageClass 将基于 NAS 的目录配额功能来管理PV容量,从而精确地管理和限制其容量。支持通过编辑 PVC 的

spec.resources.requests.storage字段来实现在线扩容,请参见为NAS动态存储卷设置目录配额。NAS 目录配额的生效是一个异步过程。PV 刚刚创建或扩容完成后,如果立即进行高速、大批量的数据写入,存在因配额尚未完全生效而超出规定容量的可能。请参见使用限制了解更多使用限制。

-

-

创建StorageClass。

kubectl create -f alicloud-nas-subpath.yaml

控制台

登录容器服务管理控制台,在左侧导航栏选择集群列表。

在集群列表页面,单击目标集群名称,然后在左侧导航栏,选择。

-

单击创建,配置StorageClass名称(集群内保持唯一)并选择存储卷类型为NAS,按照页面提示完成StorageClass的创建。

主要配置项如下。

配置项

说明

选择挂载点

NAS文件系统的挂载点地址。

存储卷模式

存储卷访问模式。本示例为子目录,即subpath,将在挂载路径下自动创建子目录。数据将存储于

<NAS挂载点>:<挂载路径>/<pv-name>/下。挂载路径

待挂载的NAS子目录。如果未设置,则默认挂载到根目录。

如果NAS中没有该目录,系统会自动创建并进行挂载。

-

通用型NAS:根目录为

/。 -

极速型NAS:根目录为

/share。挂载子目录时,path需以/share开头(如/share/data)。

回收策略

PV的回收策略。

-

Delete(默认):删除PVC时,会自动删除PV,但不会实际删除NAS的对应目录。 -

Retain:删除PVC时,PV和NAS文件不会被删除,需手动删除。适用于对数据安全性要求高的场景,以免误删数据。

挂载选项

NAS的挂载参数,包括NFS协议版本等。默认使用v3协议挂载,可通过

vers=4.0方式指定协议版本。关于不同NAS类型支持的NFS协议,请参见NFS协议。创建后,可在存储类列表查看创建的StorageClass。

-

2. 创建PVC

PVC 作为应用的存储请求,将触发 StorageClass 的动态供应机制,自动创建并绑定一个匹配的 PV。

kubectl

-

参见以下内容创建

nas-pvc.yaml。kind: PersistentVolumeClaim apiVersion: v1 metadata: name: nas-csi-pvc spec: accessModes: - ReadWriteMany # 指定待绑定的 StorageClass storageClassName: alicloud-nas-subpath resources: requests: # 声明所需使用的存储卷的容量 storage: 20Gi参数

说明

accessModes访问模式。可取值:

-

ReadWriteMany(默认):多节点读写。 -

ReadWriteOnce:单节点读写。 -

ReadOnlyMany:多节点只读。

storageClassName待绑定的StorageClass。

storage声明所需使用的存储卷的容量。默认情况下,此声明主要作为资源请求,并不限制Pod实际可用的存储空间。

NAS容量上限由规格决定,请参见通用型NAS和极速型NAS确认。

但当StorageClass的

allowVolumeExpansion为true时,此值将变为一个严格执行的硬性限制。CSI 将按照该配置设置NAS的目录配额,限制PV的可用容量。 -

-

创建PVC。

kubectl create -f nas-pvc.yaml -

查看PV。

kubectl get pv预期输出如下,表明已基于StorageClass自动创建了PV,并绑定到PVC。

NAME CAPACITY ACCESS MODES RECLAIM POLICY STATUS CLAIM STORAGECLASS VOLUMEATTRIBUTESCLASS REASON AGE nas-a7540d97-0f53-4e05-b7d9-557309****** 20Gi RWX Retain Bound default/nas-csi-pvc alicloud-nas-subpath <unset> 5m

控制台

-

在集群管理页左侧导航栏,选择。

-

在存储声明页面,单击创建,配置PVC后,单击创建。

配置项

说明

存储声明类型

选择NAS。

名称

PVC名称,在命名空间内保持唯一。

分配模式

选择使用存储类动态创建。

已有存储类

单击选择存储类,选择此前创建的StorageClass。

总量

声明所需使用的存储卷的容量。默认情况下,此声明主要作为资源请求,并不限制Pod实际可用的存储空间。

NAS容量上限由规格决定,请参见通用型NAS和极速型NAS确认。

但当StorageClass的

allowVolumeExpansion为true时,此值将变为一个严格执行的硬性限制。CSI 将按照该配置设置NAS的目录配额,限制PV的可用容量。访问模式

访问模式。可取值:

-

ReadWriteMany(默认):多节点读写。 -

ReadWriteOnce:单节点读写。 -

ReadOnlyMany:多节点只读。

-

3. 创建应用并挂载NAS

PVC创建后,可将其绑定的 PV 挂载到应用中。本小节将创建两个Deployment,引用同一个PVC,实现多个 Pod 共享同一NAS子目录。

kubectl

创建2个Deployment并挂载同一PVC,使其共享同一个NAS文件系统的同一个子目录。

如需为多个Pod挂载同一NAS文件系统的不同子目录,请按照子目录创建不同的StorageClass和对应的PVC,再分别挂载PVC。

-

参见以下内容,分别创建

nginx-1.yaml和nginx-2.yaml。两个应用的配置基本一致,两者引用同一PVC。

-

-

创建2个Deployment。

kubectl create -f nginx-1.yaml -f nginx-2.yaml -

查看Pod状态。

kubectl get pod -l app=nginx预期输出

NAME READY STATUS RESTARTS AGE nas-test-1-b75d5b6bc-***** 1/1 Running 0 51s nas-test-2-b75d5b6bc-***** 1/1 Running 0 44s -

查看两个 Pod 详细配置,确认挂载的PVC。

将

<podName>替换为两个Pod的实际名称。kubectl describe pod <podName> | grep "ClaimName:"预期输出中,两个Pod挂载的PVC一致,共享NAS文件系统的同一子目录。

控制台

重复以下操作,分别创建2个Deployment并挂载同一PVC,使其共享同一个NAS文件系统的同一个子目录。

在ACK集群列表页面,单击目标集群名称,在集群详情页左侧导航栏,选择。

-

单击使用镜像创建,按照页面提示完成应用的配置和创建。

主要参数如下,其他参数保持默认即可。详见创建无状态工作负载Deployment。

配置项

参数

说明

应用基本信息

副本数量

Deployment的副本数量。

容器配置

镜像名称

用于部署应用的镜像地址。

所需资源

所需的vCPU和内存资源。

数据卷

单击增加云存储声明(PersistentVolumeClaim),然后完成参数配置。

-

挂载源:选择之前创建的PVC。

-

容器路径:输入NAS文件系统要挂载到的容器路径。

部署完成后,可在无状态页面单击应用名称,在容器组页签下确认Pod已正常运行(状态为Running)。

-

后续结果验证可参见验证共享存储和持久化存储。

方式二:使用sharepath方式挂载

此方式下,所有基于此StorageClass创建的PVC,创建PV时不会创建实际的目录,而会直接使用StorageClass中设置的路径,即每个PV实际上会对应同一个NAS目录。

1. 创建StorageClass

StorageClass作为动态卷的供应模板,定义了存储资源的来源和行为。

kubectl

-

参见以下内容创建alicloud-nas-sharepath.yaml。

apiVersion: storage.k8s.io/v1 kind: StorageClass metadata: name: alicloud-nas-sharepath mountOptions: - nolock,tcp,noresvport - vers=3 parameters: volumeAs: sharepath # server 字段格式为 <nas-server-address>:/<path> server: "0cd8b4a576-g****.cn-hangzhou.nas.aliyuncs.com:/k8s" provisioner: nasplugin.csi.alibabacloud.com reclaimPolicy: Retain参数

描述

mountOptionsNAS的挂载参数,包括NFS协议版本等。默认使用v3协议挂载,可通过

vers=4.0方式指定协议版本。关于不同NAS类型支持的NFS协议,请参见NFS协议。parameters.volumeAs挂载方式,设置为

sharepath。parameters.serverNAS挂载点地址及待挂载的子目录路径,格式为

<nas-server-address>:/<path>。-

<nas-server-address>:NAS文件系统的挂载点地址。可参见管理挂载点查看。 -

:/<path>:待挂载的NAS子目录。如未设置或指定的子目录不存在,则默认挂载到根目录。-

通用型NAS:根目录为

/。 -

极速型NAS:根目录为

/share。挂载子目录时,path需以/share开头(如/share/data)。

-

provisioner驱动类型。使用阿里云NAS CSI组件时固定为

nasplugin.csi.alibabacloud.com。reclaimPolicyPV的回收策略。使用sharepath时必须设置为

Retain。 -

-

创建StorageClass。

kubectl create -f alicloud-nas-sharepath.yaml

控制台

在集群列表页面,单击目标集群名称,然后在左侧导航栏,选择。

-

单击创建,配置StorageClass名称(集群内保持唯一)并选择存储卷类型为NAS,按照页面提示完成StorageClass的创建。

配置项

说明

选择挂载点

NAS文件系统的挂载点地址。

存储卷模式

存储卷访问模式。本示例为共享目录,即sharepath。

挂载路径

待挂载的NAS子目录。如果未设置,则默认挂载到根目录。

如果NAS中没有该目录,系统会自动创建并进行挂载。

-

通用型NAS:根目录为

/。 -

极速型NAS:根目录为

/share。挂载子目录时,path需以/share开头(如/share/data)。

回收策略

使用sharepath时必须设置为

Retain。挂载选项

NAS的挂载参数,包括NFS协议版本等。默认使用v3协议挂载,可通过

vers=4.0方式指定协议版本。关于不同NAS类型支持的NFS协议,请参见NFS协议。 -

2. 创建PVC

PVC 作为应用的存储请求,将触发 StorageClass 的动态供应机制,自动创建并绑定一个匹配的 PV。

为了实现跨命名空间的数据共享,本小节将在两个命名空间下创建一个同名PVC。PVC 名称相同,但位于不同命名空间,因此是独立的资源。它们将通过同一StorageClass,在同一 NAS 文件系统上分别获得独立 PV。

kubectl

-

创建命名空间ns1和ns2。

kubectl create ns ns1 kubectl create ns ns2 -

参见以下内容创建pvc.yaml,分别在 ns1 和 ns2 命名空间下创建同名 PVC。

kind: PersistentVolumeClaim apiVersion: v1 metadata: name: nas-csi-pvc namespace: ns1 spec: accessModes: - ReadWriteMany storageClassName: alicloud-nas-sharepath resources: requests: storage: 20Gi --- kind: PersistentVolumeClaim apiVersion: v1 metadata: name: nas-csi-pvc namespace: ns2 spec: accessModes: - ReadWriteMany storageClassName: alicloud-nas-sharepath resources: requests: storage: 20Gi参数

说明

accessModes访问模式。可取值:

-

ReadWriteMany(默认):多节点读写。 -

ReadWriteOnce:单节点读写。 -

ReadOnlyMany:多节点只读。

storageClassName待绑定的StorageClass。

storage声明所需使用的存储卷的容量。默认情况下,此声明主要作为资源请求,并不限制Pod实际可用的存储空间。

NAS容量上限由规格决定,请参见通用型NAS和极速型NAS确认。

但当StorageClass的

allowVolumeExpansion为true时,此值将变为一个严格执行的硬性限制。CSI 将按照该配置设置NAS的目录配额,限制PV的可用容量。 -

-

创建PVC。

kubectl create -f pvc.yaml -

查看PV状态,确认已为 PVC 自动创建并绑定了对应的 PV。

kubectl get pv预期输出如下,两个状态 PV 均为

Bound,CLAIM显示每个 PV 分别绑定到两个命名空间下的 PVC(ns1/nas-csi-pvc和ns2/nas-csi-pvc)。NAME CAPACITY ACCESS MODES RECLAIM POLICY STATUS CLAIM STORAGECLASS VOLUMEATTRIBUTESCLASS REASON AGE nas-0b448885-6226-4d22-8a5b-d0768c****** 20Gi RWX Retain Bound ns1/nas-csi-pvc alicloud-nas-sharepath <unset> 74s nas-bcd21c93-8219-4a11-986b-fd934a****** 20Gi RWX Retain Bound ns2/nas-csi-pvc alicloud-nas-sharepath <unset> 74s

控制台

-

创建命名空间。

在集群列表页面,单击目标集群名称,然后在左侧导航栏,选择命名空间与配额。

-

单击创建,安装页面提示创建命名空间ns1和ns2。

-

在集群管理页左侧导航栏,选择。

-

在命名空间ns1下,创建一个存储声明。

在存储声明页面,选择命名空间为ns1,按照页面提示完成PVC的创建。

配置项

说明

存储声明类型

选择NAS。

名称

PVC名称,在命名空间内保持唯一。

分配模式

选择使用存储类动态创建。

已有存储类

单击选择存储类,选择此前创建的StorageClass。

总量

声明所需使用的存储卷的容量。默认情况下,此声明主要作为资源请求,并不限制Pod实际可用的存储空间。

NAS容量上限由规格决定,请参见通用型NAS和极速型NAS确认。

但当StorageClass的

allowVolumeExpansion为true时,此值将变为一个严格执行的硬性限制。CSI 将按照该配置设置NAS的目录配额,限制PV的可用容量。访问模式

访问模式。可取值:

-

ReadWriteMany(默认):多节点读写。 -

ReadWriteOnce:单节点读写。 -

ReadOnlyMany:多节点只读。

-

-

参见上一步,在命名空间ns2下,再次创建一个PVC。

创建后,返回存储声明页面,在命名空间ns1和ns2下,确认2个PVC均已绑定自动创建的PV。

3. 创建应用并挂载NAS

PVC创建后,可将其绑定的 PV 挂载到应用中。本小节在2个Namespace下分别创建应用,并挂载相应的PVC,从而让它们共享StorageClass中定义的NAS子目录。

kubectl

-

参见以下内容,分别创建

nginx-ns1.yaml和nginx-ns2.yaml。2个应用的配置基本一致,分别绑定相应Namespace下的PVC。

-

-

创建2个Deployment。

kubectl create -f nginx-ns1.yaml -f nginx-ns2.yaml -

查看Pod状态。

kubectl get pod -A -l app=nginx预期输出:

NAMESPACE NAME READY STATUS RESTARTS AGE ns1 nas-test-b75d5b6bc-***** 1/1 Running 0 2m19s ns2 nas-test-b75d5b6bc-***** 1/1 Running 0 2m11s -

查看 Pod 详细配置,确认PVC挂载。

将

<namespace-name>、<pod-name>分别替换为实际NameSpace和Pod名称。kubectl describe pod -n <namespace-name> <pod-name> | grep "ClaimName:"预期输出中,两个Pod分别挂载了

ns1/nas-csi-pvc和ns2/nas-csi-pvc。

控制台

在ACK集群列表页面,单击目标集群名称,在集群详情页左侧导航栏,选择。

-

在命名空间ns1下,创建一个Deployment,并挂载相应的PVC。

-

选择命名空间为ns1,单击使用镜像创建。

-

按照页面提示完成应用的创建。

主要参数如下,其他参数保持默认即可。详见创建无状态工作负载Deployment。

配置项

参数

说明

应用基本信息

副本数量

Deployment的副本数量。

容器配置

镜像名称

用于部署应用的镜像地址。

所需资源

所需的vCPU和内存资源。

数据卷

单击增加云存储声明(PersistentVolumeClaim),然后完成参数配置。

-

挂载源:选择之前创建的PVC。

-

容器路径:输入NAS文件系统要挂载到的容器路径,如/data。

-

-

-

参见上一步,在命名空间ns2下,再次创建一个Deployment,并挂载相应的PVC。

返回无状态页面,在命名空间ns1和ns2下,分别查看2个Deployment的部署情况,确认Pod已正常Running,且挂载了对应的PVC。

后续结果验证可参见验证共享存储和持久化存储。

方式三:使用filesystem方式挂载

filesystem 模式适用于需要为应用动态创建和管理专属 NAS 文件系统及挂载点的场景。与sharepath不同,每个以filesystem创建的 PV 都对应一个独立的 NAS 文件系统实例。

一个 filesystem 类型的 PV 对应一个独立的 NAS 文件系统和一个挂载点。

-

filesystem类型的PV删除时默认保留NAS文件系统和挂载点。如需在删除PV时同步删除NAS文件系统和挂载点,需在StorageClass中进行以下配置:

-

reclaimPolicy: Delete -

parameters.deleteVolume: "true"

-

-

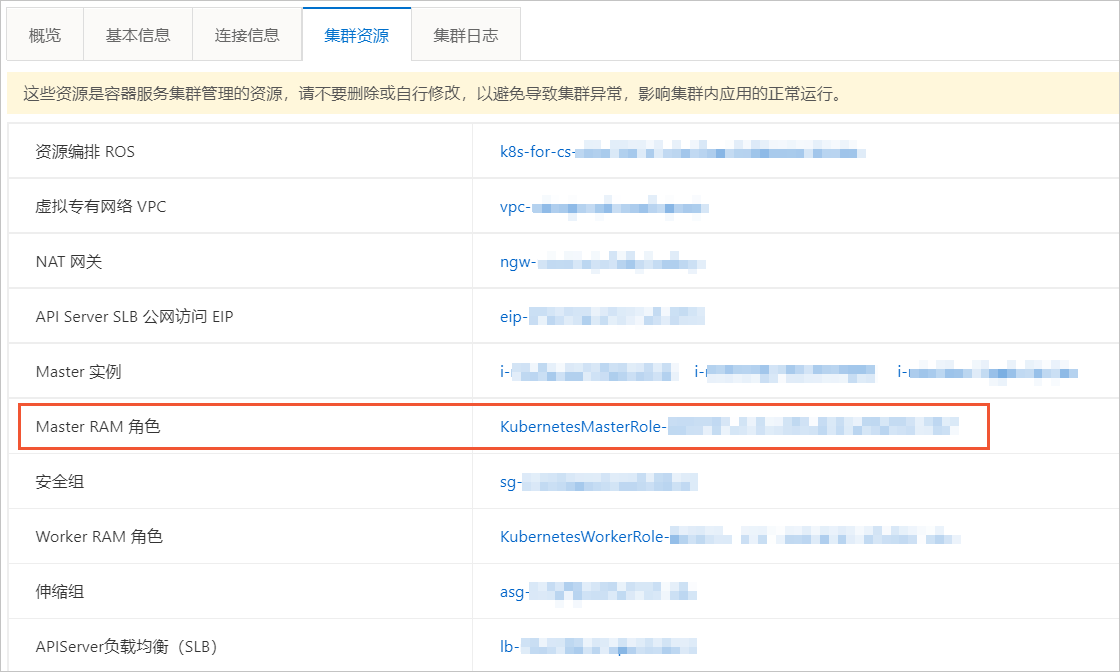

使用ACK专有集群时,需授予csi-provisioner相应的权限。

1. 创建StorageClass

2. 创建PVC

3. 创建应用并挂载NAS

验证共享存储和持久化存储

成功部署应用后,可验证存储卷是否按预期工作。本小节以subpath 模式下创建的 nas-test-1 和 nas-test-2 为例进行验证。

|

共享存储 |

持久化存储 |

|

在一个Pod中创建文件,然后在另一个Pod中查看文件,验证数据的共享存储。

|

重建Deployment,在新建Pod中查看文件系统中的数据是否存在,验证数据的持久化存储。

|

适用于生产环境

-

安全与数据保护

-

使用Retain回收策略: 推荐将StorageClass的

reclaimPolicy设置为Retain,防止因误删PVC而导致后端数据被删除。 -

使用权限组进行访问控制:NAS通过权限组来管理网络访问权限。请遵循最小权限原则,在权限组中仅添加集群节点的私网IP地址或其所属的vSwitch网段,避免授权范围过大(如

0.0.0.0/0)。

-

-

性能与成本优化

-

选择合适的NAS类型:参见文件系统选型,根据应用对IOPS和吞吐量的要求合理选择NAS类型。

-

优化挂载选项 (

mountOptions):根据工作负载特性调整NFS挂载参数。例如,使用vers=4.0或vers=4.1协议版本可能在某些场景下获得更好的性能和文件锁定能力。对于大规模文件读写,可测试调整rsize和wsize参数以优化读写性能。

-

-

运维与可靠性

-

配置健康检查:为应用Pod配置存活探针(Liveness Probe),检查挂载点是否正常。当挂载失效时,ACK可自动重启Pod,触发存储卷的重新挂载。

-

监控与告警:利用容器存储监控配置告警,及时发现存储卷的异常或性能瓶颈。

-

资源释放指引

为避免产生预期外费用,当您不再需要使用NAS存储卷时,请按照以下顺序释放相关资源。

-

删除工作负载

-

操作:删除所有使用该NAS存储卷的应用(如Deployment、StatefulSet等)。此操作将停止应用Pod对存储卷的挂载和读写。

-

命令示例:

kubectl delete deployment <your-deployment-name>

-

-

删除PVC

-

操作:删除应用所关联的PVC。删除PVC后,其绑定的PV和后端NAS的后续行为取决于对应StorageClass中定义的

reclaimPolicy。-

subpath模式

-

reclaimPolicy: Retain:删除PVC后,其绑定的PV会进入Released状态。PV对象和后端NAS上的对应子目录及数据都会被保留,需手动删除。 -

reclaimPolicy: Delete:删除PVC后,其绑定的PV会被自动删除。后端NAS子目录的处理方式取决于archiveOnDelete参数:-

archiveOnDelete: "true":后端数据不会被删除,而是被重命名归档为archived-{pvName}.{timestamp}。 -

archiveOnDelete: "false":后端NAS上与该PV对应的子目录及其中数据会被彻底删除。请谨慎操作。

在 ACK Serverless 集群中,由于权限限制,即使配置为

reclaimPolicy: Delete,后端NAS目录及数据也不会被删除或归档,仅PV对象会被删除。 -

-

-

sharepath模式

reclaimPolicy仅支持Retain。删除PVC后,其绑定的PV会进入Released状态。由于是共享目录,PV对象和后端的NAS共享目录及数据会被保留。 -

filesystem模式

-

reclaimPolicy: Retain:删除PVC后,其绑定的PV会进入Released状态。PV对象、动态创建的后端NAS文件系统及挂载点都会被保留。 -

reclaimPolicy: Delete:删除PVC后,其绑定的PV会被自动删除。后端NAS文件系统的处理方式取决于deleteVolume参数:-

deleteVolume: "false":后端NAS文件系统和挂载点会被保留,需手动删除。 -

deleteVolume: "true":后端NAS文件系统和挂载点会被自动删除。请谨慎操作。

-

-

-

-

命令示例:

kubectl delete pvc <your-pvc-name>

-

-

删除PV

-

操作:当PV处于

Available或Released状态时,可执行删除操作。此操作仅从Kubernetes集群中移除该PV的定义,不会删除后端NAS文件系统上的数据。 -

命令示例:

kubectl delete pv <your-pv-name>

-

-

删除后端NAS文件系统(可选)

相关文档

-

在挂载和使用NAS存储卷的过程中,如果遇到问题,可参考以下文档进行排查。

-

通过CNFS可以实现对NAS文件系统的独立管理,提升NAS文件系统的性能和QoS控制。具体操作,请参见通过CNFS管理NAS文件系统。

-

通过subpath挂载的NAS支持目录配额功能,请参见为NAS动态存储卷设置目录配额。