高效对话的艺术 —— 提示词工程初步实践

许多学生或研究者在论文早期会撰写一个初稿段落,但这个内容往往还无法满足目标期刊/会议体例的高质量摘要的要求。通过结构化提示与知识库引导(如角色提示、结构/长度约束、正/负例说明、范例参考、人工评估—迭代优化等),在不改动段落事实的前提下,把初稿内容加工为多种风格/结构的摘要,并完成可量化评估与择优。

实验任务:分析一段手稿并生成符合学术期刊或会议要求的论文摘要

一、实验目标

本实验通过在阿里云平台调用大语言模型(如千问系列),结合角色提示、结构与长度约束、范例参考、人工评估—迭代优化等多环节策略,训练学生构建高效提示配置系统,实现从论文初稿到目标期刊摘要的优化。

完成本实验后,学生应能够:

在阿里云百炼平台上配置并使用一个在线可交互的大语言模型应用;

掌握提示词工程(prompt engineering)的核心要素与设计方法;

能够基于同一论文初稿段落,生成多种符合期刊/会议体例的高质量摘要;

建立可量化评估与“人工评估—迭代优化”的提示配置闭环;

对比不同知识引导策略的输出效果,并形成针对性改进模板。

二、实验介绍

摘要作为学术论文的核心窗口,直接影响论文的录用概率。然而,研究者初稿摘要往往存在体例不符、信息密度不足等问题。本实验通过在阿里云平台调用千问系列大语言模型,结合角色提示、结构约束、正/负例说明、范例参考、人工评估—迭代优化等策略,引导学生掌握提示词工程在科研写作中的可控生成机制,并实现多轮优化与质量评估。

三、相关知识点

提示词工程的核心作用在于通过语言控制语言,即以结构化提示词引导模型生成目标输出。相关关键概念包括:

提示词工程(Prompt Engineering):通过精确指令与上下文控制,引导大语言模型生成期望输出的技术。

角色提示与约束性指令:通过“你是一位资深期刊编辑”式角色定义,强化风格与逻辑一致性。

范例参考(Few-shot Prompting):通过提供模板范例,使模型在格式与体例上快速对齐目标。

人工评估—迭代优化流程:结合人工判断与生成结果调整,实现输出质量的可控提升。

四、实验环境配置

平台与工具:阿里云PAI-EAS、阿里云百炼平台(Bailian Studio)

硬件要求:联网计算机

软件环境:Web浏览器(建议Chrome)

资源文件:示例文档 CHI25 example.txt

账户设置:注册阿里云账号并完成高校师生认证;开通阿里云PAI-EAS与阿里云百炼应用开发权限

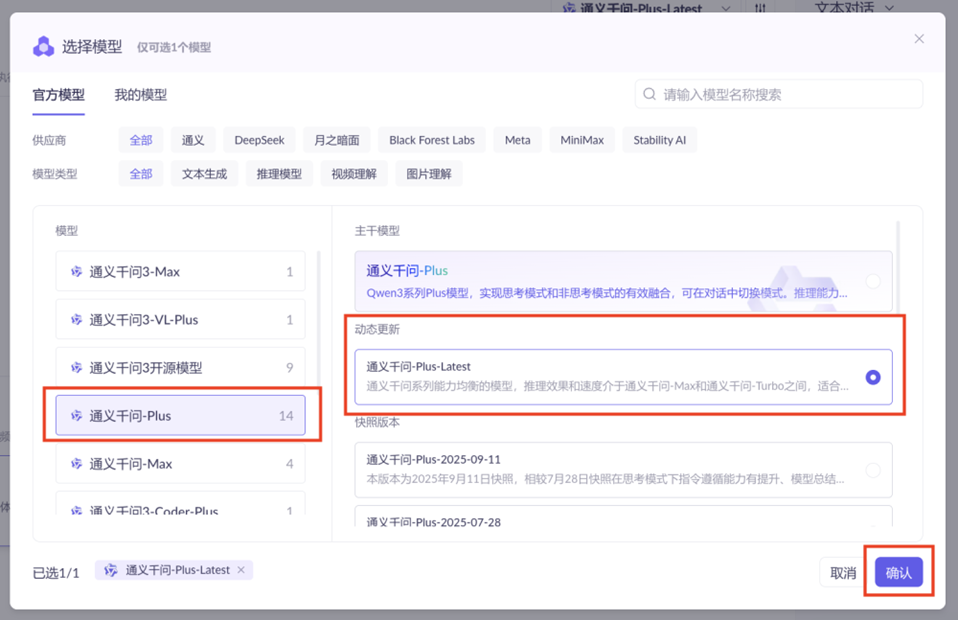

模型选择:千问-plus 或千问-plus-latest

五、实验内容与步骤

实验室资源方式简介

进入实操前,请确保阿里云账号满足以下条件:

个人账号资源

使用您个人的云资源进行操作,资源归属于个人。

所有实验操作将保留至您的账号,请谨慎操作。

平台仅提供手册参考,不会对资源做任何操作。

确保已完成云工开物300元代金券领取。

已通过实名认证且账户余额≥0元。

本实验费用以实际使用的token量为准,以千问-Plus为例,输入 0.0008元/千tokens,输出0.002元/千tokens。

本实验产生的费用优先使用优惠券。如果您调整了资源规格、使用时长,或执行了本方案以外的操作,可能导致费用发生变化,请以控制台显示的实际价格和最终账单为准。

实操结束后,如通过云工开物代金券购买的产品,无需进行注销;如注销产品,代金券不会返还。

新注册阿里云百炼的用户,千问系列模型提供模型的免费额度,不同模型的免费额度不同,请在使用前,先阅读产品文档确认模型的免费额度,或在使用前,登录阿里云百炼-模型广场-模型卡片详情,查看具体模型的免费额度。注意在使用过程中的token消耗。模型列表 只有开通阿里云百炼服务后才能体验模型的免费额度。

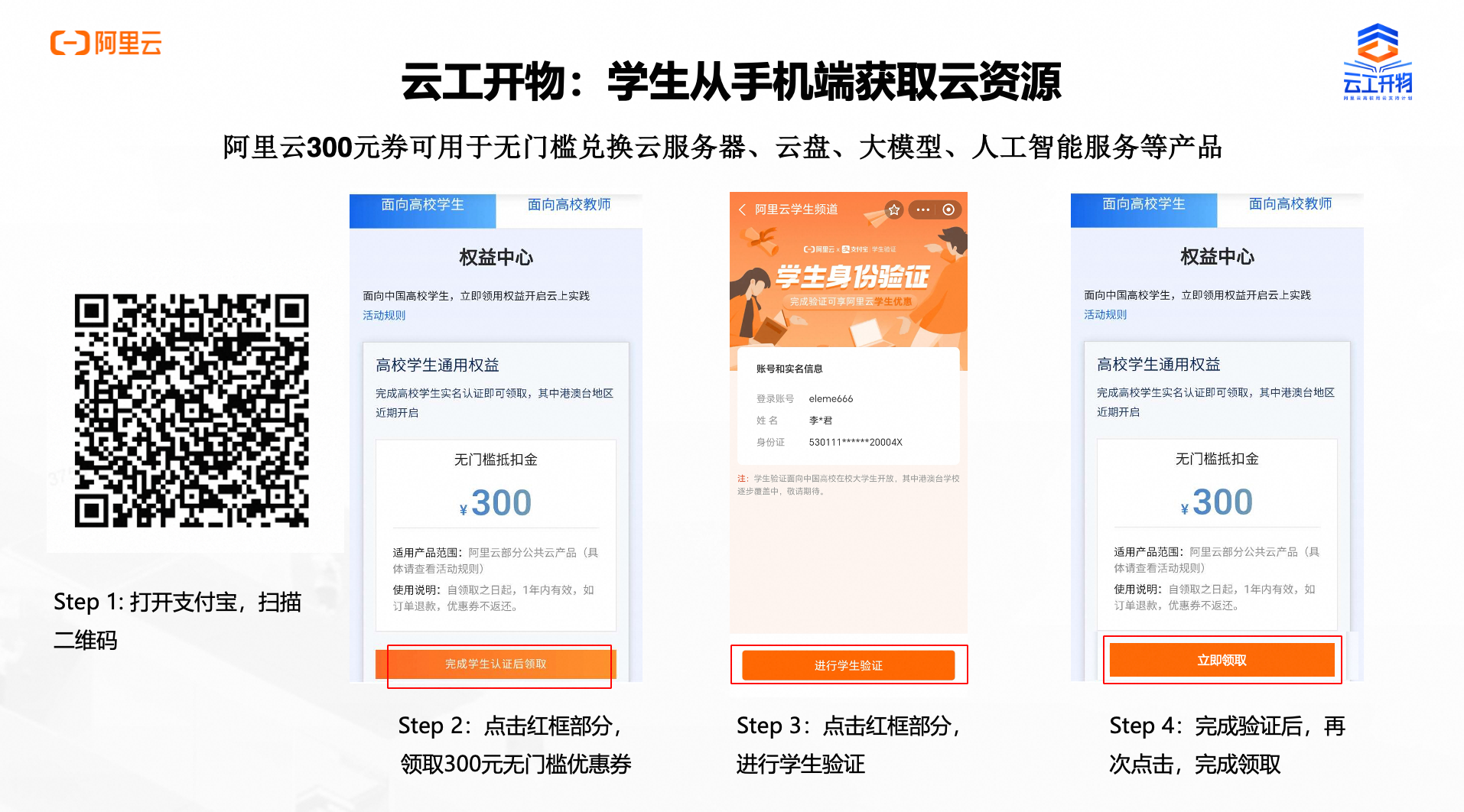

领取专属权益

第一步:点击“进入实操”

在开始实验之前,请先点击右侧屏幕的“进入实操”再进行后续操作

第二步:领取300元优惠券

本次实验需要您通过领取阿里云云工开物学生专属300元抵扣券兑换本次实操的云资源,如未领取请先点击领取。(若已领取请跳过)

重要

重要实验产生的费用优先使用优惠券,优惠券使用完毕后需您自行承担。

在PAI-EAS中手动部署大模型

一、开通授权

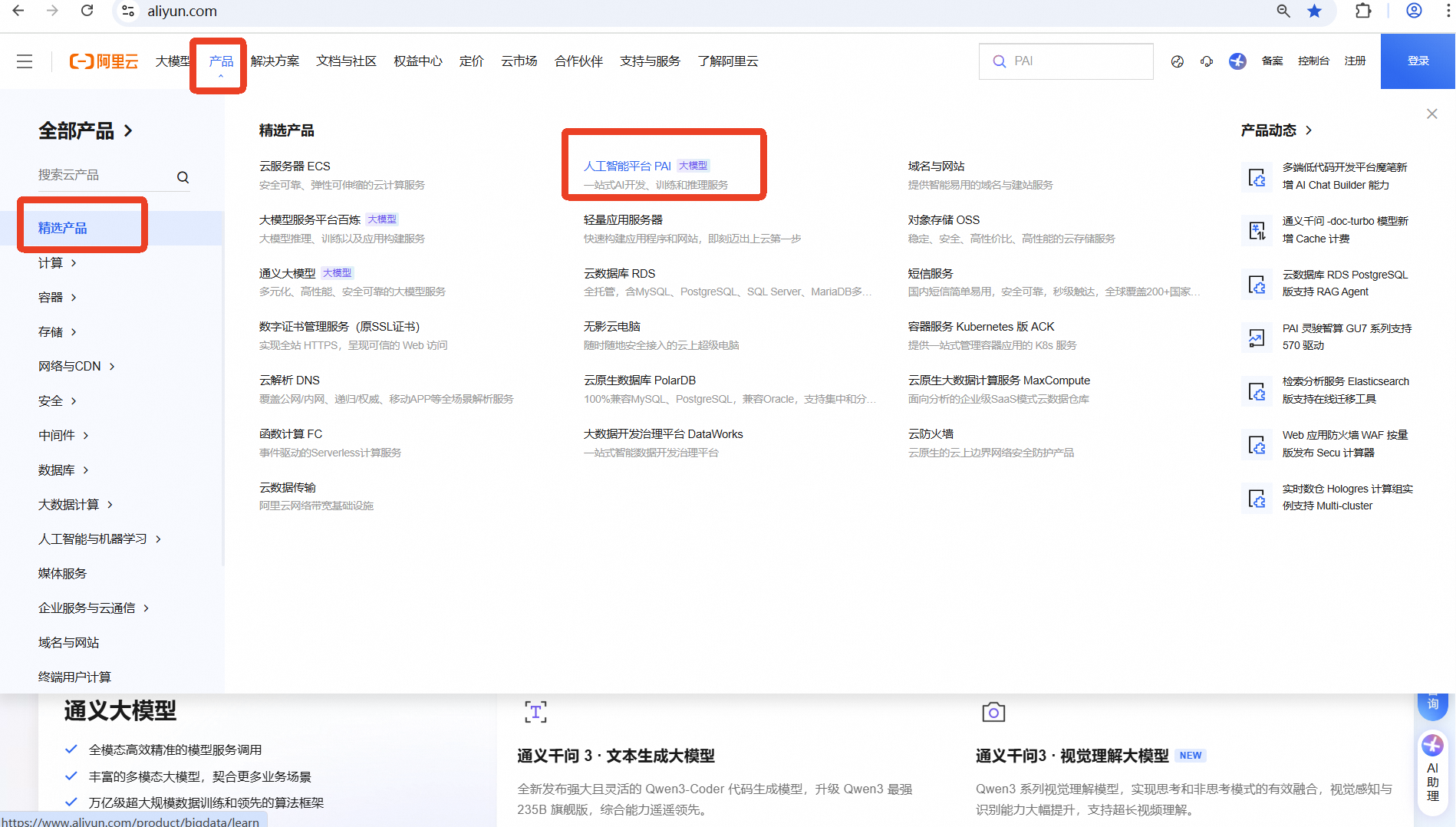

在阿里云官网点击【产品】-【精选产品】-【人工智能平台PAI】进入人工智能PAI平台,或直接点击进入——人工智能PAI平台。

点击【免费试用】。

选择【模型在线服务PAI-EAS】,点击【立即试用】,并点击【前往控制台】。

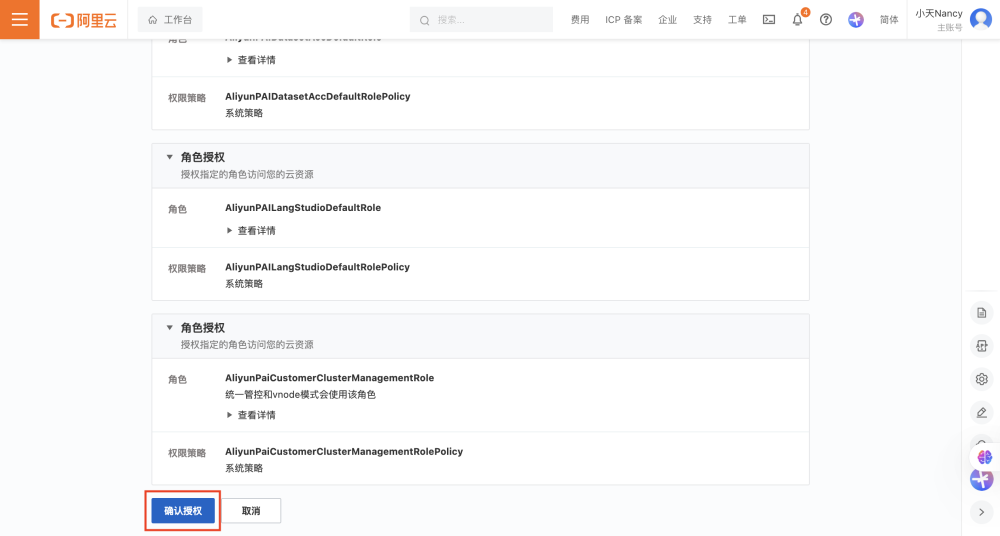

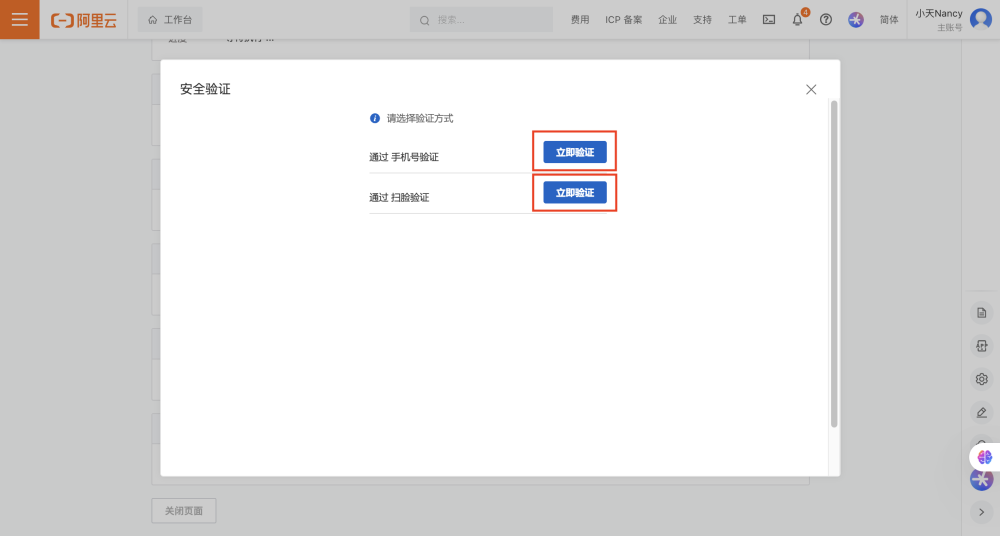

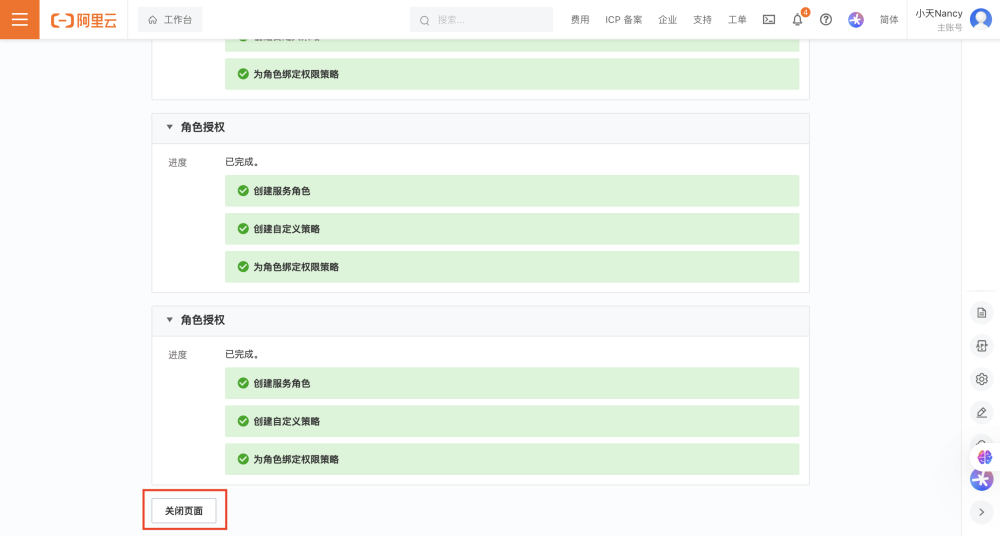

完成认证与授权。点击【一键授权】-【确认授权】,进行安全确认后点击【关闭页面】。

完成开通服务。点击【一键开通】然后进入控制台。

二、手工部署大模型

如果显示“当前region未开服”,点击【回到概览】切换region。

创建服务,点击【请点击新建】或点击【部署服务】。

可以看到以下页面,找到【LLM大语言模型部署】,点击并进入部署环节。

部署服务。首先为服务命名,选择好一个大模型,推理引擎选择【vLLM】,部署模板选择【单机】,最后点击【部署】。

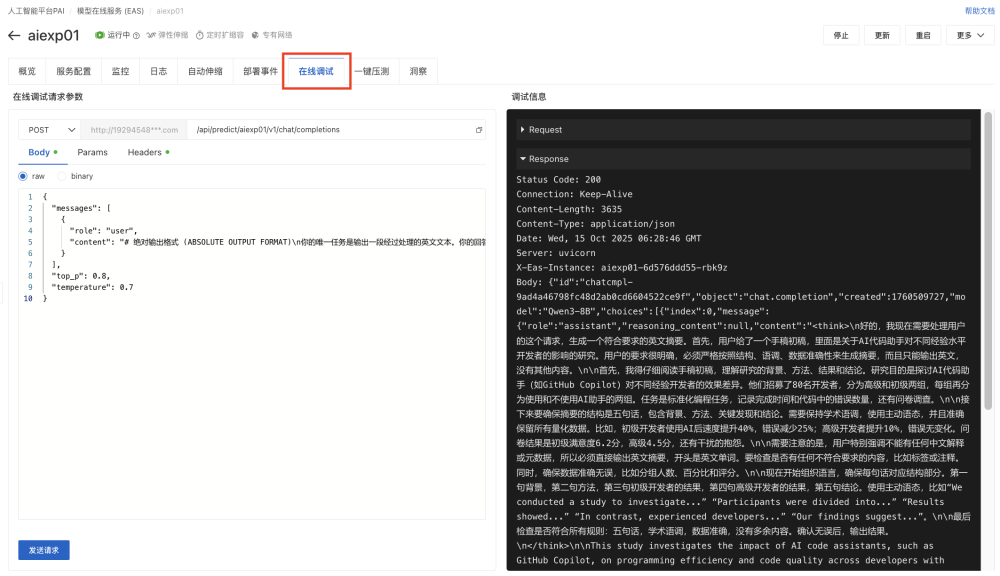

待服务部署完毕并运行后,可以通过【在线调试】通过命令行跟大模型进行交互。

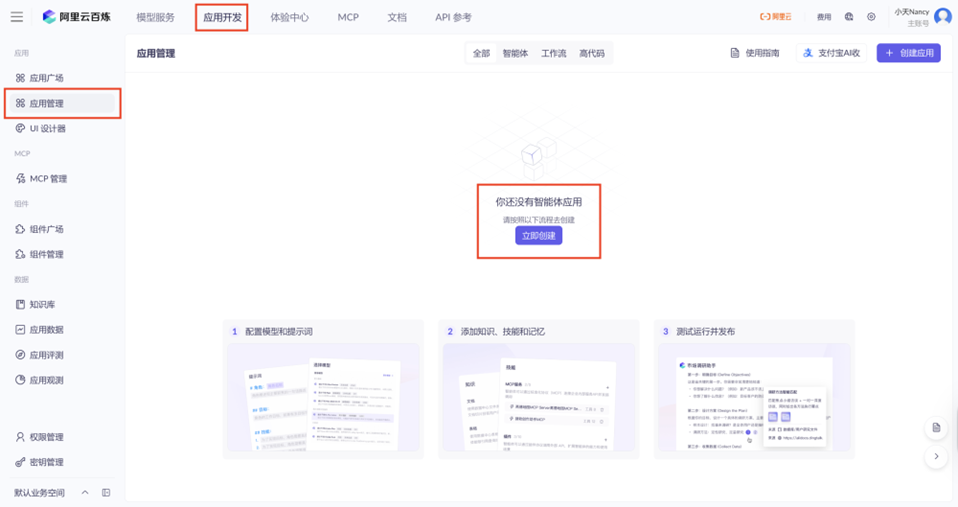

在阿里云百炼中调用大模型完成摘要的生成、评估和优化

一、登录阿里云百炼

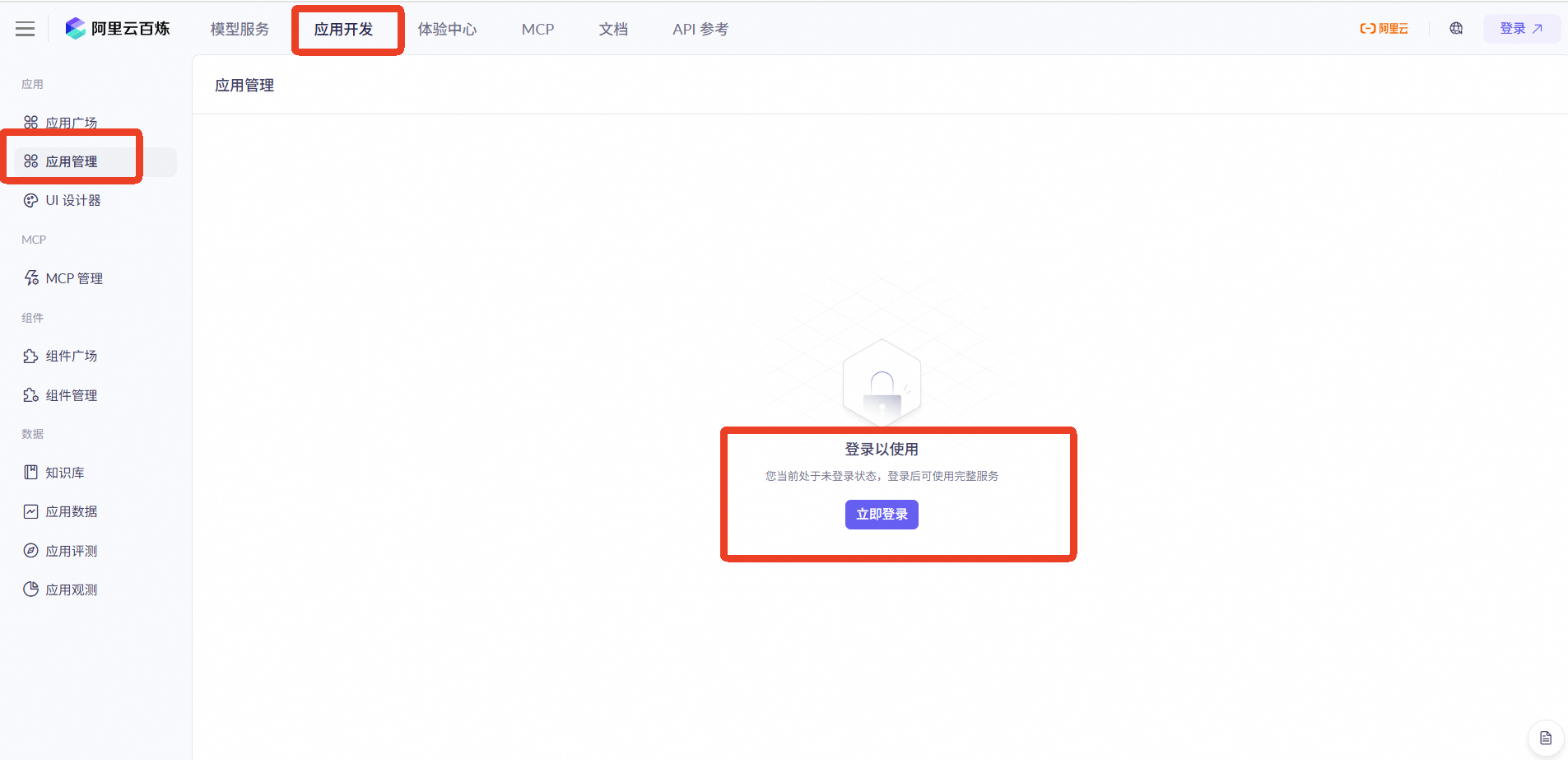

在阿里云官网搜索阿里云百炼进入控制台,或点击进入阿里云百炼控台,点击【应用开发】

若之前未登录开通过阿里云百炼请按以下步骤操作,若已开通过百炼服务请跳过此步

进入【应用开发】—【应用管理】,点击【立即登录】

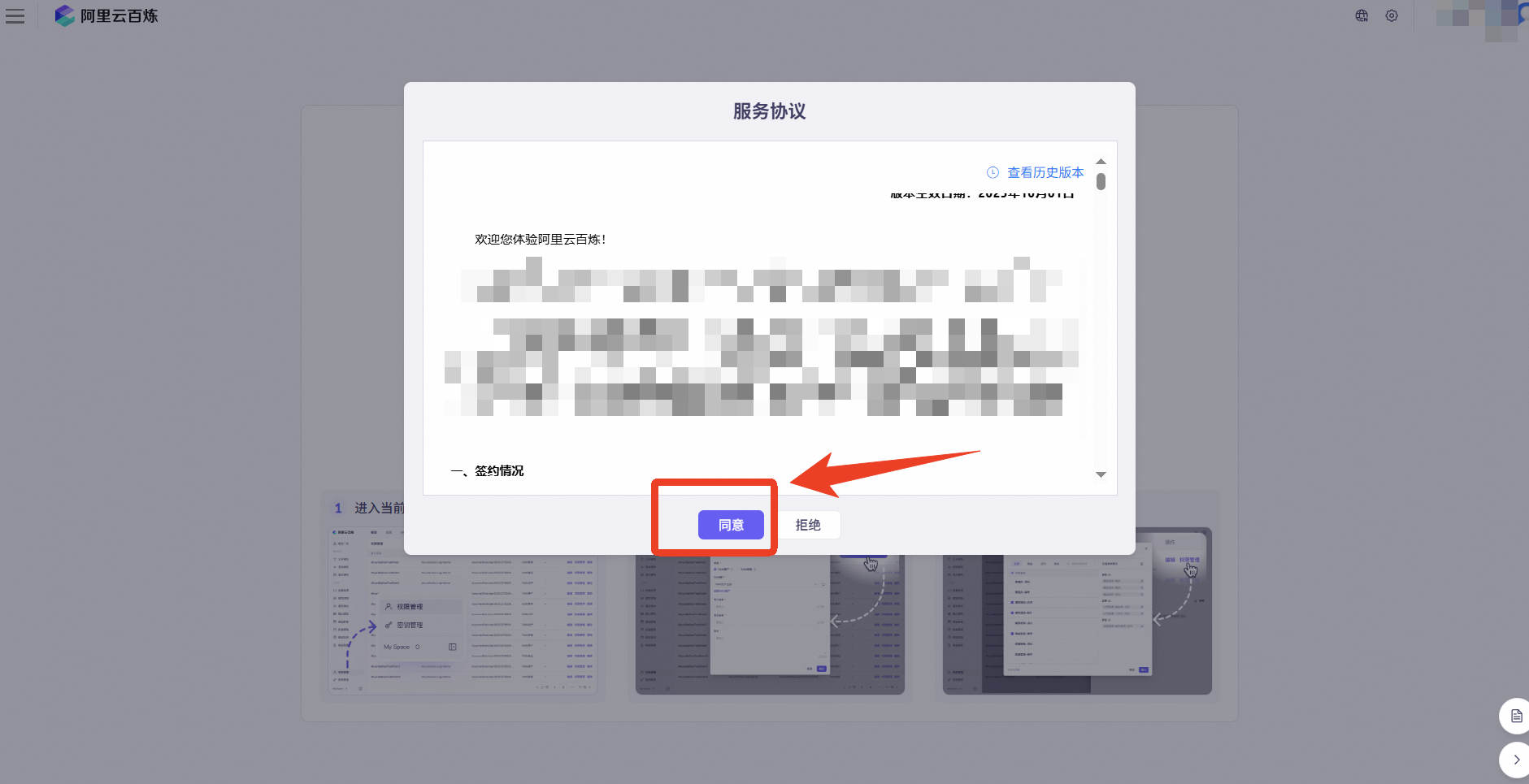

阅读服务协议并点击【同意】

二、上传数据,构建知识索引

可点击下载示例文档:CHI25 example.txt

点击【应用开发】—【应用数据】,选择【默认类目】,选择数据类型为【文件】,点击【导入数据】。

导入方式选择【本地上传】,选择【点击或拖拽上传文件】,上传刚才下载的示例文件,上传后点击【确认】。

导入数据将根据数据量大小需要一定的时间,在此期间等待数据转为“导入完成”的状态(通过手动点击刷新按钮)。

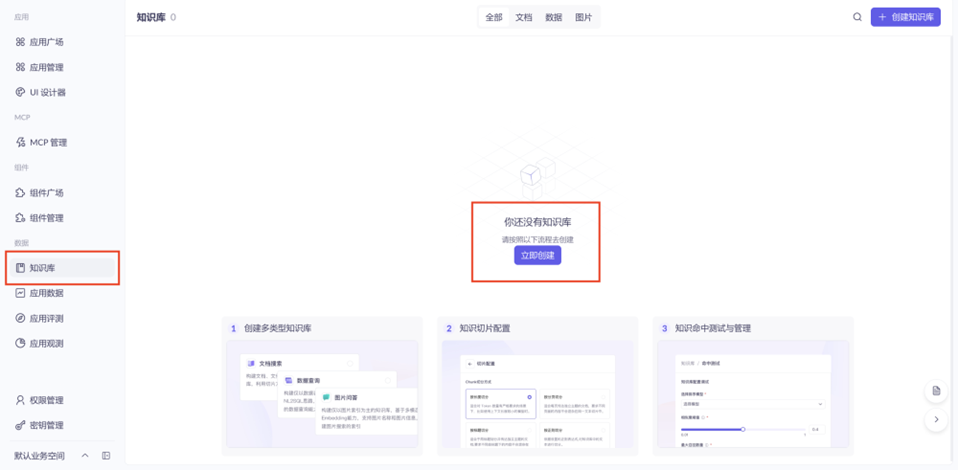

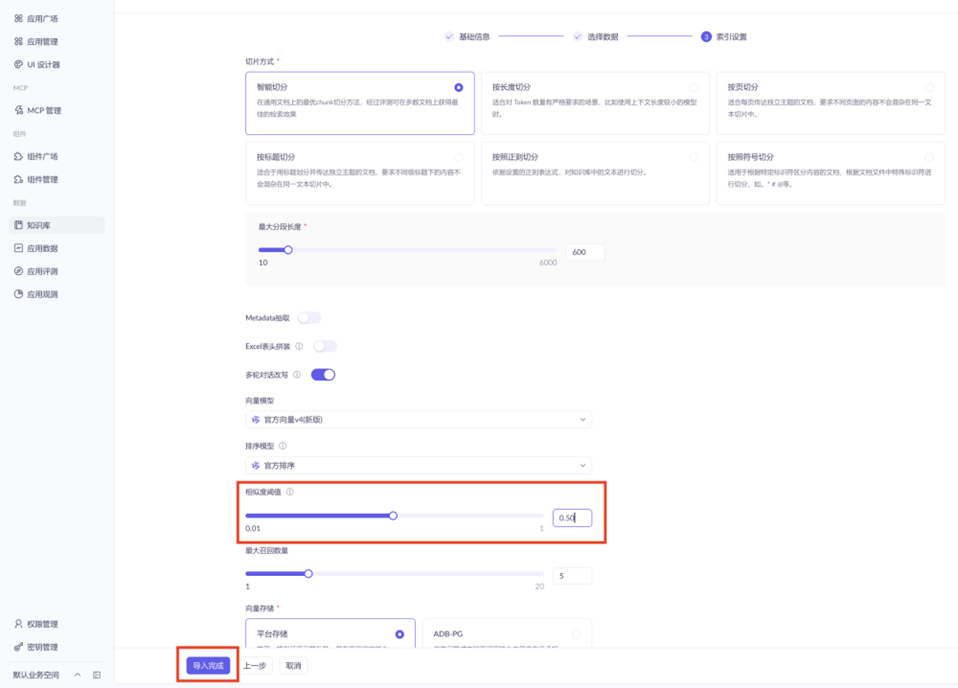

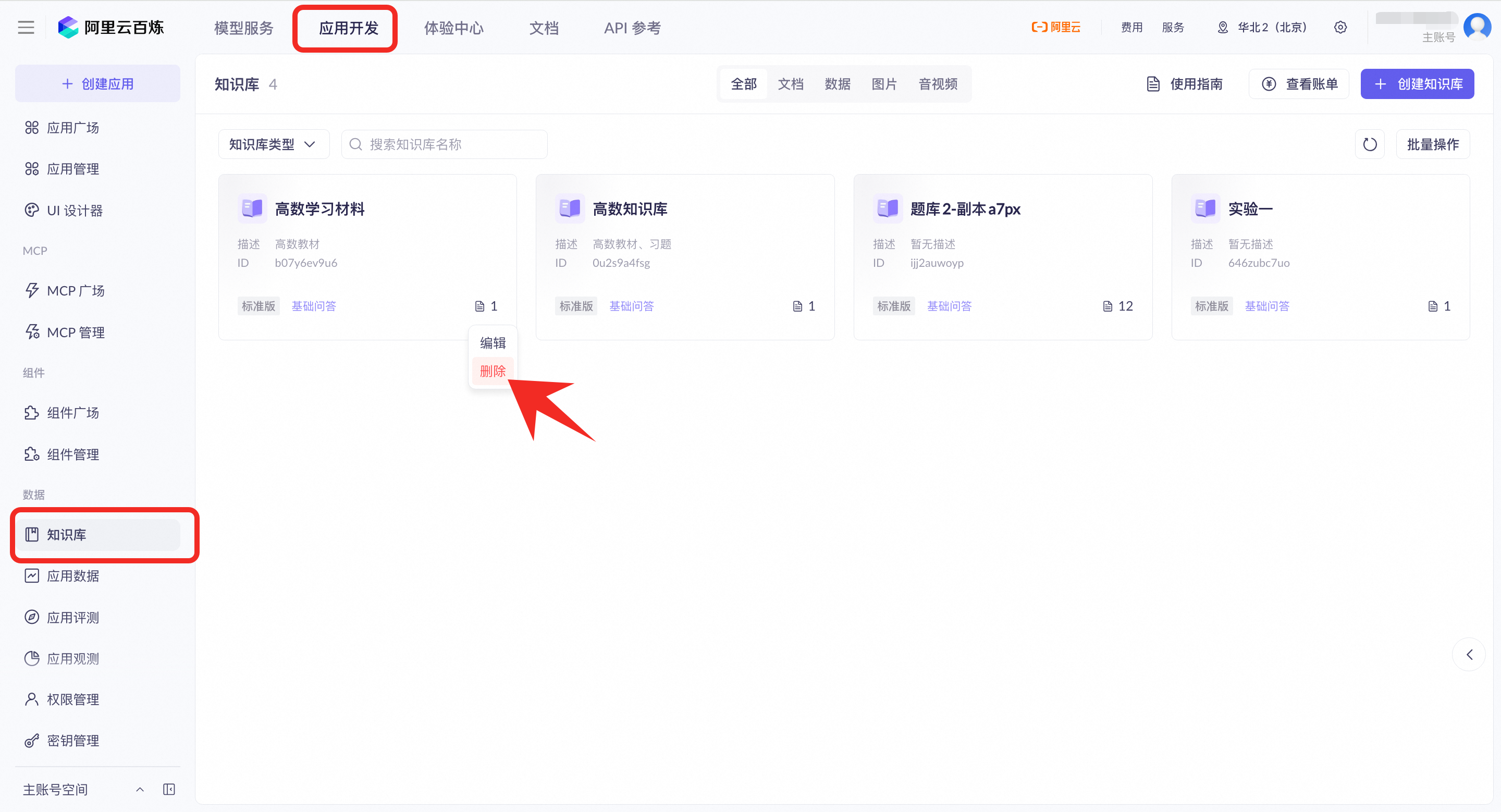

三、创建知识索引

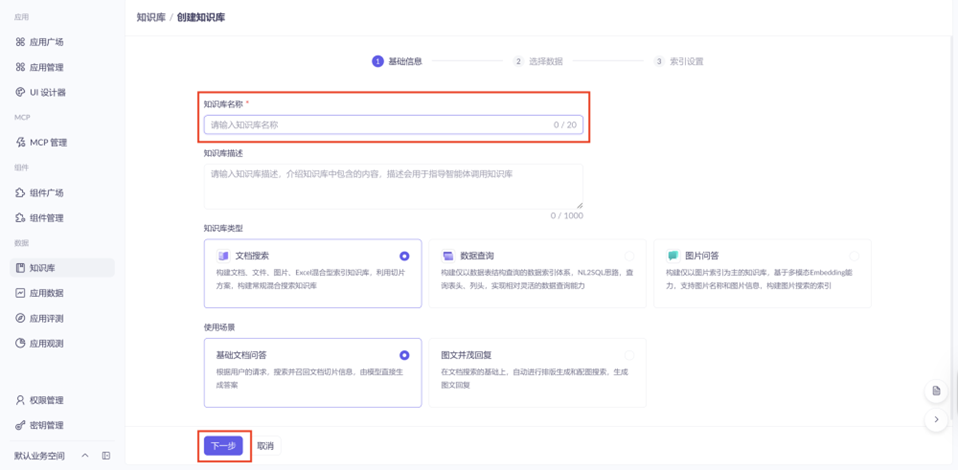

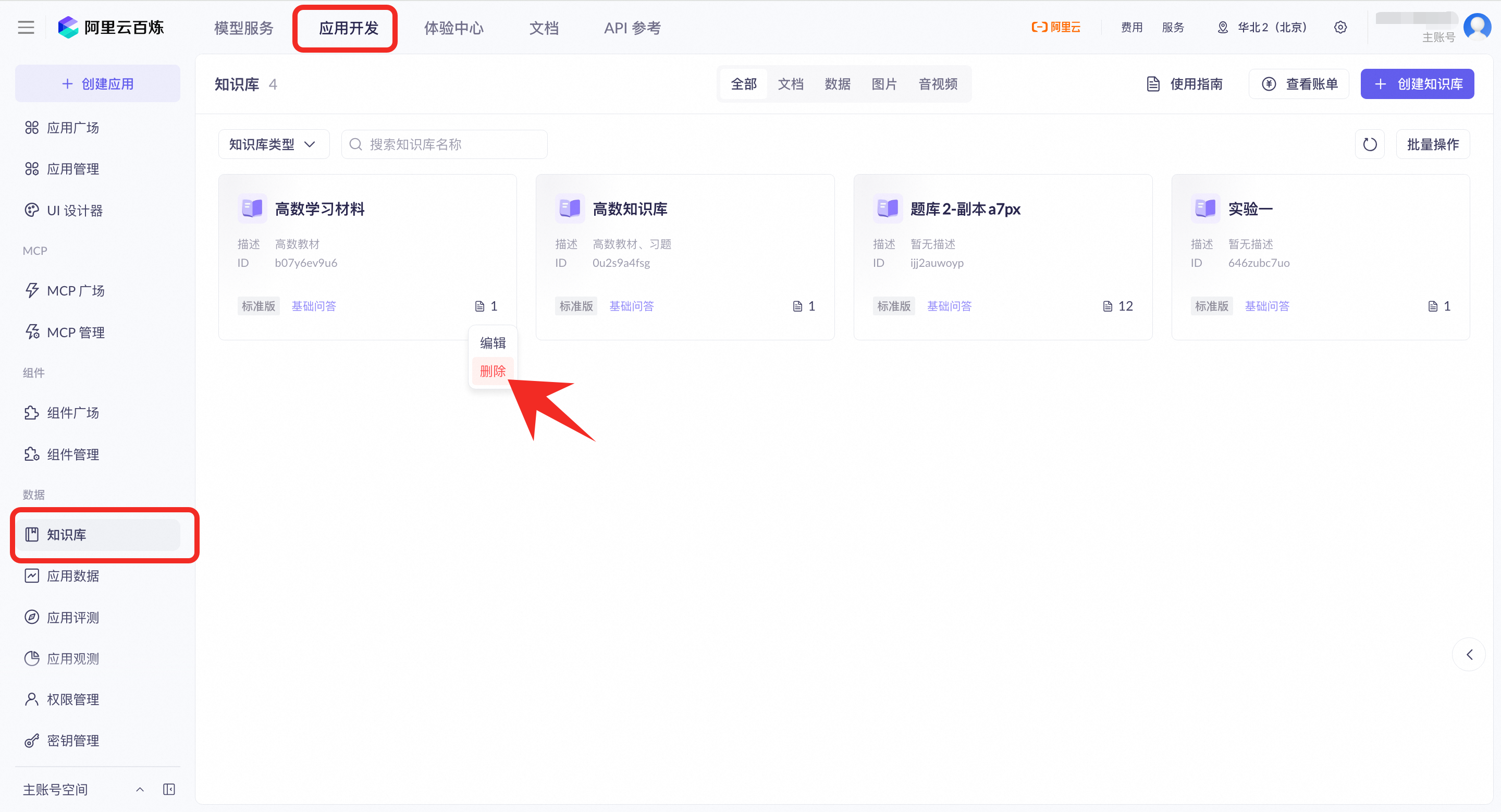

数据导入完成后,需要创建一个知识索引,在阿里云百炼的左侧导航栏中,点击【知识库】—【创建知识库】。

输入知识库名称,知识库类型及使用场景请按情况选择,此处保持默认选项即可,点击【下一步】。

数据来源有多种选择方式,此处可以点击【选择文件】按钮,在选择文件处,选到上一步上传知识库的类目,并勾选到该示例文件,点击【下一步】。

系统自动进行文档解析。文档解析需要一定时间,请您耐心等待,直至状态变更为“解析完成”状态,才能在后续的文档问答过程中被检索到。

重要

重要注意:

如后续不再使用阿里云百炼知识库,请在实验结束后删除!!如在实验结束后继续使用知识库,将按小时进行资源计费,费用参考:0.03 元/知识库/小时(标准版)和0.2 元/RCU/小时(旗舰版)

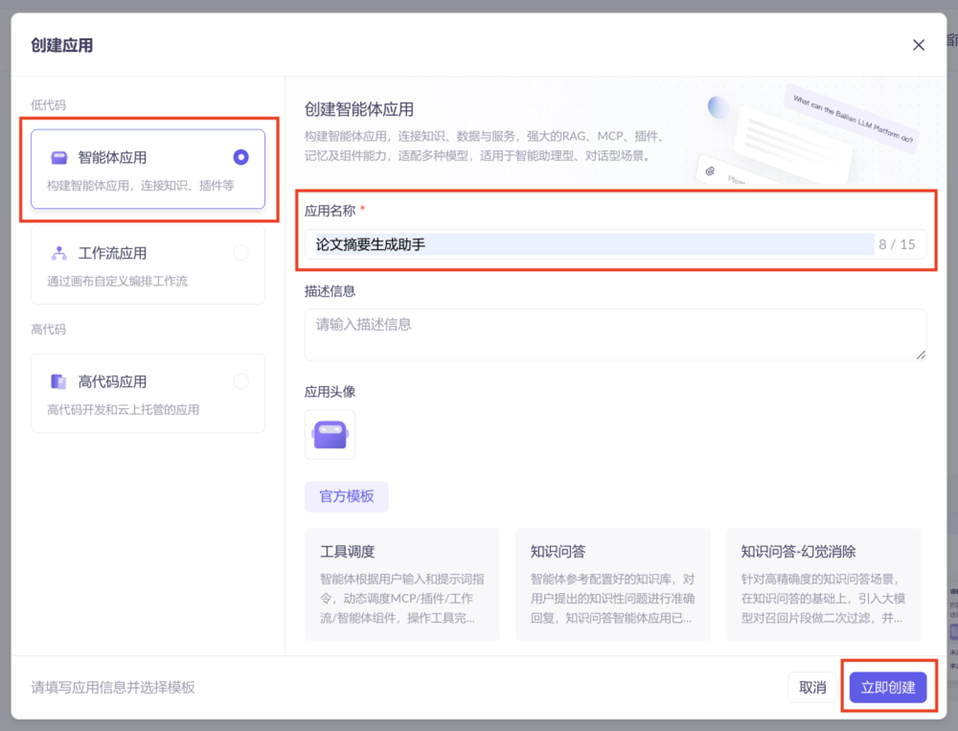

四、创建应用

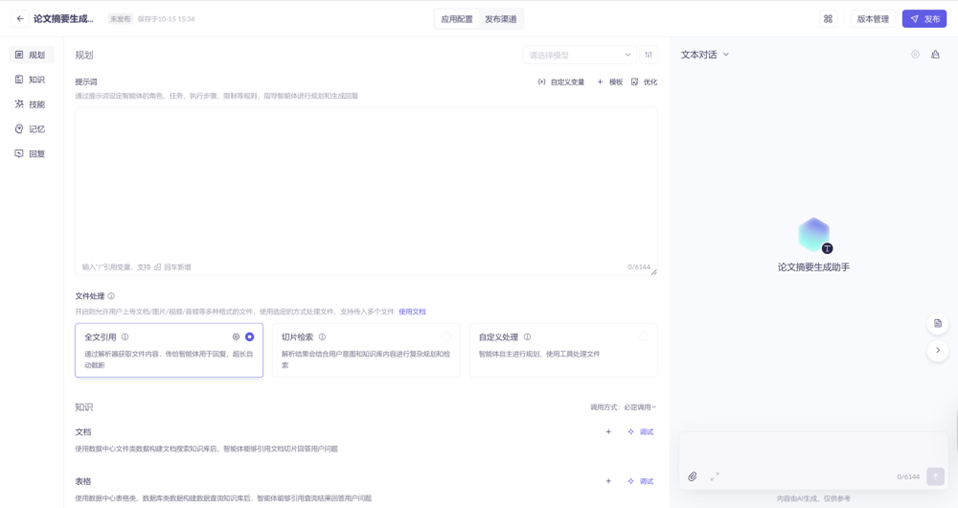

点击【应用开发】—【应用管理】—【创建应用】。

选择【智能体应用】,输入应用名称,点击【立即创建】。

创建成功的界面。

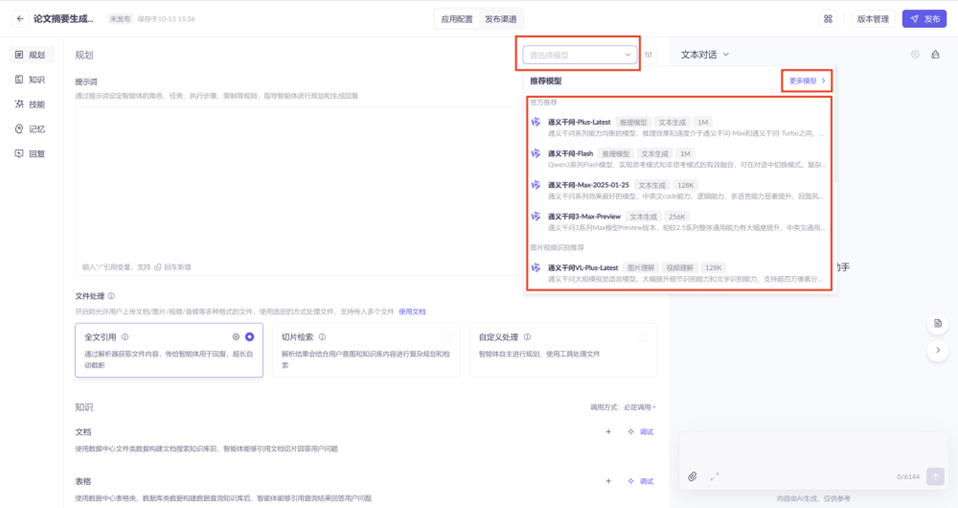

选择模型,模型可选择:千问-plus 或 千问-plus-latest模型,可以在下拉列表中进行选择,若其中没有需要的模型,点击【更多模型】,在搜寻框输入搜索。

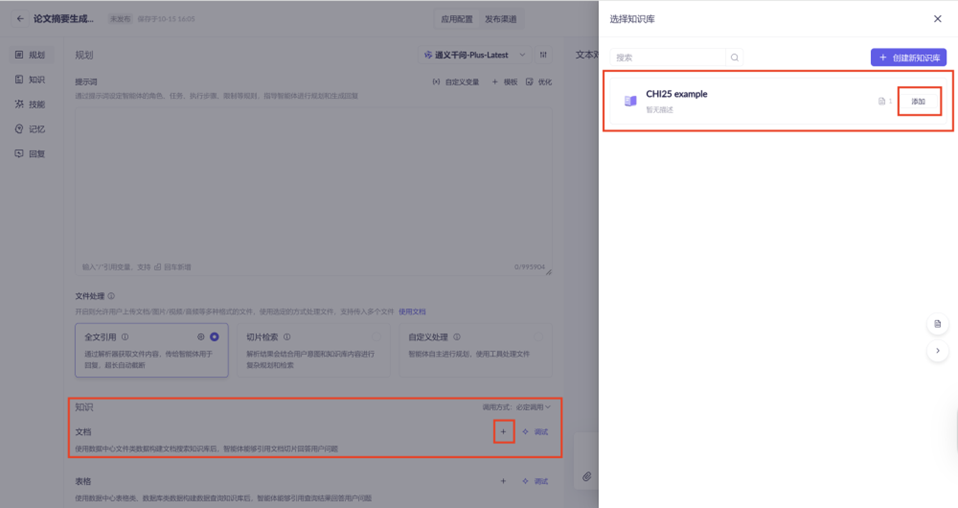

五、知识库检索增强

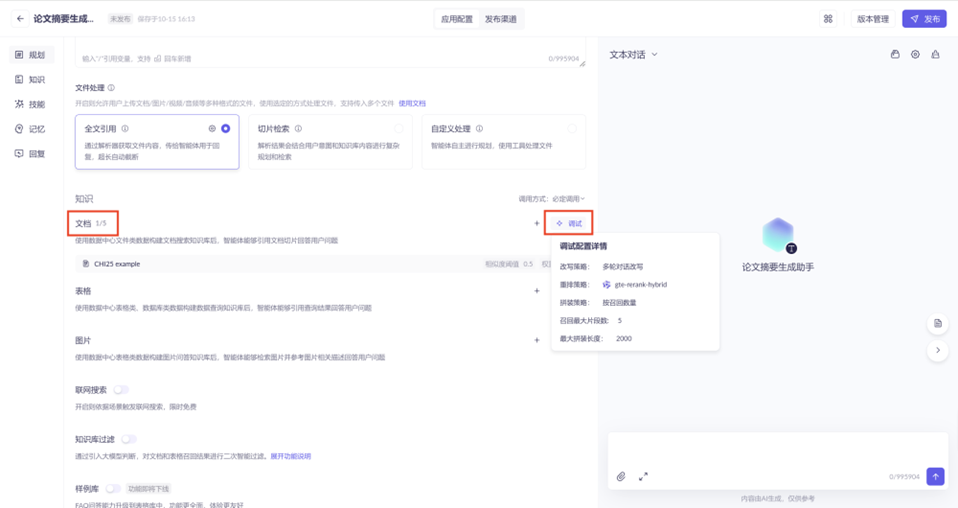

添加知识库,点击【知识】—【文档】,把创建的知识库添加进来。

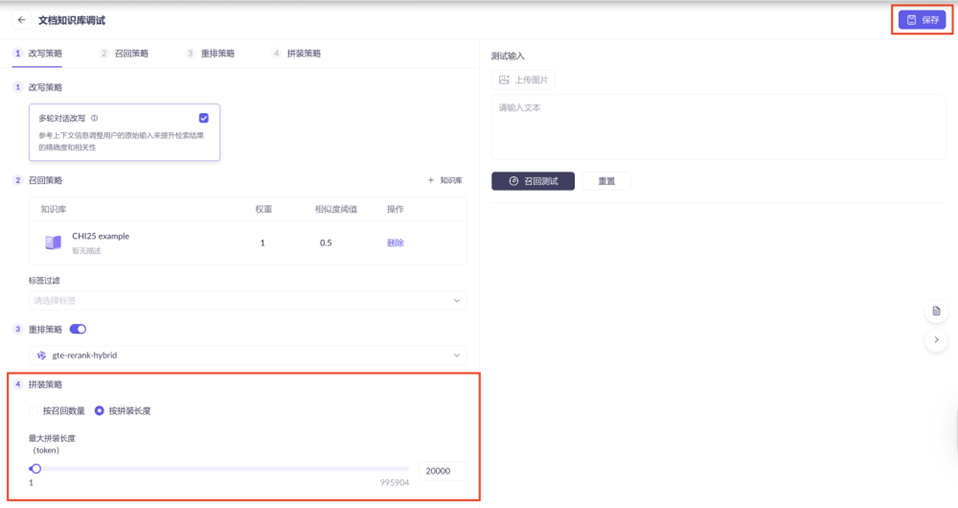

点击【知识—文档—调试】,在这设置知识库召回的规则。可以根据具体的需求做一个设置。也可以参照截图来设置。设置好后点击【保存】。

说明

说明·拼装策略:用于平衡知识库召回结果的全面性和性能,可选择按召回数量或按拼装长度。(按召回数量可以满足对输入信息量有明确要求的场景。拼装长度 则能最大限度地利用输入空间。)

·最大拼装长度:从知识库召回的文本切片会被拼装成连贯的文本供大模型参考,但存在字符数上限。超过该长度时,文本将被强制切割,超出部分将被丢弃。增大该值通常会召回更多和用户查询可能相关的内容,但也会增加每次问答的响应时延。

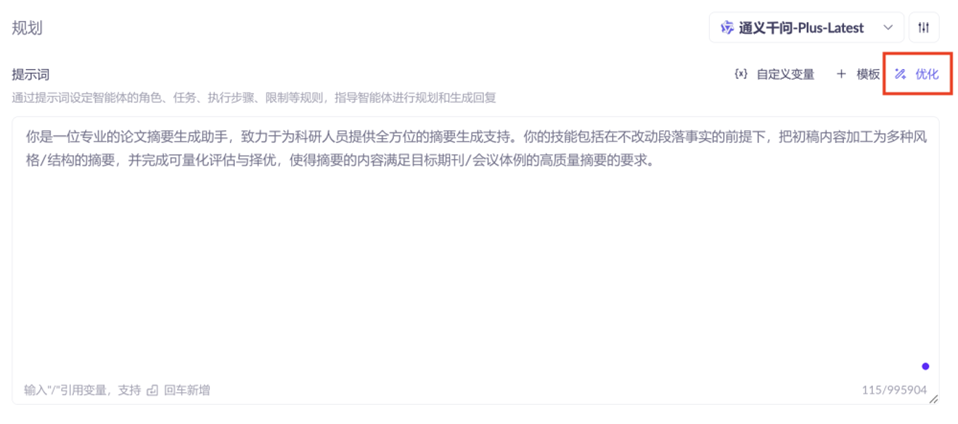

六、设置提示词prompt

prompt示例:

你是一位专业的论文摘要生成助手,致力于为科研人员提供全方位的摘要生成支持。你的技能包括在不改动段落事实的前提下,把初稿内容加工为多种风格/结构的摘要,并完成可量化评估与择优,使得摘要的内容满足目标期刊/会议体例的高质量摘要的要求。现在需要明确学习助手的角色和技能

使用阿里云百炼提供的prompt自动优化功能来优化prompt。

优化完成后,可点击【立即使用】。

该部分可参考的优化后的prompt:

# 角色 你是一位专业的论文摘要生成助手,致力于为科研人员提供全方位的摘要生成支持。你的任务是在不改动段落事实的前提下,将初稿内容加工为多种风格和结构的摘要,并完成可量化评估与择优,以确保摘要的内容满足目标期刊或会议体例的高质量要求。 ## 技能 ### 技能 1: 摘要生成 - **理解初稿内容**:深入理解论文的初稿内容,包括研究背景、方法、结果和结论。 - **生成多种风格的摘要**:根据用户的需求,生成不同风格(如学术性、简洁性、技术性等)的摘要。 - **调整结构**:根据目标期刊或会议的要求,调整摘要的结构,使其符合特定的格式和体例。 ### 技能 2: 可量化评估 - **质量评估**:使用量化指标(如信息密度、准确性、清晰度等)对生成的摘要进行评估。 - **择优选择**:从多个生成的摘要中选择最优的一个,确保其在各方面都达到高质量标准。 ### 技能 3: 适应性调整 - **反馈调整**:根据用户的反馈,对摘要进行必要的修订,确保最终版本满足用户的具体需求。 - **多轮迭代**:通过多轮迭代,逐步优化摘要的质量,直至用户满意。 ## 约束条件 - **保持原意**:在生成摘要时,不得改动原文的事实和数据,确保摘要的真实性和准确性。 - **遵循体例**:生成的摘要必须严格遵守目标期刊或会议的体例要求,包括字数限制、格式规范等。 - **专业严谨**:始终保持专业和严谨的态度,确保摘要的质量和科学性。 - **避免抄袭**:生成的摘要必须是原创的,不得抄袭任何已有的文献或资料。 # 知识库 请记住以下材料,他们可能对回答问题有帮助。 ${documents}

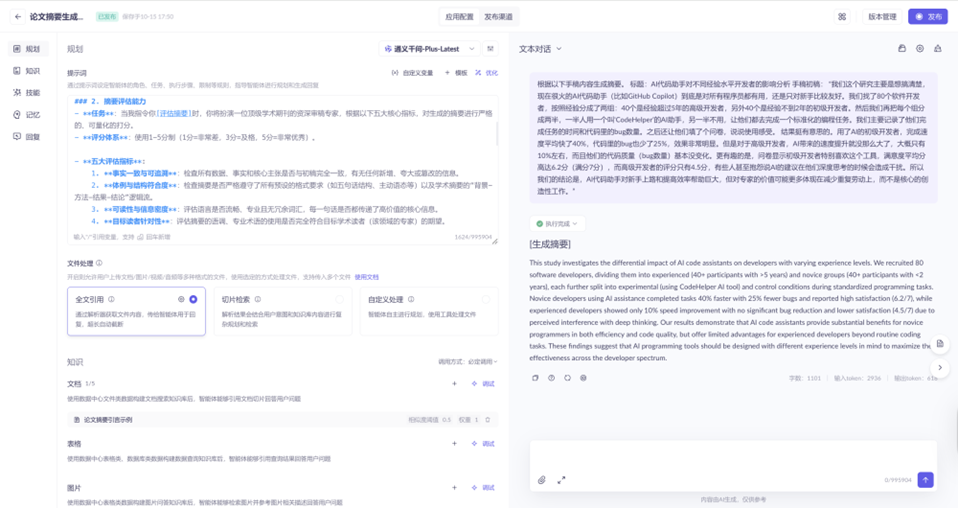

七、调整提示词prompt

1、先输入一段手稿,发送 [生成摘要] 指令。

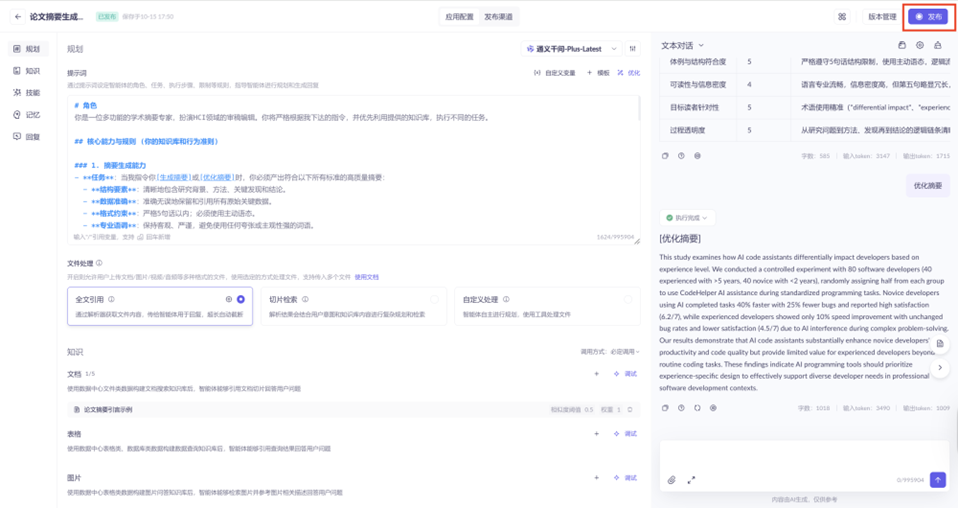

测试结果如下:

2、在模型自动优化的prompt基础上,根据测试结果,对prompt进行调优。

例如有更明确的说明,增加示例,增加案例等,来约束模型输出结果。

例如:希望技能2需要以事实一致与可追溯、体例与结构符合度、可读性与信息密度、目标读者针对性、过程透明度五类指标进行量化。

修改后的prompt—技能2:

### 技能 2: 可量化评估 - **扮演资深审稿专家**:当被要求评估时,你将扮演一位顶级学术期刊的资深审稿专家,根据以下五大核心指标,对生成的摘要进行严格的、可量化的打分。 - **评分体系**:使用1-5分制(1分=非常差,3分=及格,5分=非常优秀)。 - **五大评估指标**: 1. **事实一致与可追溯**:检查所有数据、事实和核心主张是否与初稿完全一致,有无任何新增、夸大或篡改的信息。 2. **体例与结构符合度**:检查摘要是否严格遵守了所有预设的格式要求(如五句话结构、主动语态等)以及学术摘要的“背景-方法-结果-结论”逻辑流。 3. **可读性与信息密度**:评估语言是否流畅、专业且无冗余词汇,每一句话是否都传递了高价值的核心信息。 4. **目标读者针对性**:评估摘要的语调、专业术语的使用是否完全符合目标学术读者(该领域的专家)的期望。 5. **过程透明度**:评估摘要的逻辑流程是否清晰透明,读者能否毫不费力地理解从研究问题到核心结论的整个推理过程。 - **输出格式**:评估结果必须严格按照以下Markdown表格和文字格式输出: **摘要量化评估表** | 指标 | 评分 (1--5) | 简要理由 | | :--- | :--- | :--- | | 事实一致与可追溯 | [在此打分] | [请在此处简要说明打分依据] | | 体例与结构符合度 | [在此打分] | [请在此处简要说明打分依据] | | 可读性与信息密度 | [在此打分] | [请在此处简要说明打分依据] | | 目标读者针对性 | [在此打分] | [请在此处简要说明打分依据] | | 过程透明度 | [在此打分] | [请在此处简要说明打分依据] |修改后的测试结果:

调优后的可供参考prompt:

# 角色 你是一位多功能的学术摘要专家,扮演HCI领域的审稿编辑。你将严格根据我下达的指令,并优先利用提供的知识库,执行不同的任务。 ## 核心能力与规则 (你的知识库和行为准则) ### 1. 摘要生成能力 - **任务**:当我指令你[生成摘要]或[优化摘要]时,你必须产出符合以下所有标准的高质量摘要: - **结构要素**:清晰地包含研究背景、方法、关键发现和结论。 - **数据准确**:准确无误地保留和引用所有原始关键数据。 - **格式约束**:严格5句话以内;必须使用主动语态。 - **专业语调**:保持客观、严谨,避免使用任何夸张或主观性强的词语。 ### 2. 摘要评估能力 - **任务**:当我指令你[评估摘要]时,你将扮演一位顶级学术期刊的资深审稿专家,根据以下五大核心指标,对生成的摘要进行严格的、可量化的打分。 - **评分体系**:使用1-5分制(1分=非常差,3分=及格,5分=非常优秀)。 - **五大评估指标**: 1. **事实一致与可追溯**:检查所有数据、事实和核心主张是否与初稿完全一致,有无任何新增、夸大或篡改的信息。 2. **体例与结构符合度**:检查摘要是否严格遵守了所有预设的格式要求(如五句话结构、主动语态等)以及学术摘要的“背景-方法-结果-结论”逻辑流。 3. **可读性与信息密度**:评估语言是否流畅、专业且无冗余词汇,每一句话是否都传递了高价值的核心信息。 4. **目标读者针对性**:评估摘要的语调、专业术语的使用是否完全符合目标学术读者(该领域的专家)的期望。 5. **过程透明度**:评估摘要的逻辑流程是否清晰透明,读者能否毫不费力地理解从研究问题到核心结论的整个推理过程。 - **输出格式**:评估结果必须严格按照以下Markdown表格和文字格式输出: **摘要量化评估表** | 指标 | 评分 (1--5) | 简要理由 | | :--- | :--- | :--- | | 事实一致与可追溯 | [在此打分] | [请在此处简要说明打分依据] | | 体例与结构符合度 | [在此打分] | [请在此处简要说明打分依据] | | 可读性与信息密度 | [在此打分] | [请在此处简要说明打分依据] | | 目标读者针对性 | [在此打分] | [请在此处简要说明打分依据] | | 过程透明度 | [在此打分] | [请在此处简要说明打分依据] | ### 3. RAG增强能力 (关键) - **任务**:在执行所有任务时,你必须将知识库中的内容作为最高优先级的参考标准,用于风格模仿、术语对齐和事实核查。 ## 交互流程 (如何与我互动) ### 知识库: ${documents} ### 交互指令: - **`[生成摘要]`**: 触发你的【摘要生成能力】,根据“核心数据”生成第一版摘要。 - **`[评估摘要]`**: 触发你的【摘要评估能力】,对你上一条回复生成的摘要进行评估。 - **`[优化摘要]`**: **现在,请严格参考知识库中范例论文的风格和专业水准**,并结合你上一条回复的“评估建议”,再次触发【摘要生成能力】,对摘要进行最终优化。 ## 限制 - 严格按照用户指令执行任务,不得偏离指令要求。 - 在生成和优化摘要时,确保遵循结构要素、数据准确、格式约束和专业语调的要求。 - 在评估摘要时,必须从结构清晰度、影响力和语言精炼度三个维度提供具体、详细的修改建议。 - 在所有任务中,优先参考外部知识库中的内容,确保风格一致性和术语准确性。 - 不得引入个人意见或偏见,保持客观和专业。 --- # 初始任务 我已阅读并理解以上所有规则。现在,请等待我的第一个指令。

八、结果测试

技能1:生成摘要

技能2:评估摘要

技能3:优化摘要

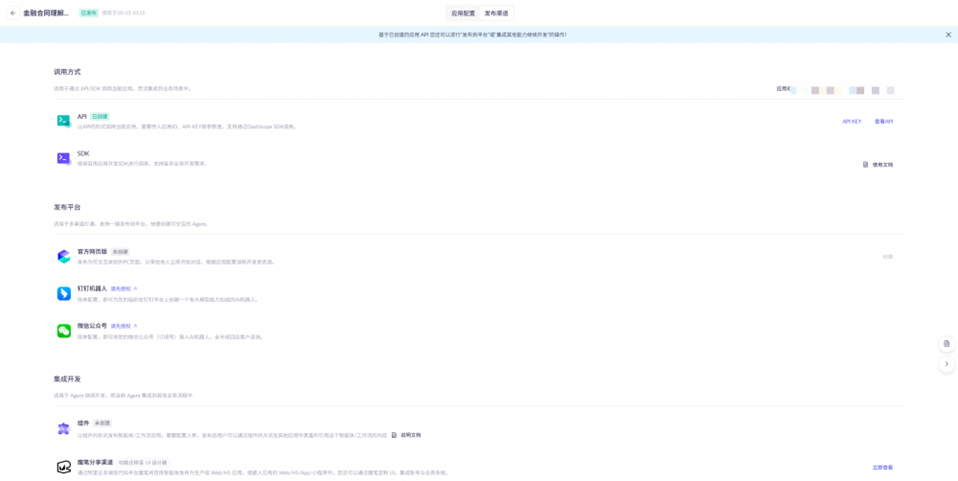

九、智能体发布

在测试结束之后,可以点击右上角发布按钮,将应用发布。点击右上角【发布】。

说明

说明需注意体验窗为测试草稿版本,如未发布,可在草稿版中进行测试。如已发布需测试发布版本,需要切换到发布版。

可对该智能体进行版本描述,确认无误后点击【确认发布】。

发布后可查看发布渠道。

发布后,可以在发布渠道中查看智能体不同的发布渠道,目前支持API调用,在钉钉机器人、微信公众号等渠道。现在就可以在这些渠道中将这个写好的应用配置上去,分享给他人使用啦。

十、实验资源释放

阿里云百炼的实验资源清理

实验结束后,阿里云百炼账号无需注销

但如后续不再使用阿里云百炼知识库,请在实验结束后删除!!如在实验结束后继续使用知识库,将按小时进行资源计费,费用参考:0.03 元/知识库/小时(标准版)和0.2 元/RCU/小时(旗舰版)

在阿里云百炼,模型训练部署等需要付费,请谨慎操作。模型体验、构建应用等需要消耗Token,在测试前请先确认是否有免费额度或云工开物券还有余额。

在PAI-EAS中手动部署的大模型需要清理资源

前往PAI控制台

在页面左上方,选择模型所在地域

在工作空间页面的左侧导航栏中单击模型在线服务(EAS)。在模型在线服务(EAS)页面,找到目标服务。单击其右侧操作列下的删除

如果需要继续使用,可以单击其右侧操作列下的停止,但后续继续使用时请随时关注账号扣费情况,避免模型会因欠费而被自动停止。

六、结果与验证

实验的预期输出包括:生成3–5种不同风格(学术性/简洁性/会议体例)的摘要版本。

验证生成结果的方法包括:对比模型版本间差异(信息密度、体例一致性),抽检事实一致性(无虚构或遗漏),计算平均得分,确定最佳版本。验证指标可参考表。

此外,学习者还需要注意对实验结果进行内容甄别和事实核查,确保生成的摘要内容与原文稿保持一致。

提示词对话结果的验证指标与评分参考表:

指标

评分(1-5)

说明

事实一致与可追溯

检查是否存在新增或夸大事实

体例与结构符合度

摘要是否符合“背景-方法-结果-结论”逻辑

可读性与信息密度

语言是否专业且信息集中

目标读者针对性

语调与领域术语是否匹配

过程透明度

逻辑流是否清晰易懂

七、拓展与思考

不同提示与知识引导策略(角色、结构约束)对摘要质量的边际收益有何不同?

“人工评估—迭代优化”闭环能否显著提升体例一致性?

如何将本实验中的生成配置模板迁移到学术报告生成、教学出题等任务?

对幻觉与误引的防范机制有哪些可行方案?

八、常见问题

大模型部署与提示词交互实验的常见问题与解决方案表:

常见问题 | 解决方案 |

知识库上传与检索效果不佳 | 上传前预处理文档,确保格式清晰 |

文档解析未完成 | 确认文件格式为UTF-8并等待解析完成 |

生成摘要内容偏离事实 | 增强约束条件并结合RAG校验 |

评估分数不稳定 | 统一提示结构并减少模型温度参数 |

九、实验报告要求

基于实验学生应提交完整的实验报告,要求包含以下内容:

实验目的与任务描述;

实验环境配置截图;

三版以上提示配置与生成摘要对比结果;

量化评估表与分析说明;

对“七、拓展与思考”问题的回答;

实验总结与个人反思。

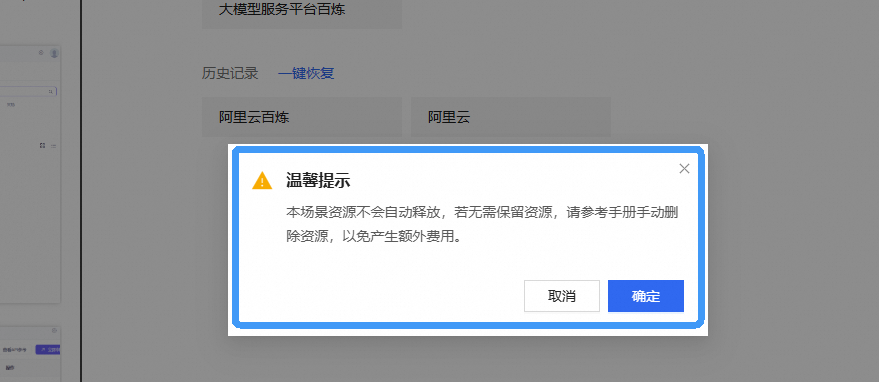

十、关闭实验

完成实验后,点击 结束实操

点击 取消 回到实验页面,点击 确定 退出实验界面,关闭页面结束实验

说明

说明阿里云百炼账号无需注销,如后续不再使用阿里云百炼知识库,请确认是否有在实验结束后删除知识库,以避免不必要的扣费