PAI-ArtLab魔搭训练工具是阿里巴巴魔搭团队、PAI-ArtLab团队共同推出的LoRA模型训练工具,用户可基于少量图片素材,对Qwen-Image、Qwen-Image-Edit、Z-Image、FLUX等大模型进行快速的LoRA微调,得到自己想要的专属风格LoRA模型。该工具与魔搭AIGC专区的模型训练工具有相同的模型训练体验,并使用PAI专享资源,训练不排队。

点击登录PAI ArtLab控制台。

前提条件

(可选)已领取免费试用资源/代金券,或购买资源包,详情请参见PAI ArtLab计费说明。

请在资源/代金券或资源包有效期内使用,详情请参见查看使用额度和期限。

启动工具

登录PAI ArtLab,在工具箱页面,单击魔搭模型训练卡片,启动工具。魔搭模型训练工具的运行资源要求:

推荐配置:CPU/内存 >= 8C64G,显存96G。

最低配置:CPU/内存 >= 8C64G,显存48G(低配置下部分参数量较大模型的LoRA训练效果可能会有极小下降)。

操作步骤

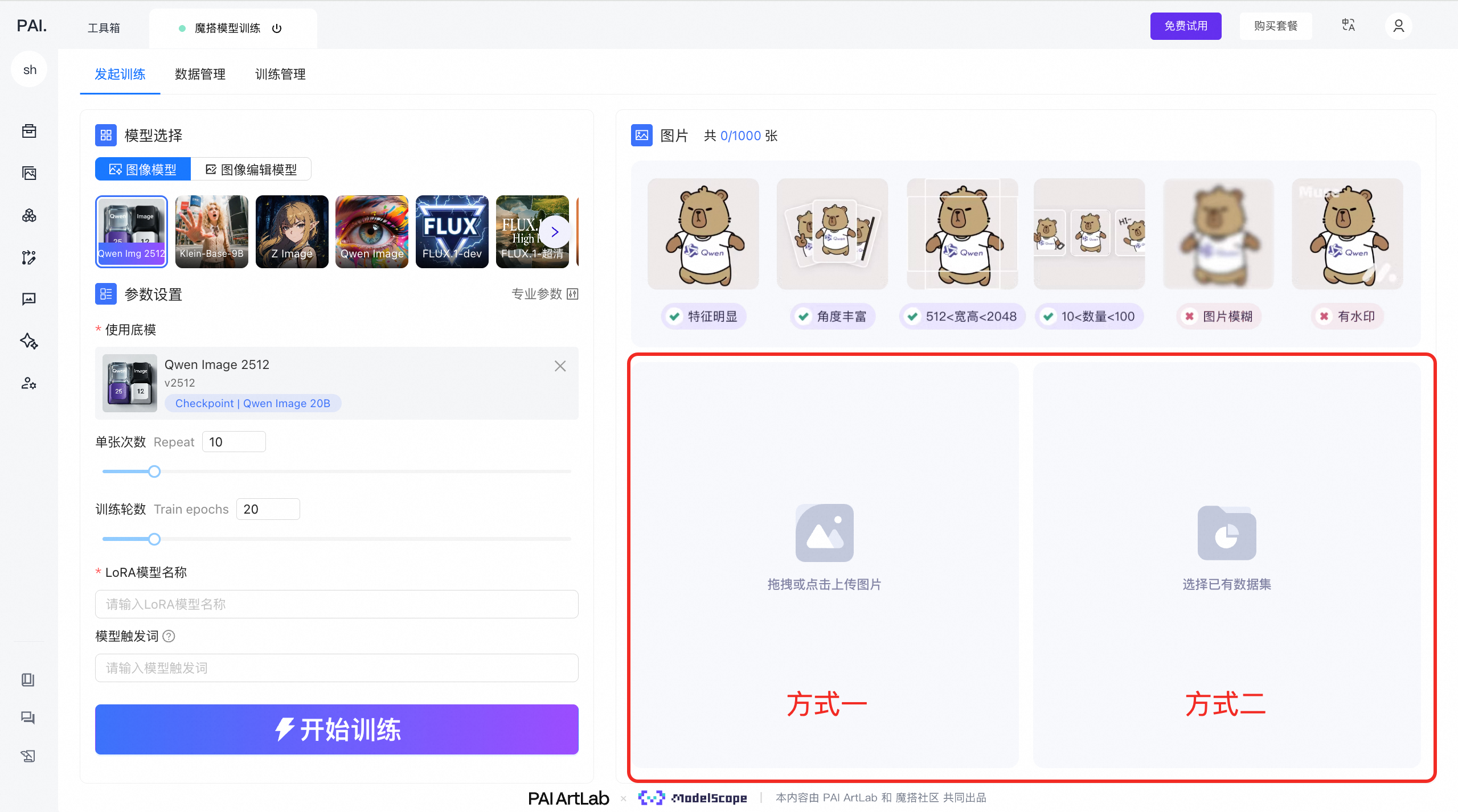

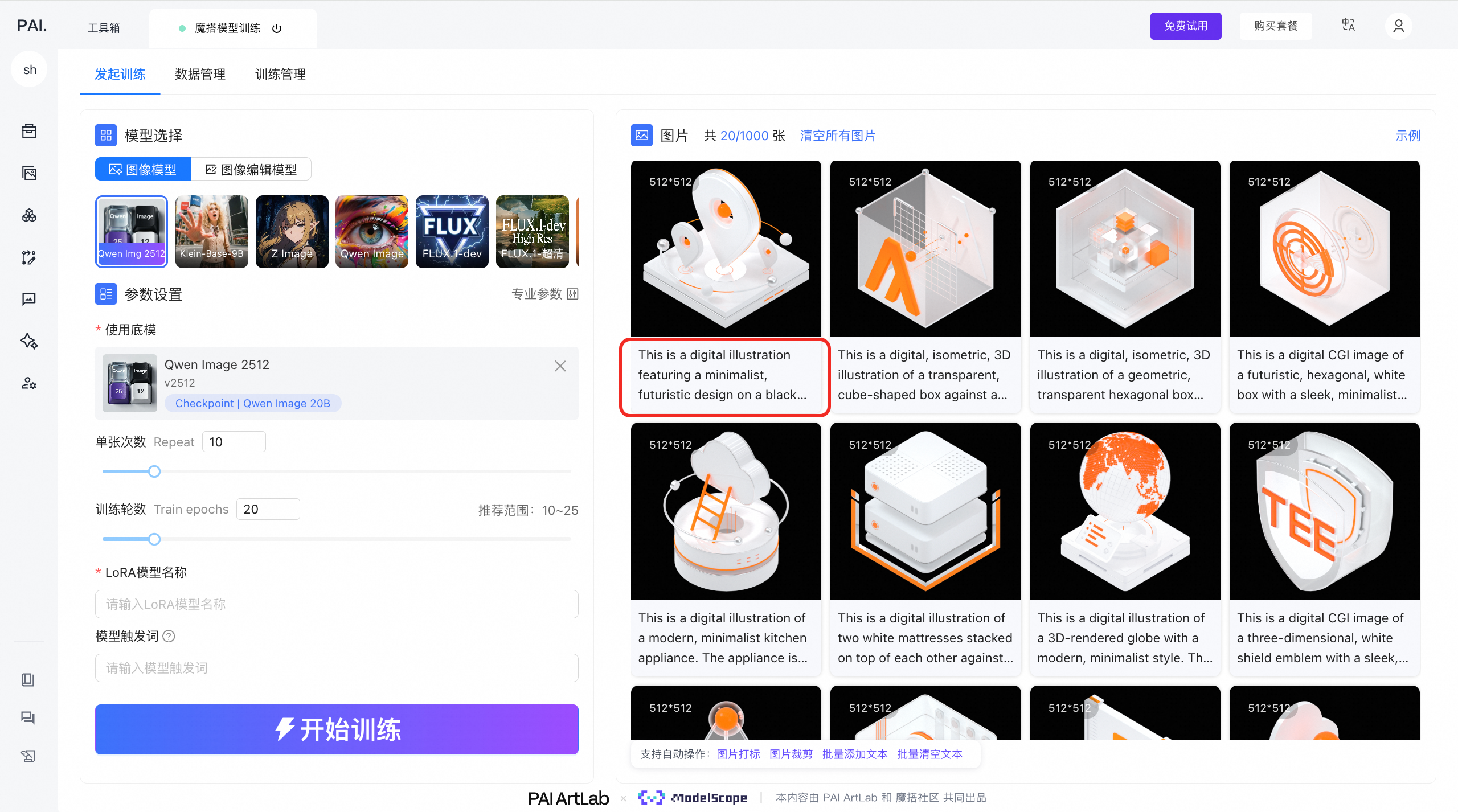

步骤一:上传训练数据

魔搭模型训练工具提供2种上传训练数据的方式:

方式一:在发起训练页面直接从本地上传图片。

方式二:先在数据管理页面创建数据集并上传图片,再在发起训练页面选择已有数据集。

对于方式一,直接从本地上传图片即可,仅支持上传图片,不支持上传标注文件。在一次训练任务中最多支持上传1000张图片(超出1000张一般已不属于LoRA模型训练场景范畴)。

对于方式二,在数据管理页面创建数据集并上传图片,如果已经准备好了标注文件,可以选择压缩包上传方式,支持将图片、标注文件一起上传(标注文件需整理成txt格式,并且命名需要与图片一一对应,例如1.png、1.txt、2.png、2.txt)。

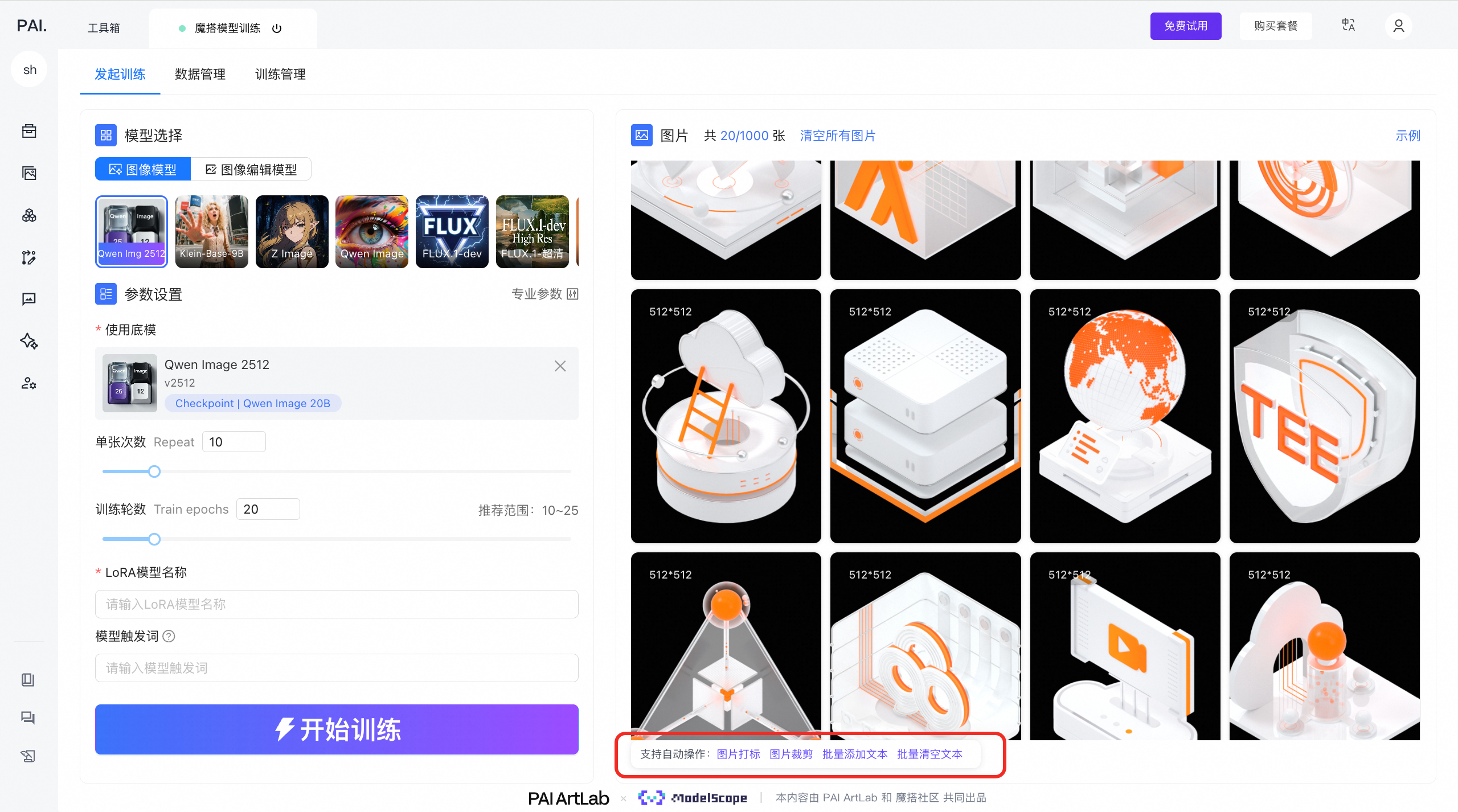

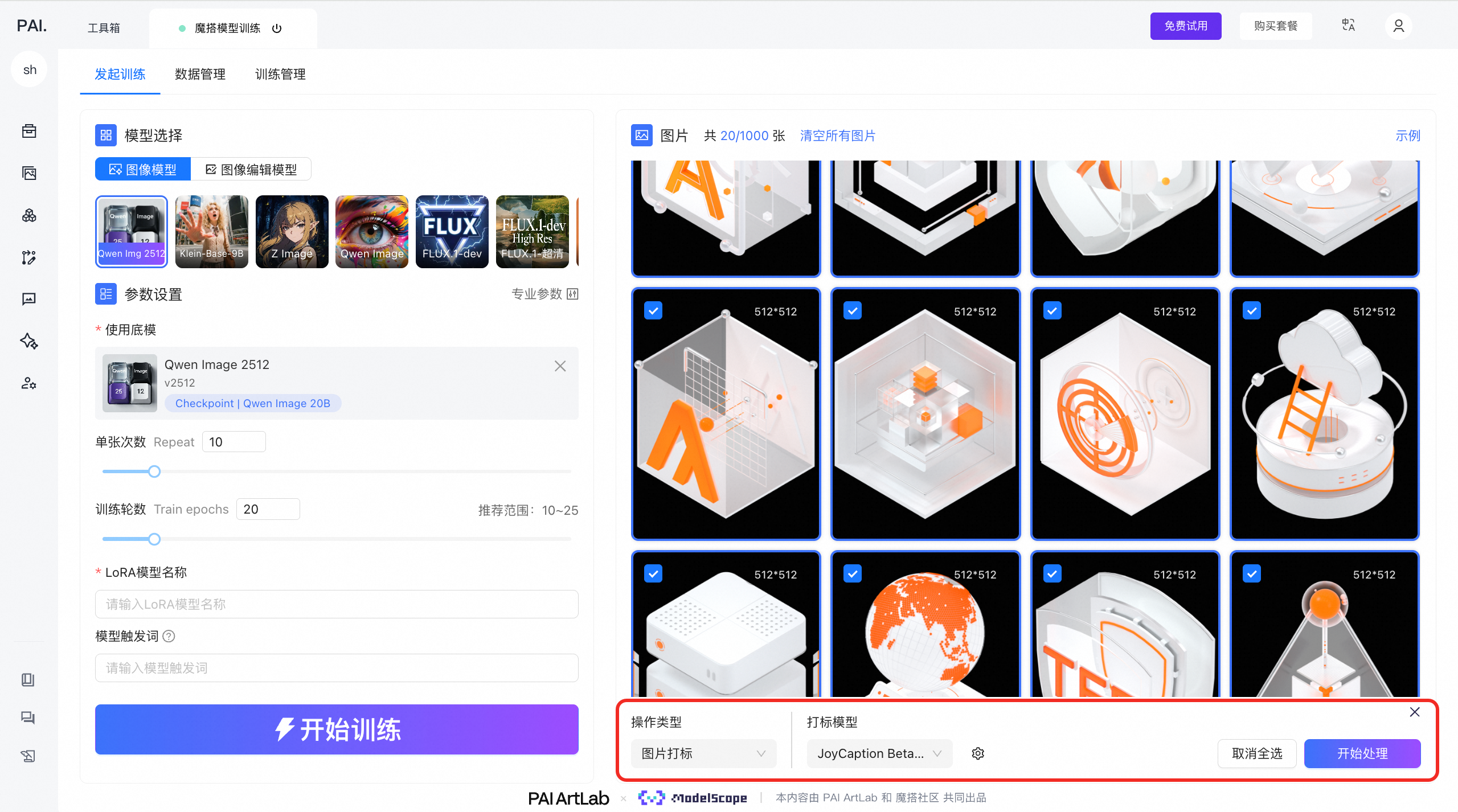

步骤二:图片预处理

在上传图片数据集之后,工具提供了灵活的预处理选项。用户可以使用我们提供的打标功能来为自己的图片进行标注,例如基于JoyCaption模型为您的图片补充丰富且准确的文本描述,并支持手动二次修改标注内容。

如果您是在发起训练页面中直接上传图片,则在训练任务成功发起之后,可以在数据管理页面查看您当前任务所产生的训练数据集与其对应的标注信息。如果您是在数据管理页面操作数据集进行标注,则标注结果直接在数据集中展示出来。

注意图片预处理步骤为可选步骤,即使您在模型启动训练前未标注图片也没有关系,在模型训练任务运行过程中也会先对图片进行打标(但注意此时无法在训练过程中间人工修改图片标注结果)。

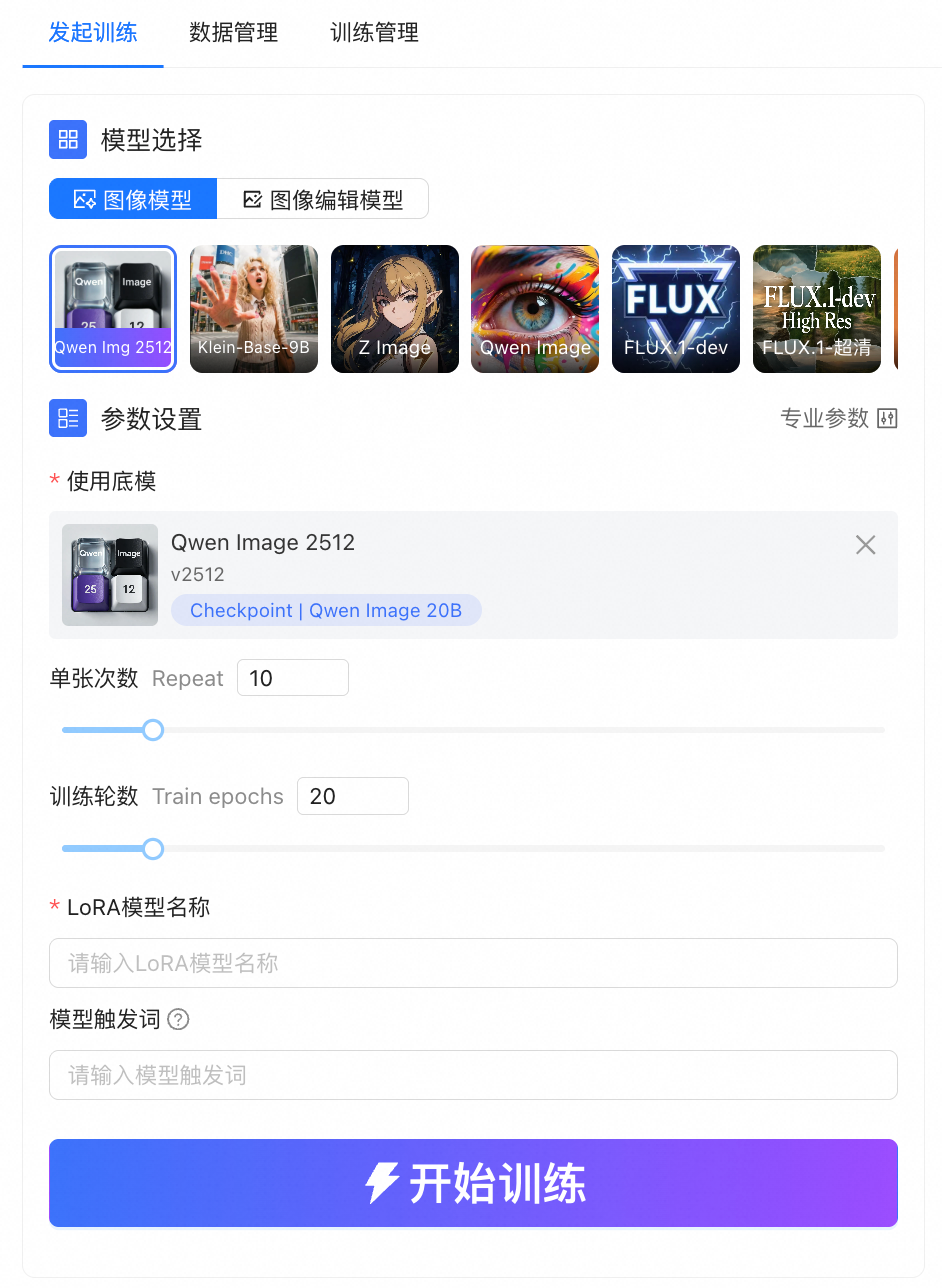

步骤三:训练参数设置

在发起训练页面左侧,选择要训练的基础模型并设置训练参数。

基础模型当前支持图像生成模型、图片编辑模型(视频模型近期将支持),可根据您的需求场景灵活选择。图像生成模型支持Qwen-Image、Z-Image、FLUX等模型的训练;图像编辑模型支持Qwen-Image-Edit等模型的训练,并支持多图(图片组)训练方式。

训练参数包含:

单张次数:定义每张图片在训练过程中被使用的次数,调整参数可影响模型对每个样本的学习深度。

训练轮数:设置模型在整个数据集上训练的完整遍历次数。适当调整此参数以平衡训练效果与效率。

LoRA模型名称:自定义训练后输出模型的名称。

模型触发词(非必填):请输入一个对应训练概念的单词,尽量避免使用常见英文单词,建议使用训练概念的拼音。

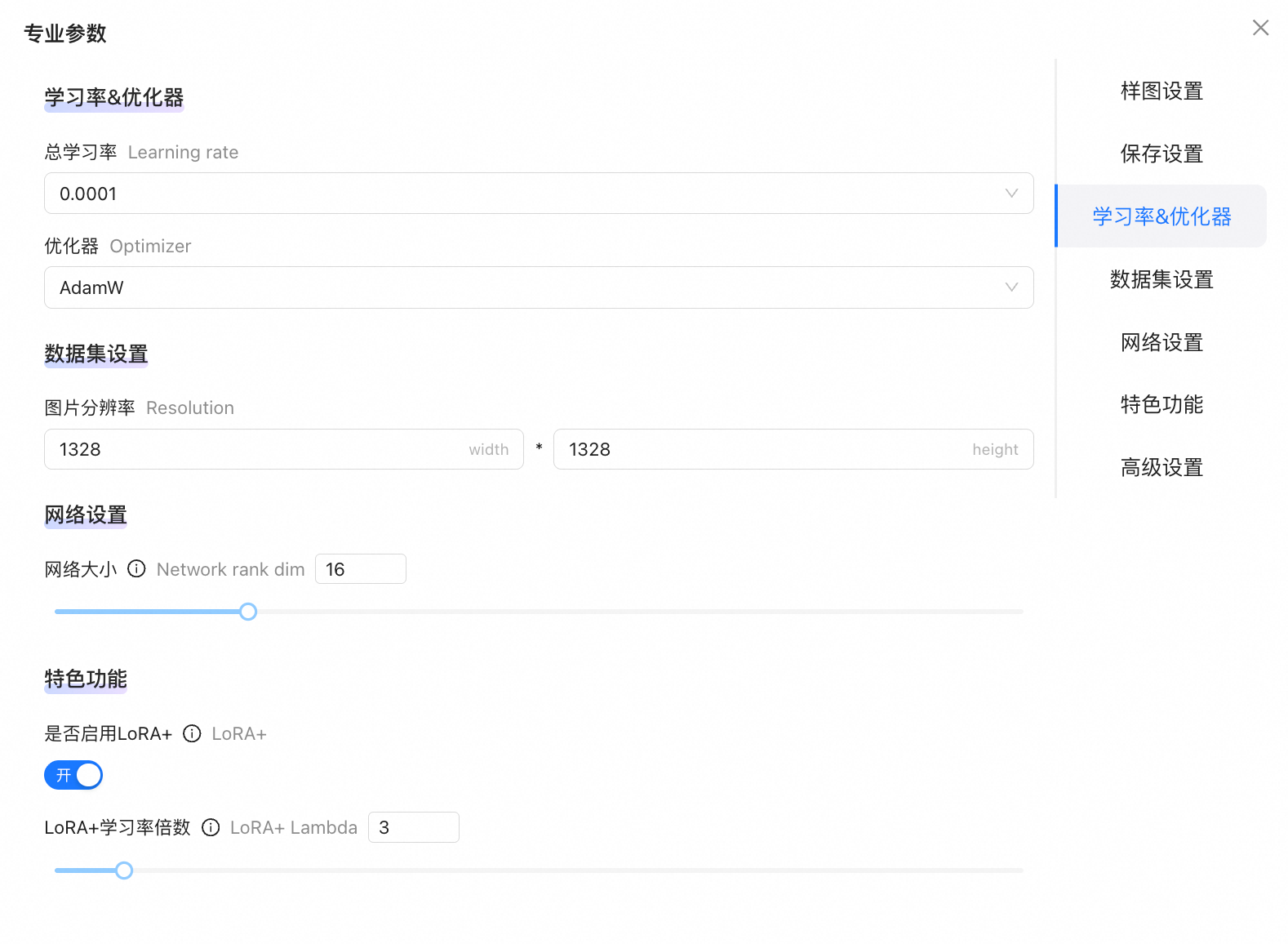

如果您有更进阶的训练需求,也可以点击参数设置右侧的专业参数面板,以自定义设置更多相关训练参数。

步骤四:开始训练

确认基础信息无误后,即可点击“开始训练”按钮,提交本训练任务。

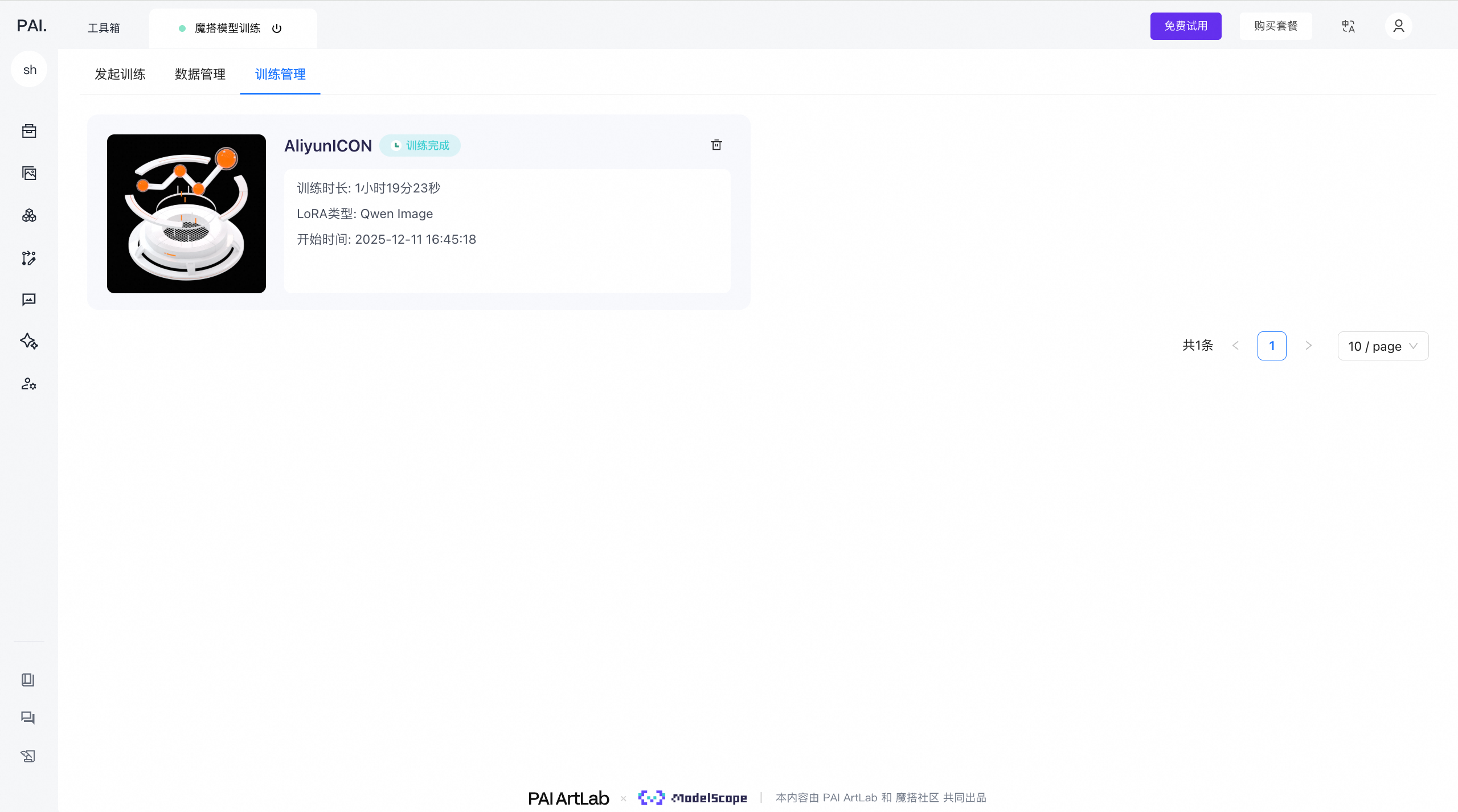

步骤五:查看训练进度

提交训练任务后,在训练管理界面可以看到一个新建的任务卡片。

我们可以点击该卡片查看本次训练任务的详情,以及当前的任务状态。

训练任务有如下几个状态:

排队中

训练中

训练完成

训练失败

超时终止(任务处于"超时终止"状态时,您可以通过点击任务卡片右上方的"重启"按钮来继续训练)

在训练任务详情页中,左下角展示的是LoRA保存点(Checkpoint)信息,每个LoRA保存点根据之前设置的训练参数设置-专业参数中的“每N轮保存一个LoRA”为间隔进行输出,每个LoRA保存点会生成一张实时样图。同时,每个LoRA保存点的模型都可以进行下载。

页面右侧展示的是训练参数详情。

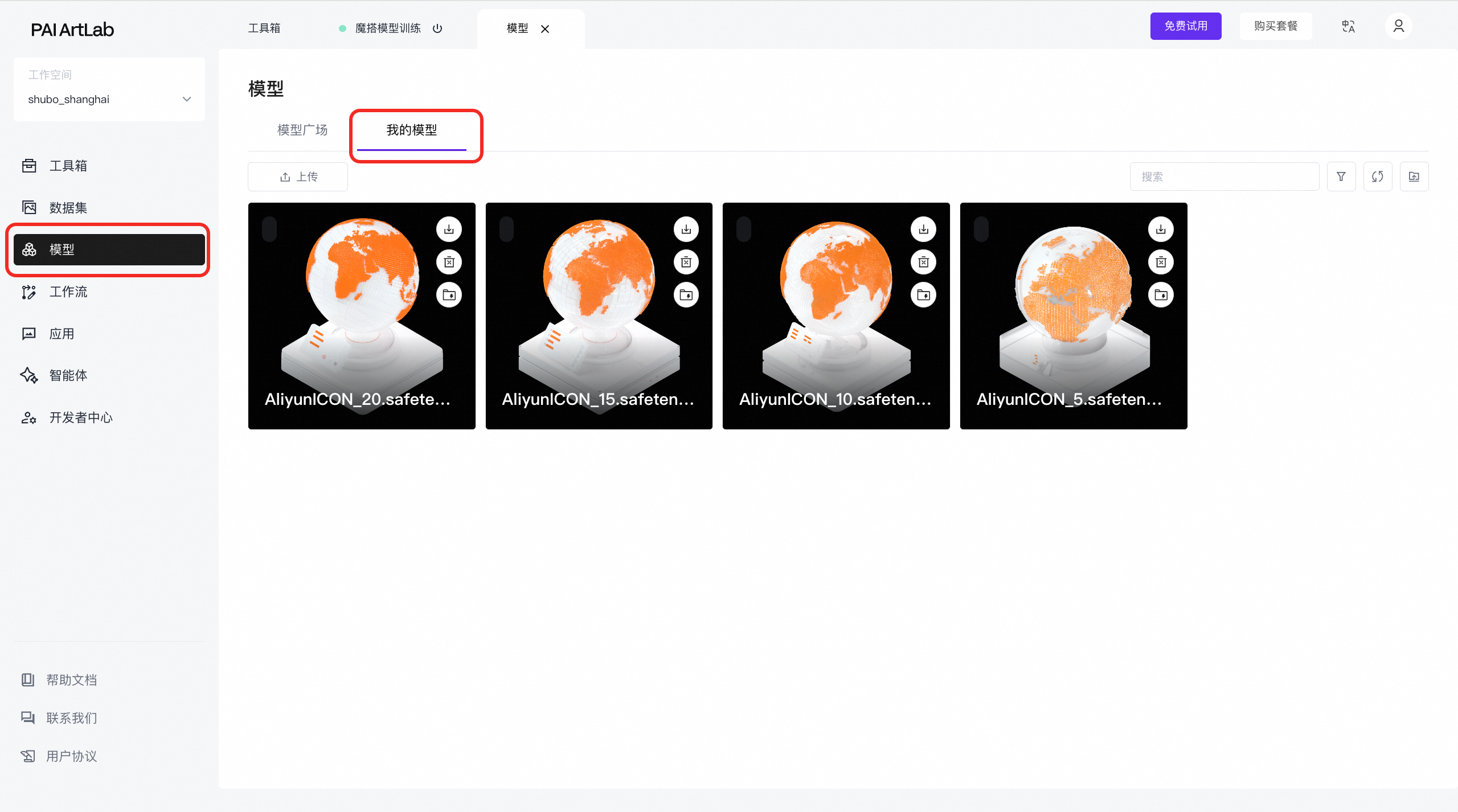

训练后生成的各个LoRA保存点模型会自动导入到ArtLab的模型模块,您可以在我的模型页面找到训练好的LoRA模型。

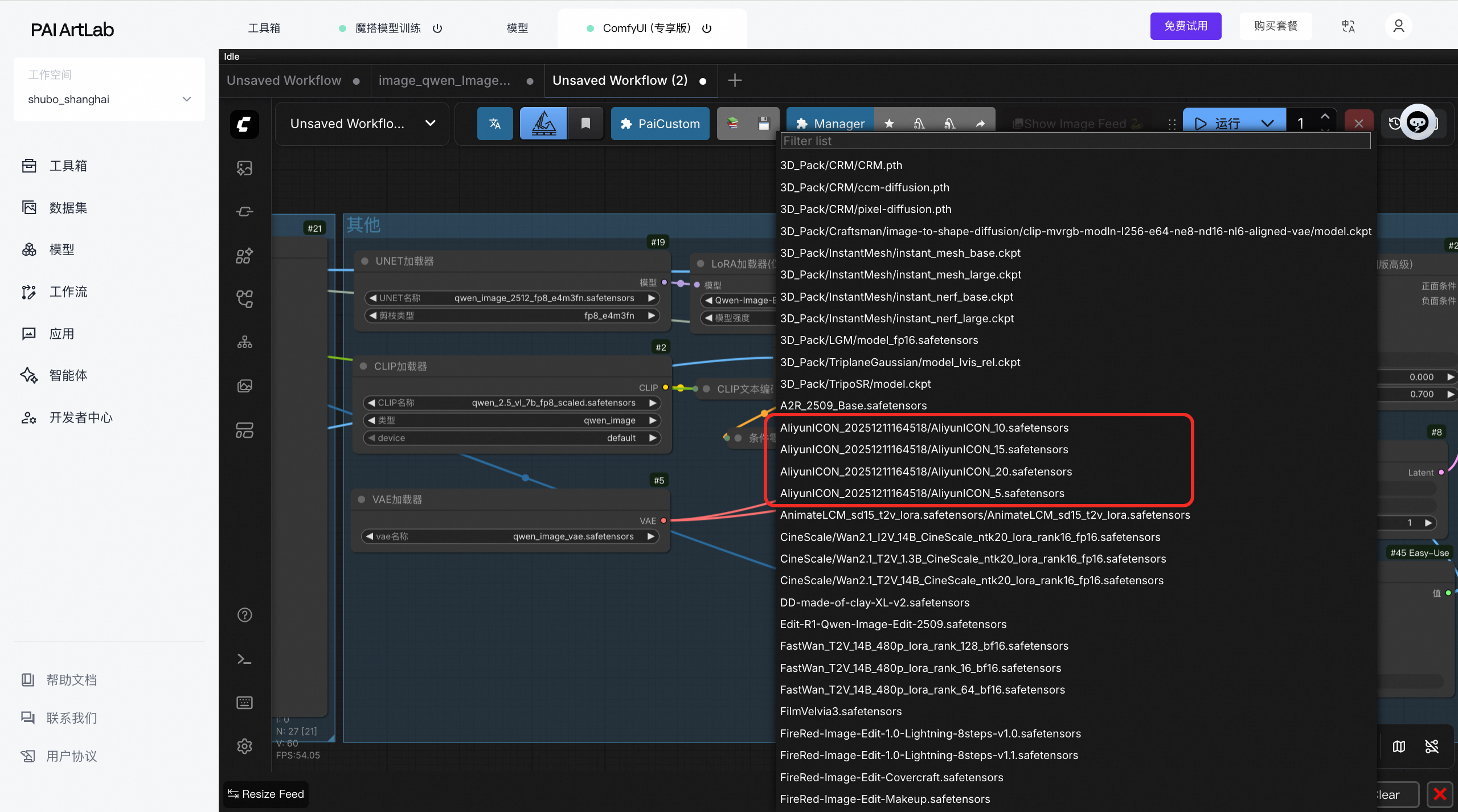

步骤六:使用训练后模型进行生图

ComfyUI专享版工具中的lora节点可以直接加载到使用魔搭模型训练工具训练后的LoRA模型,如此您就可以使用训练好的LoRA模型进行个性化创作了。