本文介绍云消息队列 Kafka 版的典型应用场景,包括网站活动跟踪、日志聚合、数据处理、数据中转枢纽。

网站活动跟踪

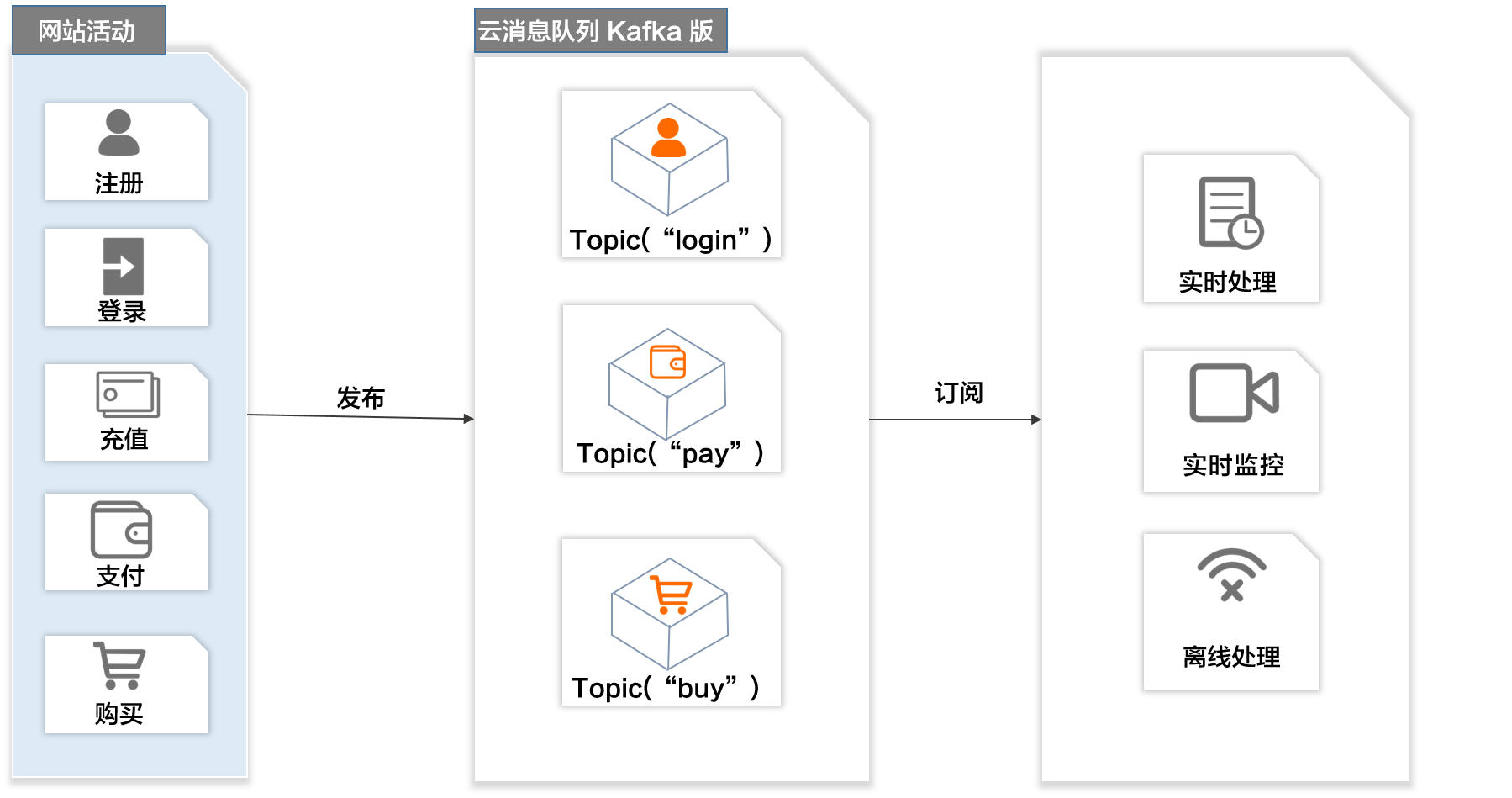

成功的网站运营需要对站点的用户行为进行分析。通过云消息队列 Kafka 版的发布/订阅模型,您可以实时收集网站活动数据(例如注册、登录、充值、支付、购买),根据业务数据类型将消息发布到不同的Topic,然后利用订阅消息的实时投递,将消息流用于实时处理、实时监控或者加载到Hadoop、MaxCompute等离线数据仓库系统进行离线处理。

云消息队列 Kafka 版用于网站活动跟踪具备以下优势:

高吞吐:网站用户产生的行为信息较为庞大,需要较高的吞吐量来支持。

弹性扩容:网站活动导致行为数据激增,云平台可以快速按需扩容。

大数据分析:可对接Storm、Spark等实时数据处理引擎,亦可对接Hadoop等离线数据仓库系统。

日志聚合

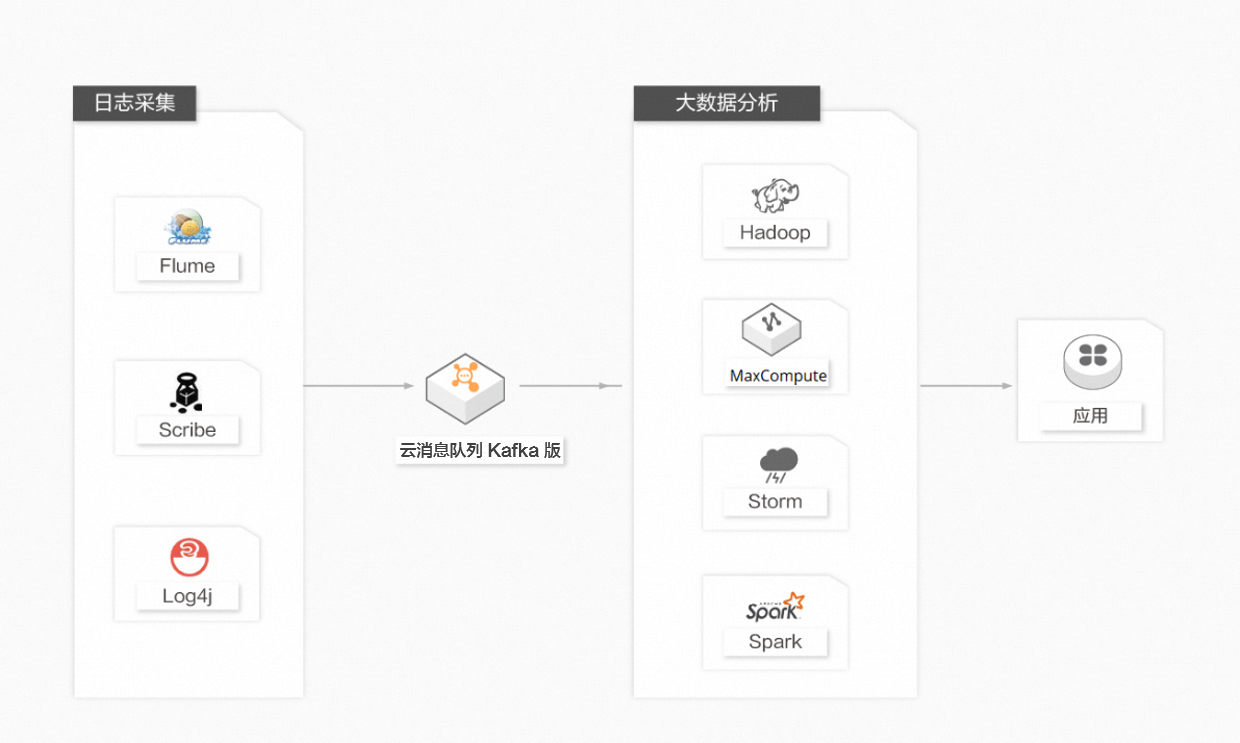

许多公司,例如淘宝、天猫等,每天都会产生大量的日志(一般为流式数据,例如搜索引擎PV、查询等)。相较于以日志为中心的系统,例如Scribe和Flume,云消息队列 Kafka 版在具备高性能的同时,可以实现更强的数据持久化以及更短的端到端响应时间。云消息队列 Kafka 版的这种特性决定它适合作为日志收集中心。云消息队列 Kafka 版忽略掉文件的细节,可以将多台主机或应用的日志数据抽象成一个个日志或事件的消息流,异步发送到云消息队列 Kafka 版集群,从而实现非常低的RT。云消息队列 Kafka 版客户端可批量提交消息和压缩消息,对生产者而言几乎感觉不到性能的开支。消费者可以使用Hadoop、MaxCompute等离线仓库存储和Storm、Spark等实时在线分析系统对日志进行统计分析。

云消息队列 Kafka 版用于数据聚合具备以下优势:

应用与分析解耦:构建应用系统和分析系统的桥梁,并将它们之间的关联解耦。

高可扩展性:具有高可扩展性,即当数据量增加时可通过增加节点快速水平扩展。

在线或离线分析系统:支持实时在线分析系统和类似于Hadoop的离线分析系统。

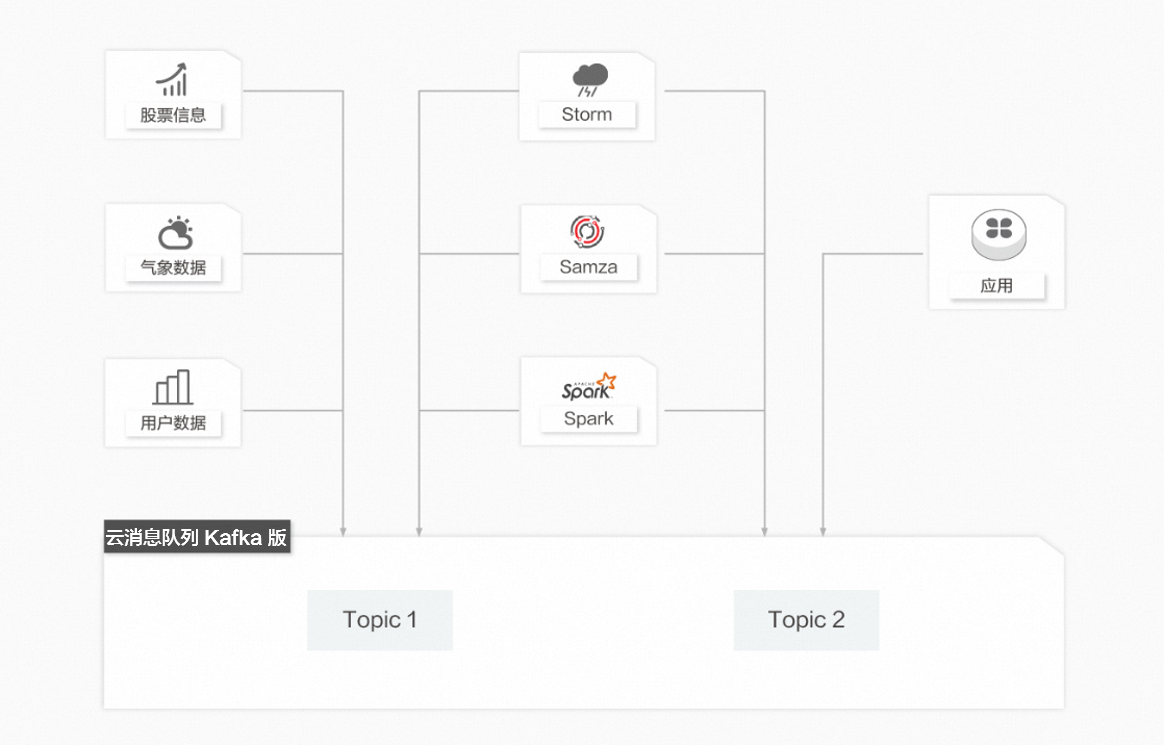

数据处理

在很多领域,如股市走向分析、气象数据测控、网站用户行为分析,由于数据产生快、实时性强且量大,您很难统一采集这些数据并将其入库存储后再做处理,这便导致传统的数据处理架构不能满足需求。与传统架构不同,云消息队列 Kafka 版以及Storm、Samza、Spark等数据处理引擎的出现,就是为了更好地解决这类数据在处理过程中遇到的问题,数据处理模型能实现在数据流动的过程中对数据进行实时地捕捉和处理,并根据业务需求进行计算分析,最终把结果保存或者分发给需要的组件。

云消息队列 Kafka 版用于数据处理具备以下优势:

流动的数据:在数据流动的过程中对数据进行实时地捕捉和处理,并根据业务需求进行计算分析。

高可扩展性:由于数据产生的速度快且数据量大,需要高可扩展性。

数据处理引擎:可对接开源Storm、Samza、Spark以及EMR、Blink、StreamCompute等阿里云产品。

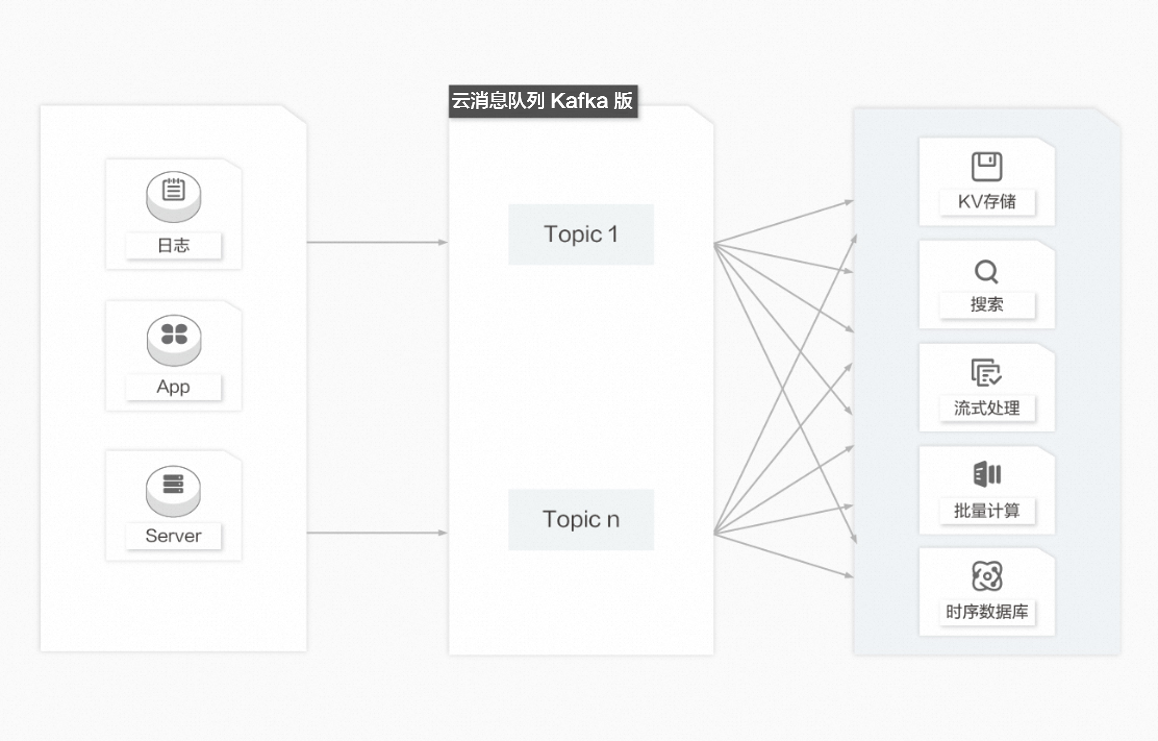

数据中转枢纽

近10多年来,诸如KV存储(HBase)、搜索(Elasticsearch)、流式处理(Storm、Spark、Samza)、时序数据库(OpenTSDB)等专用系统应运而生。这些系统是为单一的目标而产生的,因其简单性使得在商业硬件上构建分布式系统变得更加容易且性价比更高。通常,同一份数据集需要被注入到多个专用系统内。例如,当应用日志用于离线日志分析时,搜索单个日志记录同样不可或缺,而构建各自独立的工作流来采集每种类型的数据再导入到各自的专用系统显然不切实际,利用云消息队列 Kafka 版作为数据中转枢纽,同份数据可以被导入到不同专用系统中。

云消息队列 Kafka 版作为数据中转枢纽具备以下优势:

高容量存储:能在商业硬件上存储高容量的数据,实现可横向扩展的分布式系统。

一对多消费模型:发布/订阅模型,支持同份数据集能同时被消费多次。

同时支持实时和批处理:支持本地数据持久化和Page Cache,在无性能损耗的情况下能同时传送消息到实时和批处理的消费者。