本文介绍在ACS中使用PPU的常见问题。

ACS GPU-HPN POD如何挂载智算版CPFS?

详细内容,请参见使用CPFS静态存储卷。

ACS CPU POD如何挂载智算版CPFS?

按量CPU Pod挂载CPFS与GPU-HPN Pod挂载CPFS的方式不同,详细内容请参见ACS CPU Pod挂载CPFS。

如何获取ACS GPU-HPN POD的stdout和stderr输出?

详细内容,请参见获取GPU-HPN Pod的标准输出和错误输出。

如何直接获取GPU Prometheus指标?

推荐通过ACS大盘获取指标。

如果需要采集数据可以通过cadvisor方式:

curl 'localhost:8080/api/v1/nodes/<your node name>/proxy/metrics/cadvisor' | grep DCGM或者

kubectl get --raw "/api/v1/nodes/<your node name>/proxy/metrics/cadvisor"

详细内容,请参见采集ACS集群的容器监控Prometheus Metrics指标。

如何配置NUMA亲和性?

ACS上默认支持NUMA亲和,GPU、CPU、内存与NUMA都是亲和绑定的,无需单独设置。其中GPU-HPN的虚拟节点下亲和策略是best-effort,在GPU下的亲和策略为restrict。

开通ACS集群使用PPU后都涉及哪些费用,如何节省成本?

ACS集群不收取集群管理费,在ACS中使用PPU资源的费用包含集群所选配置费用和PPU算力资源费用。关于计费的详细说明,请参见计费说明。

集群所选配置费用:包括负载均衡 - API Server使用量计费、NAT网关、与NAT网关绑定的EIP的保有费用和公网访问流量费用、日志服务(SLS)、模型存储用的NAS存储费用。这部分费用为按使用时长或按使用量计费,在删除ACS集群时可以选择删除这些关联资源。

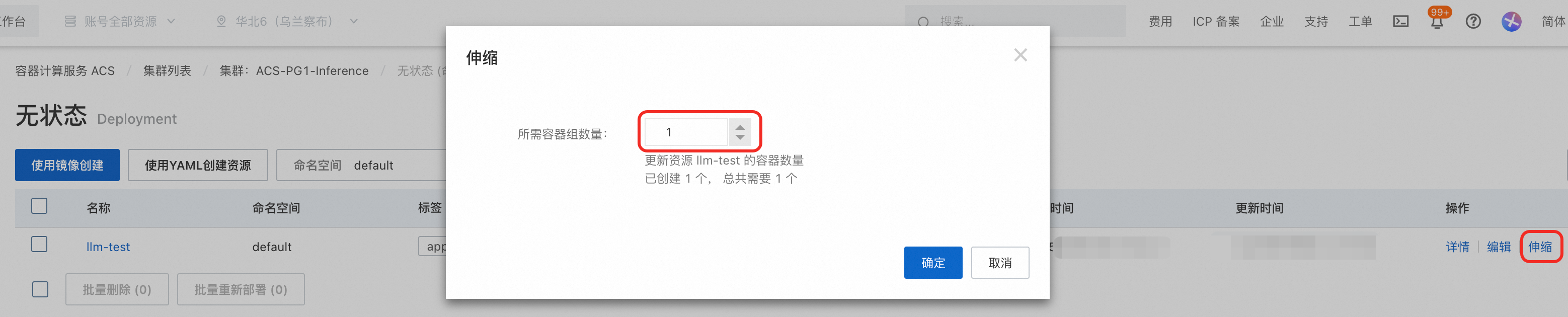

PPU算力资源费用:包括启动模型服务的容器占用的PPU卡、CPU和内存资源费用。计费时长为实际运行时长,从下载容器镜像(Pending状态)开始至实例停止运行(进入Succeeded或Failed状态)。可以将无状态工作负载伸缩成0个副本数来快速删除容器,设置成1或更多副本数来快速启动容器,以最大程度节省成本。

如何设置公网推理服务的访问控制?

本文中的推理服务是通过LoadBalancer类型的Service来实现的,该LoadBalancer会对应一个绑定公网IP地址的SLB实例。

请参考为负载均衡配置访问控制策略组,为对应SLB实例的监听设置访问控制,访问控制方式支持IP白名单、黑名单功能。

如何提升模型下载速度?

默认情况下,ACS集群创建的NAT网关绑定的EIP的带宽是100 Mbps。可参考以下操作,提升带宽峰值,提高模型下载速度。

进入公网NAT网关控制台,选择对应实例后,点击绑定的弹性公网IP页签。

点击实例ID进入弹性公网IP的实例信息页签。

点击右上角更多操作 > 变配,然后将带宽峰值提升至200 Mbps,点击立即购买。该操作不涉及计费变化。

如果模型较大,可为将该EIP加入共享带宽,共享带宽的速率可提升至2000 Mbps。该操作涉及费用变化,请仔细阅读费用说明。

ACS集群中利用存储卷配置模型Checkpoint和Dataset

登录NAS文件系统控制台,购买文件存储系统NAS(购买选择VPC时需要选择和ACS集群同一VPC,否则无法正常连接NAS)。

在容器计算服务控制台页面创建存储声明PVC。

在集群列表页面,单击目标集群名称,然后在左侧导航栏,选择存储 > 存储声明。

选择上文中任务所在的命名空间,点击创建。

选择NAS、使用挂载点域名创建。

确保存储声明名称与上文任务YAML中claimName一致,且挂载点域名选择所购买的NAS域名。

NAS域名获取方式:点击购买的NAS,选择挂载使用,复制挂载点地址。点击创建。

将模型Checkpoint和dataset拷贝至NAS中,NAS中的文件路径应与YAML的subPath相同。

购买同一VPC下的ECS。

将NAS挂载在ECS的目录下(以挂载在/mnt目录为例)。

NAS挂载命令:点击购买的NAS,选择挂载使用,复制挂载命令。

将模型Checkpoint和数据集拷贝到NAS中即ECS的/mnt目录下(Checkpoint:/mnt/shared/public/model_configs/ssd 数据集: /mnt/shared/public/dataset/coco)。下载模型Checkpoint,解压后将model_configs/ssd中的内容拷贝到/mnt/shared/public/model_configs/ssd下,下载数据集文件,解压后datasets/coco/中的内容拷贝到/mnt/shared/public/dataset/coco。

SSD模型示例数据集和模型。

镜像中不包含模型训练所需的Checkpoint文件和数据集,需要用户通过volume方式自行挂载到Pod中。

示例YAML文件中的mountPath分别为:

/opt/ljperf/benchmark/models/mmdetection/model_configs/ssd/是ssd模型Checkpoint文件。/opt/ljperf/benchmark/models/mmdetection/data/coco是ssd模型训练时所需使用的数据集。args中包含了启动模型训练的命令,核心为

ljperf benchmark --model cv/ssd通过该命令可以快速启动镜像中已内置好的benchmark模型,cv类模型目前在24.09镜像中支持 cv/ssd, cv/mask_rcnn, cv/fcn, cv/mask2former等几种

如何提升ACS默认配额

当前ACS默认每个用户可以创建最多3个集群,最多可以购买512卡GPU-HPN实例或512卡GPU实例。

如需提升该额度,请按照如下操作。

登录配额中心控制台,选择容器服务Kubernetes版。

在通用配额列表页面搜索ACS集群总数,单击申请进行调整(申请流程一般会在24小时内完成处理)。

在通用配额列表标题右侧选择容器计算服务,切换集群所属的地域。在列表中选择GPU可使用总卡数上限(HPN)进行申请操作。