通过新建ArgoDB数据源能够实现Dataphin读取ArgoDB的业务数据或向ArgoDB写入数据。本文为您介绍如何创建ArgoDB数据源。

权限说明

仅支持具备新建数据源权限点的自定义全局角色和超级管理员、数据源管理员、板块架构师、项目管理员角色创建数据源。

操作步骤

在Dataphin首页,单击顶部菜单栏管理中心 > 数据源管理。

在数据源页面,单击+新建数据源。

在新建数据源页面的大数据存储区域,选择ArgoDB。

如果您最近使用过ArgoDB,也可以在最近使用区域选择ArgoDB。同时,您也可以在搜索框中,输入ArgoDB的关键词,快速搜索。

在新建ArgoDB数据源页面中,配置数据源的基本信息。

参数

描述

数据源名称

命名规则如下:

只能包含中文、英文字母大小写、数字、下划线(_)或短划线(-)。

长度不能超过64字符。

数据源编码

配置数据源编码后,您可以在Flink_SQL任务中通过

数据源编码.表名称或数据源编码.schema.表名称的格式引用数据源中的表;如果需要根据所处环境自动访问对应环境的数据源,请通过${数据源编码}.table或${数据源编码}.schema.table的变量格式访问。更多信息,请参见Dataphin数据源表开发方式。重要数据源编码配置成功后不支持修改。

数据源编码配置成功后,才能在资产目录和资产清单的对象详情页面进行数据预览。

Flink SQL中,目前仅支持MySQL、Hologres、MaxCompute、Oracle、StarRocks、Hive、SelectDB数据源。

版本

当前,版本仅支持选择5.2。

数据源描述

对数据源的简单描述。不得超过128个字符。

数据源配置

选择需要配置的数据源:

如果数据源区分生产数据源和开发数据源,则选择生产+开发数据源。

如果数据源不区分生产数据源和开发数据源,则选择生产数据源。

标签

您可根据标签给数据源进行分类打标,如何创建标签,请参见管理数据源标签。

配置数据源与Dataphin的连接参数。

若您的数据源配置选择生产+开发数据源,则需配置生产+开发数据源的连接信息。如果您的数据源配置为生产数据源,仅需配置生产数据源的连接信息。

说明通常情况下,生产数据源和开发数据源需配置非同一个数据源,以使开发数据源与生产数据源的环境隔离,降低开发数据源对生产数据源的影响。但Dataphin也支持配置成同一个数据源,即相同参数值。

配置集群配置区域的参数。

参数

描述

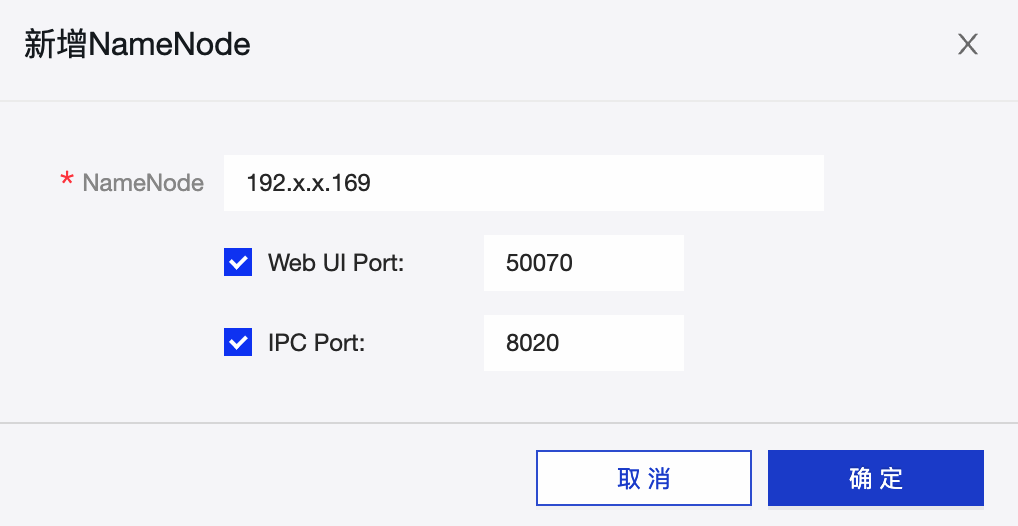

NameNode

NameNode为HDFS集群中NameNode节点的HostName或者IP和端口。

配置样例:

host=192.x.x.169,webUiPort=,ipcPort=8020。其中,webUiPort和IPCport在TDH环境下默认是50070和8020,您可根据实际情况填写对应的端口。

配置文件

用于上传Hadoop的配置文件,例如

hdfs-site.xml、core-site.xml,配置文件可在Hadoop集群导出。认证方式

如果HDFS集群无需认证,则选择无认证;如果HDFS集群需要认证,Dataphin支持Kerberos。

若选择Kerbero认证方式需配置相关认证信息:

Kerberos配置方式:

KDDC Server:KDC统一服务地址,支持多项配置,英文分号(;)分隔。

Krb5文件配置:需上传Krb5文件。

HDFS配置:

HDFS keytab File:HDFS的keytab文件,即Kerberos认证的文件。

HDFS Principal:Kerberos认证Principal名。格式为

XXXX/hadoopclient@xxx.xxx。

配置ArgoDB配置区域的参数。

参数

描述

JDBC URL

配置连接ArgoDB的JDBC URL,格式为

jdbc:hive2//host:port/dbname。认证方式

如果ArgoDB集群无需认证,则选择无认证;如果Inceptor集群需要认证,Dataphin支持选择LDAP或Kerberos,您可以根据实际情况进行选择,详细内容说明如下:

Kerberos:选择后需要上传Keytab File及配置Principal。Keytab File即Kerberos认证的文件;Principal格式为

XXXX/hadoopclient@xxx.xxx。LDAP:选择后需要配置LDAP认证的用户名和密码。

用户名

配置ArgoDB的用户名。

配置元数据库配置区域的参数。

参数

描述

元数据获取方式

支持从元数据库直接获取和HMS获取方式。

使用HMS需上传hive-site.xml配置文件。认证方式支持无认证、LDAP、Kerberos。Kerberos认证方式还需上传Keytab File及配置Principal。

数据库类型

根据集群中使用的元数据库类型,选择数据库类型。支持选择ArgoDB。

JDBC URL

填写ArgoDB元数据库的链接地址。格式为:

jdbc:hive2://hsot:port/dbname。认证方式

支持3种认证方式,无认证、LDAP、Kerberos。

Kerberos认证方式还需上传Keytab File及配置Principal。

用户名、密码

登录元数据库的用户名和密码。

选择默认资源组,该资源组用于运行与当前数据源相关任务,包括数据库SQL、离线整库迁移、数据预览等。

进行测试连接或直接单击确定进行保存,完成ArgoDB数据源的创建。

单击测试连接,系统将测试数据源是否可以和Dataphin进行正常的连通。若直接单击确定,系统将自动对所有已选中的集群进行测试连接,但即使所选中的集群均连接失败,数据源依然可以正常创建。