在函数计算FC中使用PPU

函数计算常驻资源池购买

目前FC PPU只支持实例型售卖,使用之前需购买FC常驻资源池。

模型下载

部署基于PPU算力的推理服务前,用户可以自行将模型下载到OSS/NAS。

FC也提供部分模型的同步服务,具体使用方式如下:

创建对象存储OSS

您需要创建 1 个对象存储 OSS Bucket,用于存放静态资源。

登录OSS管理控制台。

在左侧导航栏,选择Bucket列表。

在Bucket列表页面,单击创建Bucket。

在创建Bucket面板,按照如下信息进行配置,然后单击完成创建。

项目 | 说明 | 示例值 |

模式选择 | 创建的方式 | 自定义创建 |

Bucket名称 | 填写Bucket名称 | deepseek-r1 |

地域属性 | OSS 地域 | 华北6 (乌兰察布) |

存储类型 | 选择存储类型 | 标准存储 |

存储冗余类型 | 选择存储冗余类型 | 本地冗余存储 |

读写权限 | 对静态数据的所有访问操作需要进行身份验证 | 私有 |

同步模型

由于模型文件大,从公网下载时间较慢。因此阿里云提前将模型文件放置于 OSS 中,您可以提交工单快速将模型文件复制到您的 OSS Bucket,OSS 模型同步时间视模型大小而定。

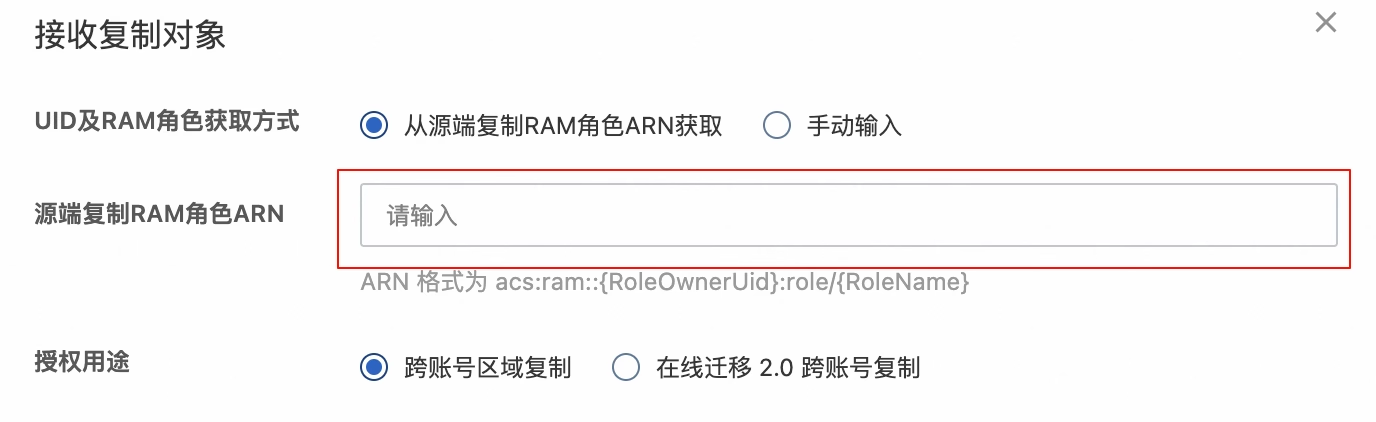

在新创建的 OSS Bucket 中按照下图所示进行授权

在左侧导航中依次选择权限控制 > Bucket 授权策略,单击接收复制对象。

在弹出的看板中源端复制RAM角色ARN填入

acs:ram::143***********49:role/functionaimodelosscopyrole然后单击生成 Policy,最后再单击保存。

创建工单/联系对接人

可以联系对接人沟通同步模型列表,并完成下方内容。

也可以 登录工单系统,创建工单,提交 OSS 模型同步和 申请 GPU 资源工单。

工单示例问题描述如下。

FunctionAI模型部署,需要提供对象存储 OSS 模型数据同步支持与开通GPU资源。

UID:xxxxx

模型:DeepSeek-R1

OSS Bucket:deepseek-r1

地域:华北6(乌兰察布)创建函数计算(FC)函数,部署推理服务

登录FC控制台,左边菜单选择函数

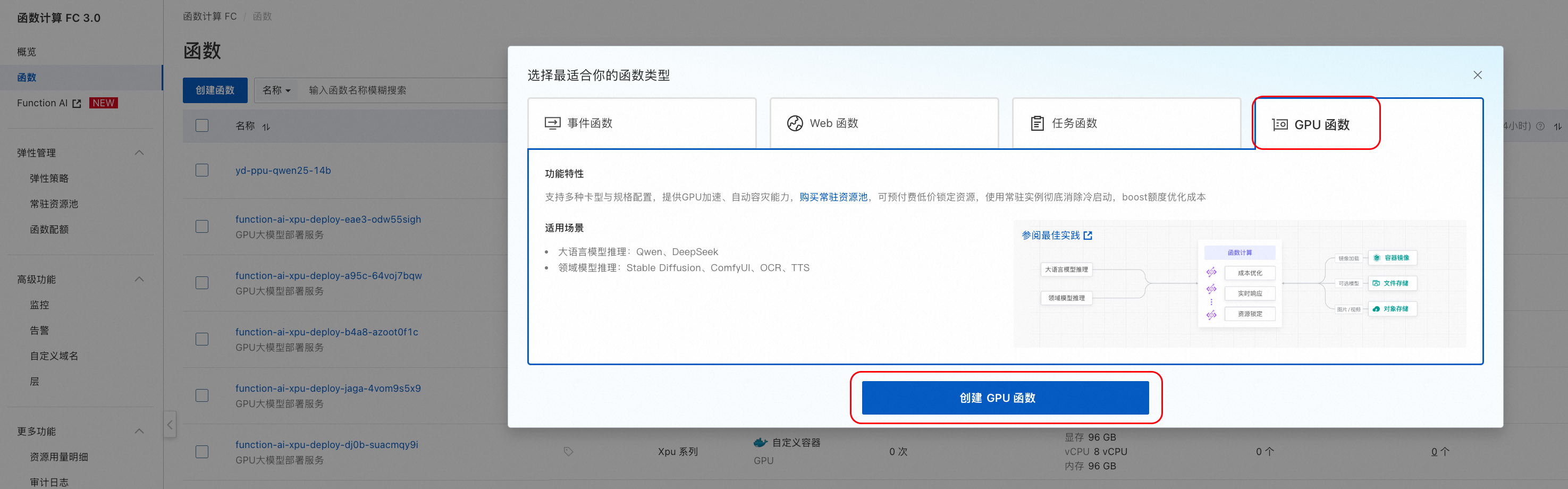

地域选择,比如华北6(乌兰察布), 点击创建函数

创建函数页面,函数类型选择GPU函数,点击创建GPU函数

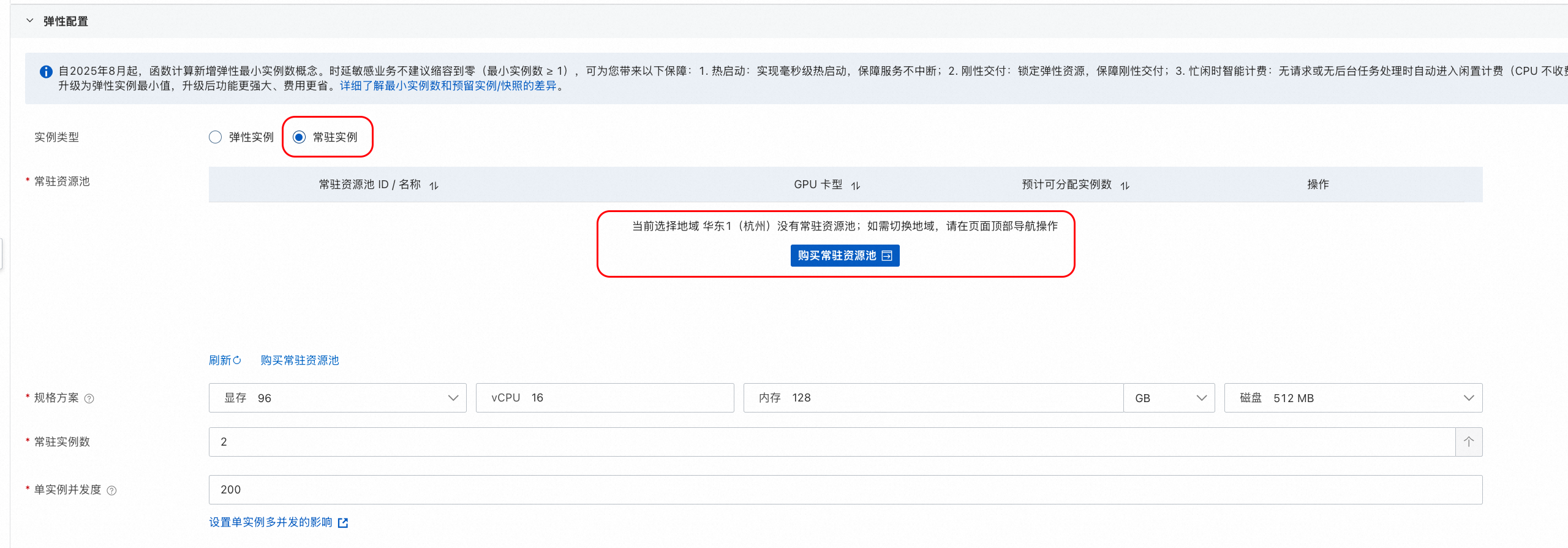

弹性配置部分,目前FC PPU只支持实例型售卖,请选择常驻实例购买FC常驻资源池。

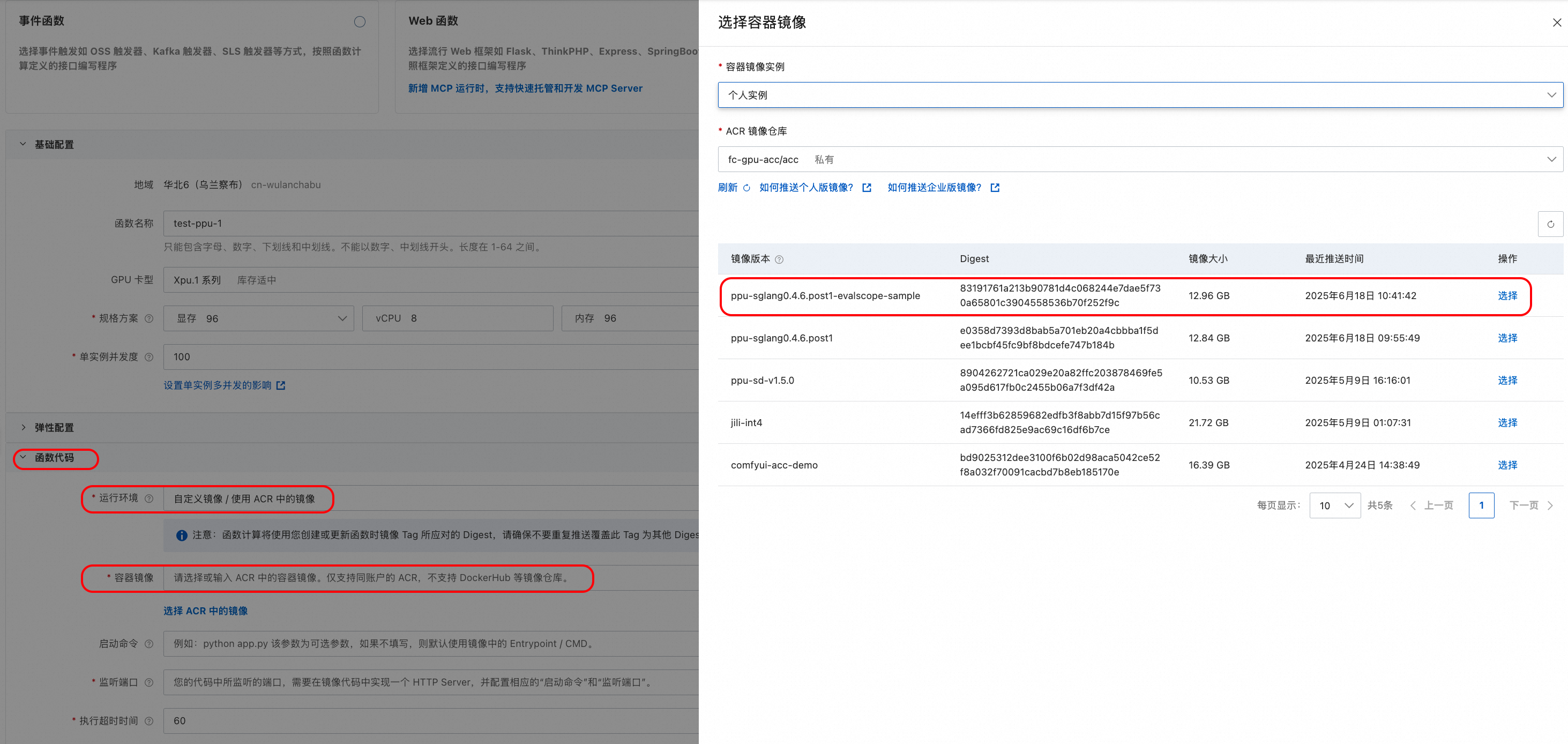

函数代码部分,运行环境选择自定义镜像/使用ACR中的镜像,容器镜像选择推送到ACR/ACREE实例中的PPU专属镜像。

为方便用户快速使用PPU,FC提供了一些PPU镜像,这些镜像处于内测阶段,使用过程请注意保密义务。这些镜像支持在函数计算FC平台内使用。

启动命令

根据使用的框架和部署的模型以及场景确定启动命令,比如:

/bin/sh -c 'vllm serve /mnt1/model/DeepSeek-R1-0528-A8W8 --host 0.0.0.0 --port 9000 --trust-remote-code --gpu-memory-utilization 0.98 --disable-custom-all-reduce --tensor-parallel-size 8 --enable-reasoning --reasoning-parser deepseek_r1 --served-model-name DeepSeek-R1'高级配置部分,如果客户将模型放在OSS,则打开挂载OSS对象存储开关,并配置OSS挂载相关信息。

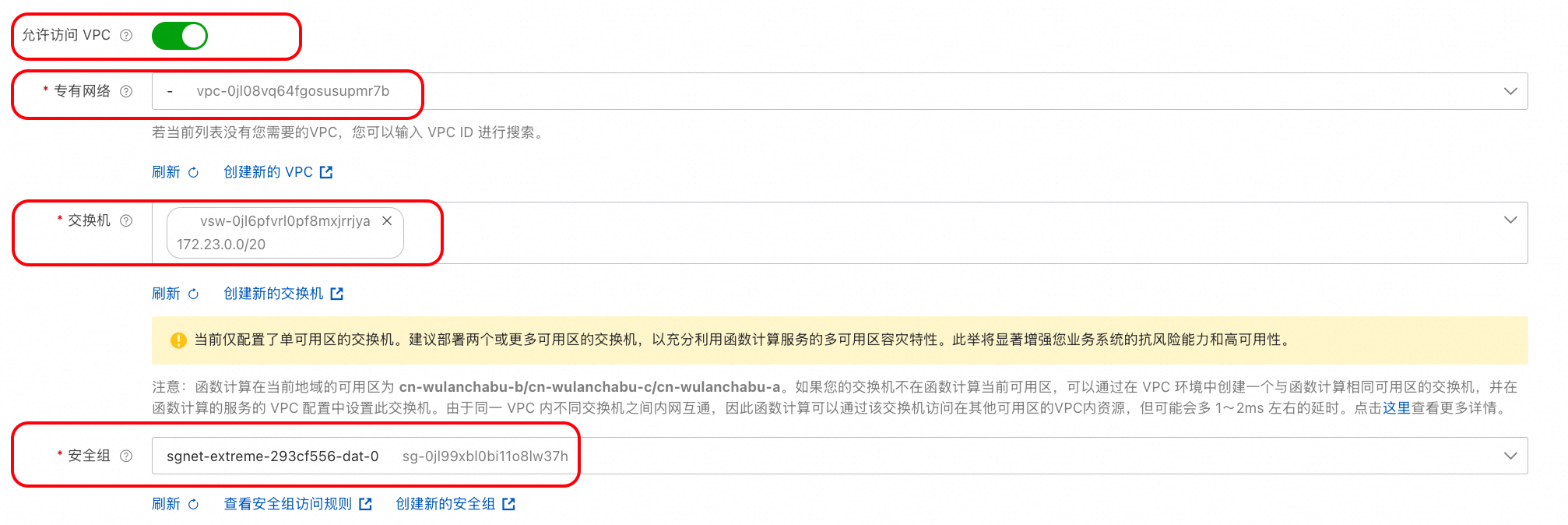

如果客户将模型放在NAS,则打开挂载 NAS 文件系统开关,并配置NAS挂载相关信息。由于函数通过VPC访问NAS,因此在配置NAS挂载信息之前,需要先配置函数的允许访问 VPC信息,允许函数访问NAS所在的VPC。

最后点击创建按钮,就可以完成函数的创建。

函数调用

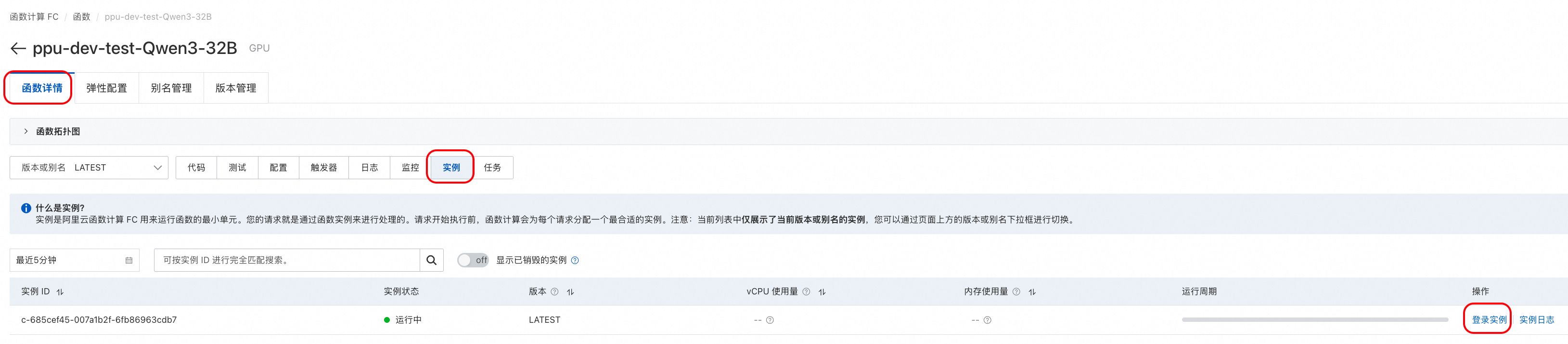

函数创建完成后,可以在函数的弹性配置页面确认实例是否已经创建成功。实例创建成功后,就可以执行函数调用了和登录实例。

以Qwen3-32B为例,调用脚本如下(仅供参考):

import openai

# url为函数的endpoint,可以在函数控制台上获取到

url = "https://***.cn-wulanchabu.fcapp.run"

model = "Qwen/QwQ-32B"

client = openai.Client(base_url=f"{url}/v1",

api_key="None",

# default_headers={

# "X-Fc-Invocation-Type": "Async"

# }

)

response = client.chat.completions.create(

model=model,

messages=[

{"role": "user", "content": "List 3 countries and their capitals."},

],

temperature=0,

max_tokens=1024,

)

print(response)登录实例

实例创建成功后,点击函数的函数详情,点击实例,点击要登录实例对应的登录实例按钮,就可以登录实例。