本文中含有需要您注意的重要提示信息,忽略该信息可能对您的业务造成影响,请务必仔细阅读。

数据传输服务DTS(Data Transmission Service)支持将MongoDB的数据迁移到云原生数据仓库AnalyticDB MySQL版 3.0集群中。本文以云数据库MongoDB版(副本集架构)为源,为您介绍迁移操作的步骤。

前提条件

若源为分片集群架构的云数据库MongoDB版,则还需为所有Shard节点申请连接地址,且各Shard的账号和密码需保持一致。申请方法,请参见申请Shard连接地址。

已创建存储空间大于源云数据库MongoDB版实例已占用存储空间的目标AnalyticDB MySQL版 3.0集群。创建方法,请参见创建集群。

说明建议目标实例的存储空间比源数据库已使用的存储空间大10%。

已在目标AnalyticDB MySQL版 3.0集群中创建用于接收数据的数据库、具有主键的表。创建方法,请参见CREATE DATABASE和CREATE TABLE。

重要请务必确保目标表的数据类型与源MongoDB的数据兼容。例如,若MongoDB中的

_id为ObjectId类型,则对应云原生数据仓库AnalyticDB MySQL版 3.0集群中数据类型需为varchar。AnalyticDB MySQL版 3.0集群中目标表的列名不能为_id和_value。

请在目标AnalyticDB MySQL版 3.0集群中执行

SET ADB_CONFIG ALLOW_MULTI_QUERIES=true;命令,手动开启Multi-Statement功能。说明仅3.1.9.3及以上内核版本的集群支持Multi-Statement功能。查看和升级集群内核版本的方法,请参见升级版本。

注意事项

类型 | 说明 |

源库限制 |

|

其他限制 |

|

费用说明

迁移类型 | 链路配置费用 | 公网流量费用 |

全量数据迁移 | 不收费。 | 本示例不收费。当目标库的接入方式为公网IP时,收取公网流量费用。 |

增量数据迁移 | 收费,详情请参见计费概述。 |

迁移类型说明

迁移类型 | 说明 |

全量迁移 | 将源云数据库MongoDB版迁移对象的存量数据全部迁移到目标AnalyticDB MySQL版 3.0集群中。 |

增量迁移 | 在全量迁移的基础上,将源云数据库MongoDB版的增量更新迁移到目标AnalyticDB MySQL版 3.0集群中。 说明

|

数据库账号的权限要求

数据库 | 全量迁移 | 增量迁移 | 账号创建及授权方法 |

源云数据库MongoDB版 | 待迁移库的read权限。 | 待迁移库、admin库和local库的read权限。 | |

目标AnalyticDB MySQL版 3.0集群 | 目标库的读写权限。 | ||

操作步骤

进入目标地域的迁移任务列表页面(二选一)。

通过DTS控制台进入

登录数据传输服务DTS控制台。

在左侧导航栏,单击数据迁移。

在页面左上角,选择迁移实例所属地域。

通过DMS控制台进入

说明实际操作可能会因DMS的模式和布局不同,而有所差异。更多信息。请参见极简模式控制台和自定义DMS界面布局与样式。

登录DMS数据管理服务。

在顶部菜单栏中,选择。

在迁移任务右侧,选择迁移实例所属地域。

单击创建任务,进入任务配置页面。

配置源库及目标库信息。

类别

配置

说明

无

任务名称

DTS会自动生成一个任务名称,建议配置具有业务意义的名称(无唯一性要求),便于后续识别。

源库信息

选择已有连接信息

若您需要使用已录入系统(新建或保存)的数据库实例,请在下拉列表中选择所需的数据库实例,下方的数据库信息将自动进行配置。

说明DMS控制台的配置项为选择DMS数据库实例。

若您未将数据库实例录入到系统,或无需使用已录入系统的数据库实例,则需要手动配置下方的数据库信息。

数据库类型

选择MongoDB。

接入方式

选择云实例。

实例地区

选择源云数据库MongoDB版所属的地域。

是否跨阿里云账号

本示例使用当前阿里云账号下的数据库实例,需选择不跨账号。

架构类型

本示例选择副本集架构。

说明若您的源云数据库MongoDB版为分片集群架构,您还需要填写Shard账号和Shard密码。

迁移方式

请根据实际情况,选择增量数据迁移的方式。

Oplog(推荐):

若源库已开启Oplog日志,则支持此选项。

说明本地自建MongoDB和云数据库MongoDB版默认已开启Oplog日志,且使用此方式迁移增量数据时增量迁移任务的延迟较小(拉取日志的速度较快),因此推荐选择Oplog。

ChangeStream:若源库已开启变更流(Change Streams),则支持此选项。

说明源库为Amazon DocumentDB(非弹性集群)时,仅支持选择ChangeStream。

源库架构类型选择为分片集群架构,无需填写Shard账号和Shard密码。

实例ID

选择源云数据库MongoDB版的实例ID。

鉴权数据库名称

填入源云数据库MongoDB版实例中数据库账号所属的数据库名称,若未修改过则为默认的admin。

数据库账号

填入源云数据库MongoDB版的数据库账号,权限要求请参见数据库账号的权限要求。

数据库密码

填入该数据库账号对应的密码。

连接方式

DTS支持非加密连接、SSL安全连接和Mongo Atlas SSL三种连接方式。连接方式的选项与接入方式和架构类型有关,请以控制台为准。

说明架构类型为分片集群架构,且迁移方式为Oplog的MongoDB数据库,不支持SSL安全连接。

若源库为自建(接入方式不为云实例)副本集架构的MongoDB数据库,并且选择了SSL安全连接,DTS还支持上传CA证书对连接进行校验。

目标库信息

选择已有连接信息

若您需要使用已录入系统(新建或保存)的数据库实例,请在下拉列表中选择所需的数据库实例,下方的数据库信息将自动进行配置。

说明DMS控制台的配置项为选择DMS数据库实例。

若您未将数据库实例录入到系统,或无需使用已录入系统的数据库实例,则需要手动配置下方的数据库信息。

数据库类型

选择AnalyticDB MySQL 3.0。

接入方式

选择云实例。

实例地区

选择目标AnalyticDB MySQL版 3.0集群所属的地域。

实例ID

选择目标AnalyticDB MySQL版 3.0集群的ID。

数据库账号

填入目标AnalyticDB MySQL版 3.0集群的数据库账号,权限要求请参见数据库账号的权限要求。

数据库密码

填入该数据库账号对应的密码。

配置完成后,在页面下方单击测试连接以进行下一步。

说明请确保DTS服务的IP地址段能够被自动或手动添加至源库和目标库的安全设置中,以允许DTS服务器的访问。更多信息,请参见添加DTS服务器IP地址白名单。

若源库或目标库为自建数据库(接入方式不是云实例),则还需要在弹出的DTS服务器访问授权对话框单击测试连接。

配置任务对象。

在对象配置页面,配置待迁移的对象。

配置

说明

迁移类型

如果只需要进行全量迁移,请选中全量迁移。

如果需要进行不停机迁移,请同时选中全量迁移和增量迁移。

说明若未选中增量迁移,为保障数据一致性,数据迁移期间请勿在源实例中写入新的数据。

实例级别选择所需同步的DDL和DML

按实例级别选择需要增量迁移的操作。

说明如需按集合级别选择需要增量迁移的操作,请在已选择对象中右键单击迁移对象,然后在弹跳框中勾选。

多表归并

选择为是:DTS将在每个表中增加

__dts_data_source列来存储数据来源。具体操作,请参见开启多表归并。选择为否:默认选项。

说明多表归并功能基于任务级别,即不支持基于表级别执行多表归并。如果需要让部分表执行多表归并,另一部分不执行多表归并,您可以创建两个数据迁移任务。

警告源库请勿执行库或表结构变更的DDL操作,否则会导致数据不一致或者迁移任务失败。

目标已存在表的处理模式

预检查并报错拦截:检查目标数据库中是否有同名的集合。如果目标数据库中没有同名的集合,则通过该检查项目;如果目标数据库中有同名的集合,则在预检查阶段提示错误,数据迁移任务不会被启动。

说明如果目标库中同名的集合不方便删除或重命名,您可以更改该集合在目标库中的名称,请参见库表列名映射。

忽略报错并继续执行:跳过目标数据库中是否有同名集合的检查项。

警告选择为忽略报错并继续执行,可能导致数据不一致,给业务带来风险,例如:

在目标库遇到与源库主键的值相同的记录,则会保留目标库中的该条记录,即源库中的该条记录不会迁移至目标库中。

可能会导致无法初始化数据、只能迁移部分的数据或迁移失败。

源库对象

在源库对象框中单击待迁移的对象,然后单击

将其移动到已选择对象框。说明

将其移动到已选择对象框。说明迁移对象选择的粒度为集合。

已选择对象

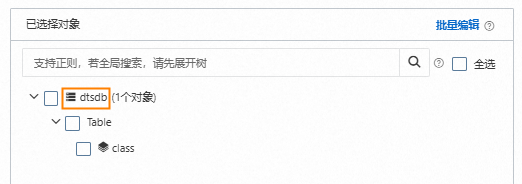

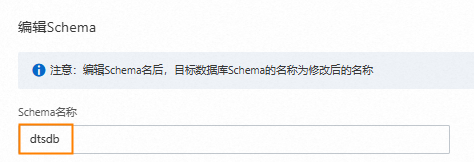

编辑库名映射。

右键单击已选择对象中的待迁移集合所属的数据库。

将Schema名称修改为目标AnalyticDB MySQL版 3.0集群中接收数据的数据库名称。

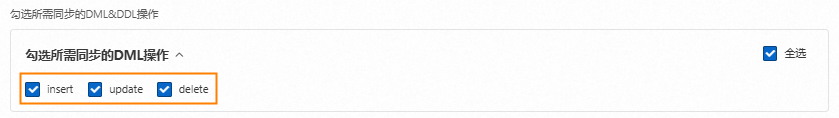

可选:在勾选所需同步的DML&DDL操作区域选择所需增量迁移的操作。

单击确定。

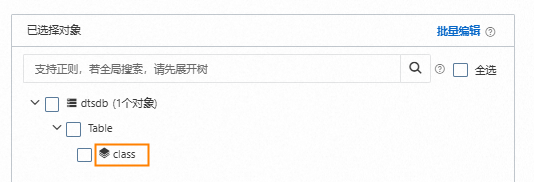

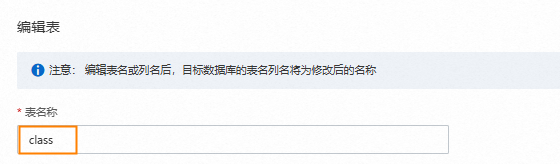

编辑表名映射。

右键单击已选择对象中的待迁移的集合。

将表名称修改为目标AnalyticDB MySQL版 3.0集群中接收数据的表名称。

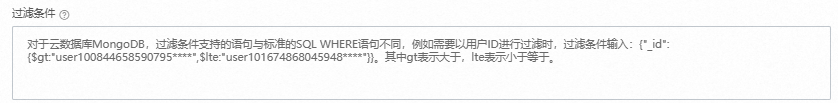

可选:为全量迁移设置过滤条件,设置方法请参见设置过滤条件。

可选:在勾选所需同步的DML&DDL操作区域选择所需增量迁移的操作。

配置MongoDB中需要迁移的字段(Field)。

DTS默认会对待迁移集合的数据进行映射,在赋值列配置表达式。您需要检查表达式是否符合您的要求,并配置列名称、类型、长度和精度等信息。

重要目标表的主键列必须赋值为

bson_value("_id")。在配置

bson_value()表达式时,需要按照层级关系配置到最小子字段,否则可能会导致数据丢失或任务失败。

在赋值列的

bson_value()表达式中,查看该行数据在MongoDB中的字段名称。""中的字段,即为MongoDB中的字段名称。例如,表达式为bson_value("age"),则该行数据对应MongoDB中的age字段。可选:删除无需迁移的字段。

说明对于无需迁移的字段,您可以单击该行数据后的

。

。配置待迁移的字段。

根据

bson_value()表达式是否符合您的要求,进行后续操作。表达式符合要求的字段

填写列名称。

说明此处填写的是目标AnalyticDB MySQL版 3.0集群中接收数据表的列名。

选择列数据的类型。

重要请务必确保目标表的数据类型与源MongoDB的数据兼容。数据类型映射关系,请参见数据类型映射。

可选:配置列数据的长度和精度。

重复上述操作,将相关字段逐一进行映射。

表达式不符合要求的字段

说明例如,含层级关系(父子结构)的字段。

在操作列,单击该行数据后的

。

。单击+ 新增列。

配置列名称、类型、长度和精度。

在赋值下方的文本框中填写

bson_value()表达式,详情请参见赋值配置示例。重复上述操作,将相关字段逐一进行映射。

单击确定。

单击下一步高级配置,进行高级参数配置。

配置

说明

选择调度该任务的专属集群

DTS默认将任务调度到共享集群上,您无需选择。若您希望任务更加稳定,可以购买专属集群来运行DTS迁移任务。

源库、目标库无法连接后的重试时间

在迁移任务启动后,若源库或目标库连接失败则DTS会报错,并会立即进行持续的重试连接,默认重试720分钟,您也可以在取值范围(10~1440分钟)内自定义重试时间,建议设置30分钟以上。如果DTS在设置的时间内重新连接上源、目标库,迁移任务将自动恢复。否则,迁移任务将失败。

说明针对同源或者同目标的多个DTS实例,网络重试时间以后创建任务的设置为准。

由于连接重试期间,DTS将收取任务运行费用,建议您根据业务需要自定义重试时间,或者在源和目标库实例释放后尽快释放DTS实例。

源库、目标库出现其他问题后的重试时间

在迁移任务启动后,若源库或目标库出现非连接性的其他问题(如DDL或DML执行异常),则DTS会报错并会立即进行持续的重试操作,默认持续重试时间为10分钟,您也可以在取值范围(1~1440分钟)内自定义重试时间,建议设置10分钟以上。如果DTS在设置的重试时间内相关操作执行成功,迁移任务将自动恢复。否则,迁移任务将会失败。

重要源库、目标库出现其他问题后的重试时间的值需要小于源库、目标库无法连接后的重试时间的值。

是否限制全量迁移速率

在全量迁移阶段,DTS将占用源库和目标库一定的读写资源,可能会导致数据库的负载上升。您可以根据实际情况,选择是否对全量迁移任务进行限速设置(设置每秒查询源库的速率QPS、每秒全量迁移的行数RPS和每秒全量迁移的数据量(MB)BPS),以缓解目标库的压力。

说明仅当迁移类型选择了全量迁移,才有此配置项。

您也可以在迁移实例运行后,调整全量迁移的速率。

待同步的数据中,同一张表内主键_id的数据类型是否唯一

待迁移的数据中,同一个集合内主键

_id的数据类型是否唯一。重要请根据实际情况选择,否则可能会导致数据丢失。

仅当迁移类型选择了全量迁移,才有此配置项。

是:唯一。在全量迁移阶段,DTS将不会扫描源库待迁移数据中主键的数据类型;在单个集合中,DTS仅会迁移一种数据类型的主键所对应的数据。

否:不唯一。在全量迁移阶段,DTS将扫描源库待迁移数据中主键的数据类型,并迁移其所有数据。

是否限制增量迁移速率

您也可以根据实际情况,选择是否对增量迁移任务进行限速设置(设置每秒增量迁移的行数RPS和每秒增量迁移的数据量(MB)BPS),以缓解目标库的压力。

说明仅当迁移类型选择了增量迁移,才有此配置项。

您也可以在迁移实例运行后,调整增量迁移的速率。

环境标签

您可以根据实际情况,选择用于标识实例的环境标签。本示例无需选择。

配置ETL功能

选择是否配置ETL功能。关于ETL的更多信息,请参见什么是ETL。

是:配置ETL功能,并在文本框中填写数据处理语句,详情请参见在DTS迁移或同步任务中配置ETL。

否:不配置ETL功能。

监控告警

根据业务需求选择是否设置告警并接收告警通知。

不设置:不设置告警。

设置:设置告警。您还需要设置告警阈值和告警联系人,当迁移失败或延迟超过阈值后,系统将进行告警通知。

保存任务并进行预检查。

若您需要查看调用API接口配置该实例时的参数信息,请将鼠标光标移动至下一步保存任务并预检查按钮上,然后单击气泡中的预览OpenAPI参数。

若您无需查看或已完成查看API参数,请单击页面下方的下一步保存任务并预检查。

说明在迁移任务正式启动之前,会先进行预检查。只有预检查通过后,才能成功启动迁移任务。

如果预检查失败,请单击失败检查项后的查看详情,并根据提示修复后重新进行预检查。

如果预检查产生警告:

对于不可以忽略的检查项,请单击失败检查项后的查看详情,并根据提示修复后重新进行预检查。

对于可以忽略无需修复的检查项,您可以依次单击点击确认告警详情、确认屏蔽、确定、重新进行预检查,跳过告警检查项重新进行预检查。如果选择屏蔽告警检查项,可能会导致数据不一致等问题,给业务带来风险。

购买实例。

预检查通过率显示为100%时,单击下一步购买。

在购买页面,选择数据迁移实例的链路规格,详细说明请参见下表。

类别

参数

说明

信息配置

资源组配置

选择实例所属的资源组,默认为default resource group。更多信息,请参见什么是资源管理。

链路规格

DTS为您提供了不同性能的迁移规格,迁移链路规格的不同会影响迁移速率,您可以根据业务场景进行选择。更多信息,请参见数据迁移链路规格说明。

配置完成后,阅读并选中《数据传输(按量付费)服务条款》。

单击购买并启动,并在弹出的确认对话框,单击确定。

您可以在迁移任务列表页面,查看迁移实例的具体进度。

说明若迁移实例不包含增量迁移任务,则迁移实例会自动结束。迁移实例自动结束后,运行状态为已完成。

若迁移实例包含增量迁移任务,则迁移实例不会自动结束,增量迁移任务会持续进行。在增量迁移任务正常运行期间,迁移实例的运行状态为运行中。

数据类型映射

MongoDB的数据类型 | AnalyticDB MySQL版 3.0集群的数据类型 |

ObjectId | VARCHAR |

String | VARCHAR |

Document | VARCHAR |

DbPointer | VARCHAR |

Array | VARCHAR |

Date | DATETIME |

TimeStamp | DATETIME |

Double | DOUBLE |

32-bit integer (BsonInt32) | INTEGER |

64-bit integer (BsonInt64) | BIGINT |

Decimal128 | DECIMAL |

Boolean | BOOLEAN |

Null | VARCHAR |

赋值配置示例

源MongoDB的数据结构

{

"_id":"62cd344c85c1ea6a2a9f****",

"person":{

"name":"neo",

"age":26,

"sex":"male"

}

}目标AnalyticDB MySQL版 3.0集群的表结构

列名称 | 类型 |

mongo_id | varchar 说明 主键列。 |

person_name | varchar |

person_age | decimal |

新增列的配置

请按照层级关系正确配置bson_value()表达式,否则可能会导致数据丢失或任务失败。例如,若您配置的表达式为bson_value("person"),DTS将无法把源端person的子字段(name、age、sex)的增量变更数据写入到目标端。

列名称 | 类型 | 赋值 |

mongo_id | STRING | bson_value("_id") |

person_name | STRING | bson_value("person","name") |

person_age | DECIMAL | bson_value("person","age") |