本文介绍使用阿里云第八代Intel实例,基于xFasterTransformer单机部署通义千问Qwen-1.8B-Chat语言模型,并使用Qwen-1.8B-Chat推荐系统进行Query改写演示。

背景信息

通义千问-1.8B(Qwen-1.8B-Chat)

通义千问-1.8B是阿里云研发的通义千问大模型系列的18亿参数规模的模型。Qwen-1.8B是基于Transformer的大语言模型,在超大规模的预训练数据上进行训练得到。预训练数据类型多样,覆盖广泛,包括大量网络文本、专业书籍、代码等。同时,在Qwen-1.8B的基础上,阿里云使用对齐机制打造了基于大语言模型的AI助手Qwen-1.8B-Chat。

阿里云第八代Intel CPU实例

阿里云八代实例(g8i/c8i/r8i/hfc8i/hfg8i/hfr8i)采用Intel® Xeon® Emerald Rapids或者Intel® Xeon® Sapphire Rapids,该实例支持使用新的AMX(Advanced Matrix Extensions)指令来加速AI任务。相比于上一代实例,八代实例在Intel® AMX的加持下,推理和训练性能大幅提升。

xFasterTransformer

xFasterTransformer是由Intel官方开源的推理框架,为大语言模型(LLM)在CPU X86平台上的部署提供了一种深度优化的解决方案,支持多CPU节点之间的分布式部署方案,使得超大模型在CPU上的部署成为可能。此外,xFasterTransformer提供了C++和Python两种API接口,涵盖了从上层到底层的接口调用,易于用户使用并将xFasterTransformer集成到自有业务框架中。xFasterTransformer目前支持的模型如下:

Models | Framework | Distribution | |

Pytorch | C++ | ||

ChatGLM | √ | √ | √ |

ChatGLM2 | √ | √ | √ |

ChatGLM3 | √ | √ | √ |

Llama | √ | √ | √ |

Llama2 | √ | √ | √ |

Baichuan | √ | √ | √ |

QWen | √ | √ | √ |

SecLLM(YaRN-Llama) | √ | √ | √ |

Opt | √ | √ | √ |

xFasterTransformer支持多种低精度数据类型来加速模型部署。除单一精度以外,还支持混合精度,以更充分地利用CPU的计算资源和带宽资源,从而提高大语言模型的推理速度。以下是xFasterTransformer支持的单一精度和混合精度类型:

FP16

BF16

INT8

W8A8

INT4

NF4

BF16_FP16

BF16_INT8

BF16_W8A8

BF16_INT4

BF16_NF4

W8A8_INT8

W8A8_int4

W8A8_NF4

步骤一:创建ECS实例

前往实例创建页。

按照界面提示完成参数配置,创建一台ECS实例。

需要注意的参数如下,其他参数的配置,请参见自定义购买实例。

实例:Qwen-1.8B-Chat运行大概需要16 GiB内存以上,为了保证模型运行的稳定,实例规格至少需要选择ecs.c8i.4xlarge(32 GiB内存)。

镜像:Alibaba Cloud Linux 3.2104 LTS 64位。

公网IP:选中分配公网IPv4地址,带宽计费模式选择按使用流量,带宽峰值设置为100 Mbps。以加快模型下载速度。

系统盘:Qwen-1.8B-Chat模型数据下载、转换和运行过程中需要占用14 GiB的存储空间,为了保证模型顺利运行,建议系统盘设置为40 GiB。

添加安全组规则。

在ECS实例安全组的入方向添加安全组规则并放行22端口和7860端口(22端口用于访问SSH服务,7860端口用于访问WebUI页面)。具体操作,请参见添加安全组规则。

步骤二:安装模型所需容器环境

远程连接该ECS实例。

具体操作,请参见使用Workbench工具以SSH协议登录Linux实例。

安装并启动Docker。

具体操作,请参见安装Docker。

获取并运行Intel xFasterTransformer容器。

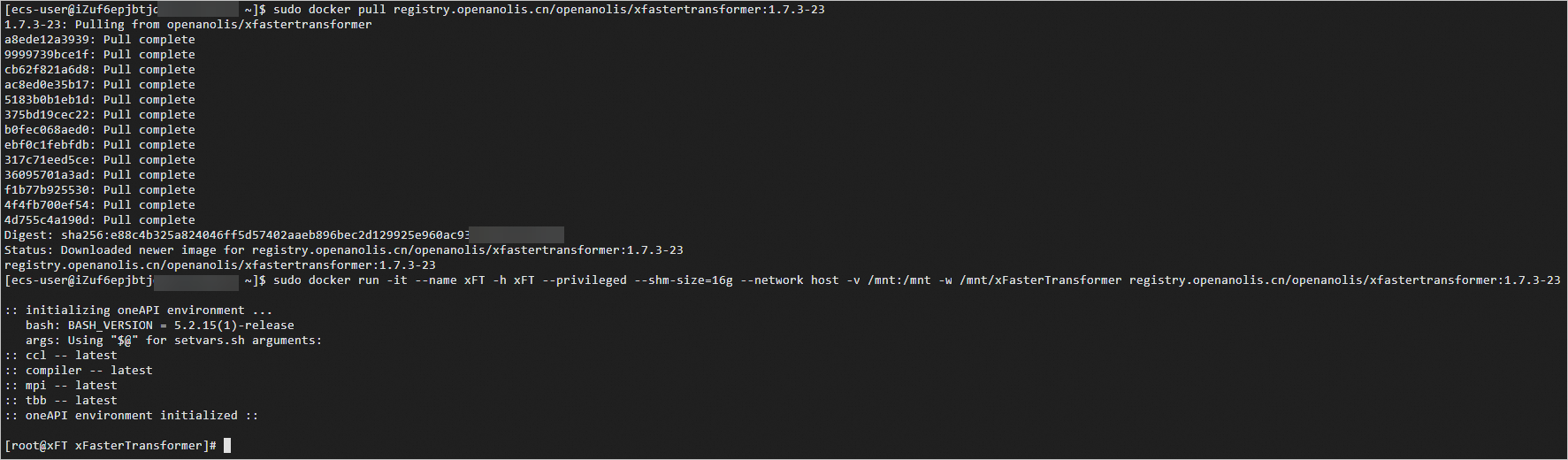

sudo docker pull registry.openanolis.cn/openanolis/xfastertransformer:1.7.3-23 sudo docker run -it --name xFT -h xFT --privileged --shm-size=16g --network host -v /mnt:/mnt -w /mnt/xFasterTransformer registry.openanolis.cn/openanolis/xfastertransformer:1.7.3-23当出现类似如下信息时,表示已获取并成功运行xFasterTransformer容器。

重要

重要后续操作都需要在容器中运行,如果退出了容器,可以通过以下命令启动并再次进入容器的Shell环境。

sudo docker start xFT sudo docker exec -it xFT bash(可选)更新xFasterTransformer脚本代码。

xFasterTransformer镜像中已包含对应版本的脚本代码,可以更新升级到最新的测试脚本。

yum update -y yum install -y git cd /root/xFasterTransformer git pull

步骤三:准备模型数据

在容器中安装依赖软件。

yum update yum install -y wget git git-lfs vim tmux启用Git LFS。

下载预训练模型需要Git LFS的支持。

git lfs install创建并进入模型数据目录。

mkdir /mnt/data cd /mnt/data创建一个tmux session。

tmux重要下载预训练模型耗时较长,且成功率受网络情况影响较大,建议在tmux session中下载,以避免ECS断开连接导致下载模型中断。

下载Qwen-1.8B-Chat预训练模型。

pip install einops transformers_stream_generator tiktoken git clone https://www.modelscope.cn/qwen/Qwen-1_8B-Chat.git转换模型数据。

由于下载的模型数据是HuggingFace格式,需要转换成xFasterTransformer格式。生成的模型文件夹为

/mnt/data/Qwen-1_8B-Chat-xft。python -c 'import xfastertransformer as xft; xft.QwenConvert().convert("/mnt/data/Qwen-1_8B-Chat")' 说明

说明不同的模型数据使用的Convert类不同,xFasterTransformer支持以下模型转换类:

LlamaConvert

ChatGLMConvert

ChatGLM2Convert

ChatGLM3Convert

OPTConvert

BaichuanConvert

QwenConvert

步骤四:在实例终端进行Query改写演示

执行以下命令,启动AI对话程序。

cd /root/xFasterTransformer/examples/pytorch OMP_NUM_THREADS=$(($(lscpu | grep "^CPU(s):" | awk '{print $NF}') / 2)) numactl -C $(seq -s, 0 2 $(($(lscpu | grep "^CPU(s):" | awk '{print $NF}') - 2))) -m 0 python demo.py -t /mnt/data/Qwen-1_8B-Chat -m /mnt/data/Qwen-1_8B-Chat-xft -d bf16 --chat true输入prompt,查看改写效果。

本示例输入:

lowercase format, remove redundancy: The Most Popular Most Popular Sneakers。

最终可以将输入的Query:

The Most Popular Most Popular Sneakers改写成标准的Query:The most popular sneakers.。