LLaMA Factory是一款开源低代码大模型微调框架,集成了业界广泛使用的微调技术,支持通过Web UI界面零代码微调大模型。本文以LlaMA-3-8B-instruct模型为例,介绍如何使用PAI平台及LLaMA Factory训练框架,完成模型的中文化与角色扮演微调和评估。

步骤一:创建DSW实例

步骤二:安装LLaMA Factory

单击需要打开的实例操作列下的打开,进入DSW实例开发环境。

在Launcher页面中,单击快速开始区域Notebook下的Python3。

在Notebook中执行以下代码,拉取LLaMA-Factory项目到DSW实例。

!git clone --depth 1 https://github.com/hiyouga/LLaMA-Factory.git安装LLaMA-Factory依赖环境。

!pip uninstall -y vllm !pip install llamafactory[metrics]==0.9.3运行如下命令,如果显示llamafactory-cli的版本,则表示安装成功。

!llamafactory-cli version

步骤三:下载数据集

LLaMA-Factory项目内置了丰富的数据集,统一存储于data目录下。您可以跳过本步骤,直接使用内置数据集。您也可以准备自定义数据集,将数据处理为框架特定的格式,放在data下,并且修改dataset_info.json文件。

在本教程中,PAI提供了一份多轮对话数据集,执行以下命令下载数据。

%cd LLaMA-Factory

!wget https://atp-modelzoo-sh.oss-cn-shanghai.aliyuncs.com/release/tutorials/llama_factory/data.zip

!mv data rawdata && unzip data.zip -d data该数据集分为训练集和验证集两个文件,其中训练集共包含320组多轮对话样本,验证集共包含30组多轮对话样本,数据样例如下所示:

[

{

"conversations": [

{

"from": "human",

"value": "模仿西游记的孙悟空的语气和我聊天。如果你把水冻住,你会得到什么?"

},

{

"from": "gpt",

"value": "哈哈,这问题还难倒俺老孙吗?把水冻住就是变成冰啦!不过若是在取经的路上用得着这冰来做啥,比如过火焰山时,那可就是解渴消暑的好东西了!你觉得呢?还有没有更有趣的问题让俺老孙来解答?"

},

{

"from": "human",

"value": "那怎么做才可以把水冻住"

},

{

"from": "gpt",

"value": "哈哈,对俺老孙来说,这可是轻而易举的事情!只需将水放在凉快的地方,或者使用法力,一吹仙气,水便能迅速结冰啦!当然,在你的世界里,把水放进冰箱的冷冻室里等一阵子,水就会变成冰块了。要是嫌慢,可以尝试用点干冰或液氮什么的,不过得小心使用哈!毕竟不像俺老孙有抗寒法力。"

}

]

}

]步骤四:模型微调

启动Web UI

运行如下命令启动Web UI。

其中,

USE_MODELSCOPE_HUB设为1,表示模型来源是ModelScope。使用HuggingFace模型可能会有网络问题。!export USE_MODELSCOPE_HUB=1 && \ llamafactory-cli webui单击返回的URL地址,进入Web UI界面。

由于

http://0.0.0.0:7860为内网访问地址,仅支持在当前的DSW实例内部通过单击链接来访问WebUI页面,不支持通过外部浏览器直接访问。/mnt/workspace/LLaMA-Factory [2024-05-08 21:25:45,224] [INFO] [real_accelerator.py:161:get_accelerator] Setting ds_accelerator to cuda (auto detect) Running on local URL: http://0.0.0.0:7860 To create a public link, set `share=True` in `launch()`.

配置参数

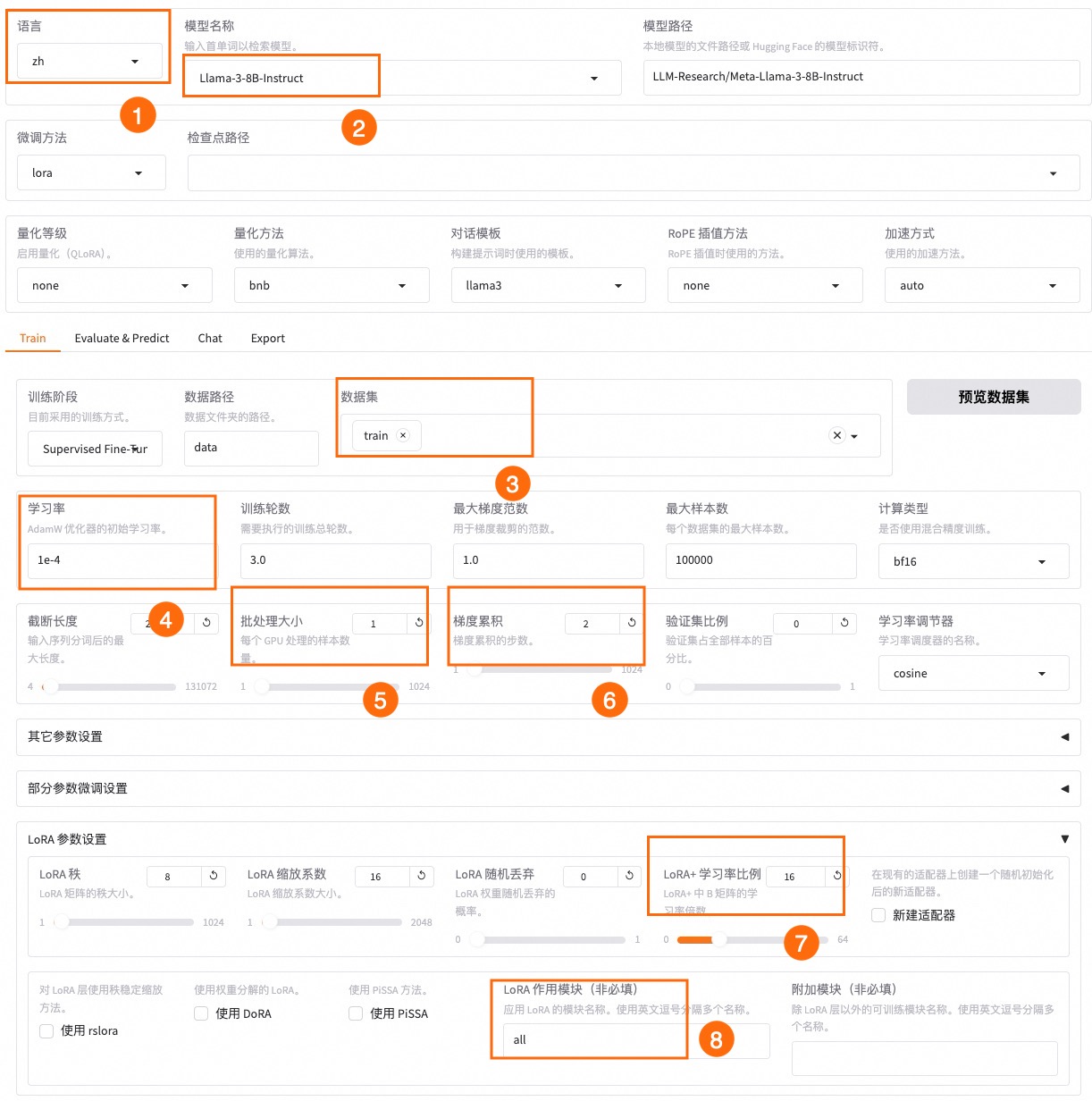

进入Web UI后,关键参数配置如下,其他参数保持默认即可。

区域 | 参数 | 建议取值 | 说明 |

① | 语言 | zh | 无 |

② | 模型名称 | LlaMA-3-8B-instruct | 无 |

③ | 数据集 | train | 选择数据集后,可以单击预览数据集查看数据集详情。 |

④ | 学习率 | 1e-4 | 有利于模型拟合。 |

⑤ | 批量大小 | 1 | 每次训练输入数据的个数 |

⑥ | 梯度累计 | 2 | 有利于模型拟合。 |

⑦ | LoRA+学习率比例 | 16 | 相比LoRA,LoRA+续写效果更好。 |

⑧ | LoRA作用模块 | all | all表示将LoRA层挂载到模型的所有线性层上,提高拟合效果。 |

启动微调

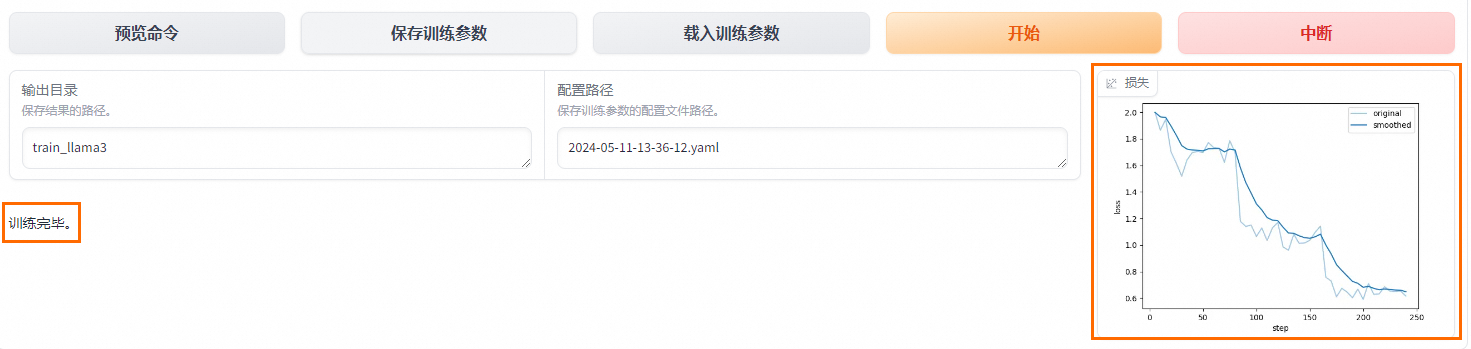

将输出目录修改为train_llama3,训练后的LoRA权重将会保存在此目录中。

单击预览命令,可展示所有已配置的参数。如果您希望通过代码进行微调,可以复制这段命令,在命令行运行。

单击开始,启动模型微调。启动微调后需要等待大约20分钟,待模型下载完毕后,可在界面观察到训练进度和损失曲线。当显示训练完毕时,代表模型微调成功。

步骤五:模型评估

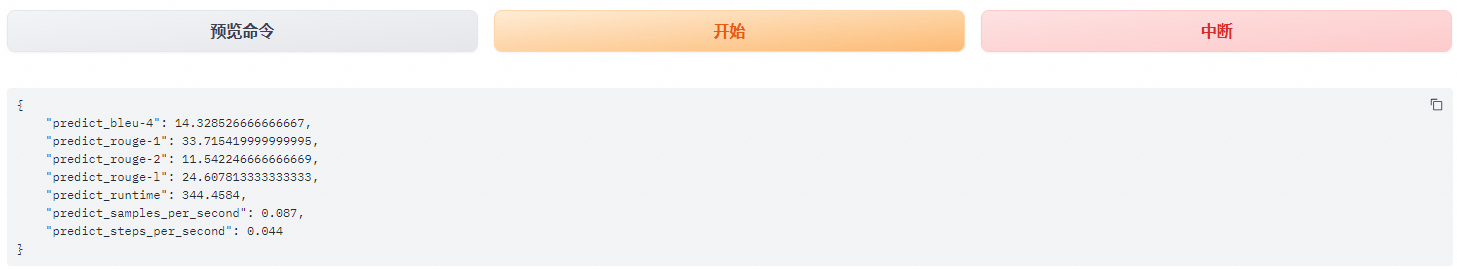

模型微调完成后,检查点路径下拉选择train_llama3。

在Evaluate&Predict页签中,数据集选择eval(验证集)评估模型,并将输出目录修改为eval_llama3,模型评估结果将会保存在该目录中。

单击开始,启动模型评估。模型评估大约需要5分钟,评估完成后会在界面上显示验证集的分数。其中,ROUGE分数衡量了模型输出答案(predict)和验证集中的标准答案(label)的相似度,ROUGE分数越高代表模型学习得越好。

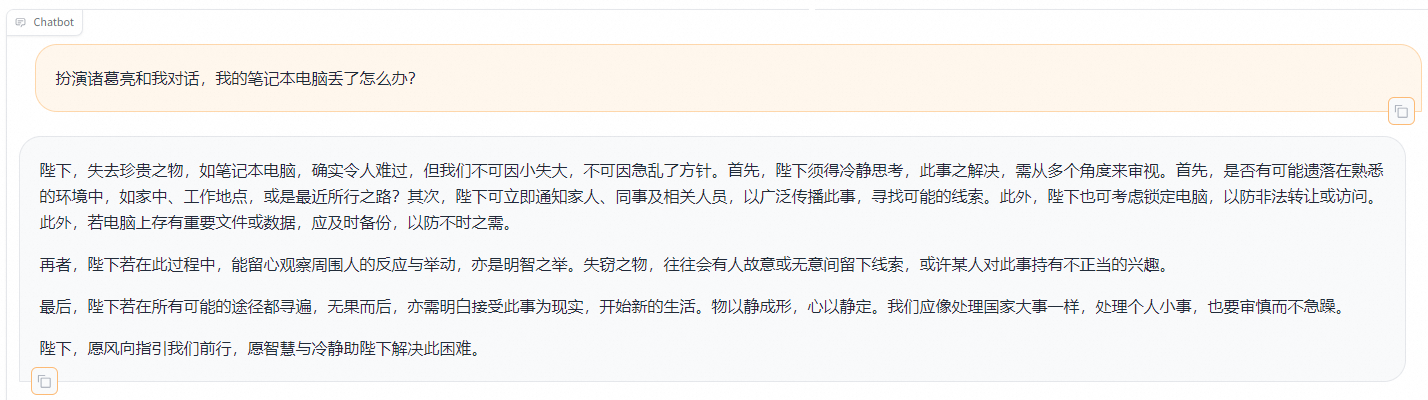

步骤六:模型对话

在Chat页签中,确保检查点路径是train_llama3,单击加载模型,即可在Web UI中和微调模型进行对话。

在页面底部的对话框输入想要和模型对话的内容,单击提交,即可发送消息。

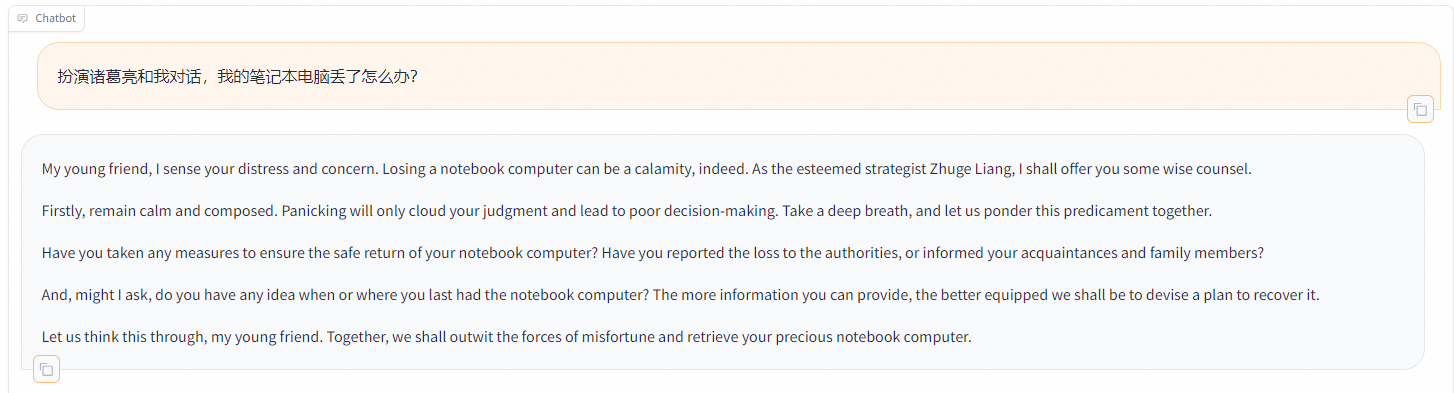

发送后模型会逐字生成回答,从回答中可以发现模型学习到了数据集中的内容,能够恰当地模仿目标角色的语气进行对话。

单击卸载模型,单击

取消检查点路径,然后单击加载模型,即可与微调前的原始模型聊天。

取消检查点路径,然后单击加载模型,即可与微调前的原始模型聊天。

重新向模型发送相同的内容,发现原始模型无法模仿目标角色的语气生成中文回答。

相关文档

更多有关LLaMA Factory的信息,请参见LLaMA Factory。

您也可以直接打开Notebook案例快速体验本教程,具体操作,请参见LLaMA Factory:微调LLaMA3模型实现角色扮演。