inference-xpu-pytorch 26.01

本文介绍inference-xpu-pytorch 26.01版本发布记录。

Main Features and Bug Fix Lists

Main Features

基础镜像PPU SDK升级至 2.0.0。

vLLM镜像发布 vLLM0.12.0、vLLM0.14.0、vLLM0.15.0、vLLM0.16.0 和 vLLM0.18.0 五个版本镜像。

SGLang镜像发布 SGLang0.5.6、SGLang0.5.7、SGLang0.5.8 和 SGLang0.5.9 四个版本镜像。

vLLM0.14.0、vLLM0.15.0、vLLM0.16.0、vLLM0.18.0 和 SGLang0.5.7、SGLang0.5.8、SGLang0.5.9 镜像的 Torch 版本升级至 2.9。

Bug Fix

vLLM0.16.0 修复了如下问题:

修复GLM-5 回答乱码问题。

修复Qwen3.5-35B-A3B 模型 TP=2 时服务启动失败问题。

SGLang0.5.9 修复了如下问题:

修复社区 bench_serving 在测试图片+文本混合随机输入时,偶现的越界问题。

修复GLM4.5V tp_size==8 时启动报错的问题。

修复社区 Deepseek-V3.2 使用 NSA 后端时,未根据设备类型选择计算接口导致的报错。

修复了Qwen3 混合 Int8/BF16 量化模型(前 90 层 Int8,后 4 层 BF16)的支持。

修复

_fwd_kernel_ep_scatter_1triton kernel 中因 warp racing 未有同步导致数据不一致问题。修复社区 DeepSeek awq/gptq量化获取不到weight的问题。

修复社区MTP draft model与target model量化方法不一致时,draft model走到不支持的量化方法的问题。

Contents

镜像名称 | inference-xpu-pytorch | ||||||||

镜像Tag | 26.01-v2.0.0-vllm0.12.0-torch2.8-cu129-20260127 | 26.01-v2.0.0-sglang0.5.6-torch2.8-cu129-20260126 | 26.01-v2.0.0-vllm0.14.0-torch2.9-cu129-20260209 | 26.01-v2.0.0-sglang0.5.7-torch2.9-cu129-20260209 | 26.01-v2.0.0-vllm0.15.0-torch2.9-cu129-20260212 | 26.01-v2.0.0-sglang0.5.8-torch2.9-cu129-20260212 | 26.01-v2.0.0-vllm0.16.0-torch2.9-cu129-20260316 | 26.01-v2.0.0-sglang0.5.9-torch2.9-cu129-20260316 | 26.01-v2.0.0-vllm0.18.0-torch2.9-cu129-20260330 |

应用场景 | 大模型推理 | 大模型推理 | 大模型推理 | 大模型推理 | 大模型推理 | 大模型推理 | 大模型推理 | 大模型推理 | 大模型推理 |

框架 | pytorch | pytorch | pytorch | pytorch | pytorch | pytorch | pytorch | pytorch | pytorch |

Requirements | PPU SDK V2.0.0 | PPU SDK V2.0.0 | PPU SDK V2.0.0 | PPU SDK V2.0.0 | PPU SDK V2.0.0 | PPU SDK V2.0.0 | PPU SDK V2.0.0 | PPU SDK V2.0.0 | PPU SDK V2.0.0 |

系统组件 |

|

|

|

|

|

|

|

|

|

镜像Asset

建议您使用VPC方式加速拉取AI容器镜像,减少镜像拉取的时间。

公网镜像

egslingjun-registry.cn-wulanchabu.cr.aliyuncs.com/egslingjun/inference-xpu-pytorch:26.01-v2.0.0-vllm0.12.0-torch2.8-cu129-20260127

egslingjun-registry.cn-wulanchabu.cr.aliyuncs.com/egslingjun/inference-xpu-pytorch:26.01-v2.0.0-sglang0.5.6-torch2.8-cu129-20260126

egslingjun-registry.cn-wulanchabu.cr.aliyuncs.com/egslingjun/inference-xpu-pytorch:26.01-v2.0.0-vllm0.14.0-torch2.9-cu129-20260209

egslingjun-registry.cn-wulanchabu.cr.aliyuncs.com/egslingjun/inference-xpu-pytorch:26.01-v2.0.0-sglang0.5.7-torch2.9-cu129-20260209

egslingjun-registry.cn-wulanchabu.cr.aliyuncs.com/egslingjun/inference-xpu-pytorch:26.01-v2.0.0-vllm0.15.0-torch2.9-cu129-20260212

egslingjun-registry.cn-wulanchabu.cr.aliyuncs.com/egslingjun/inference-xpu-pytorch:26.01-v2.0.0-sglang0.5.8-torch2.9-cu129-20260212

egslingjun-registry.cn-wulanchabu.cr.aliyuncs.com/egslingjun/inference-xpu-pytorch:26.01-v2.0.0-vllm0.16.0-torch2.9-cu129-20260316

egslingjun-registry.cn-wulanchabu.cr.aliyuncs.com/egslingjun/inference-xpu-pytorch:26.01-v2.0.0-sglang0.5.9-torch2.9-cu129-20260316

egslingjun-registry.cn-wulanchabu.cr.aliyuncs.com/egslingjun/inference-xpu-pytorch:26.01-v2.0.0-vllm0.18.0-torch2.9-cu129-20260330

VPC镜像

将指定的AI容器镜像Asset URIegslingjun-registry.cn-wulanchabu.cr.aliyuncs.com/egslingjun/{image:tag}替换为acs-registry-vpc.{region-id}.cr.aliyuncs.com/egslingjun/{image:tag}即可在VPC内快速拉取PPU AI容器镜像。

{region-id}:ACS产品开服地域(包括金融云、政务云等)的地域ID。例如:cn-beijing、cn-wulanchabu、cn-shanghai-finance-1等。{image:tag}:AI容器镜像的名称和Tag。例如:inference-xpu-pytorch:25.11-v1.7.0-vllm0.10.2-torch2.8-cu129-20251113、training-xpu-pytorch:25.11等。

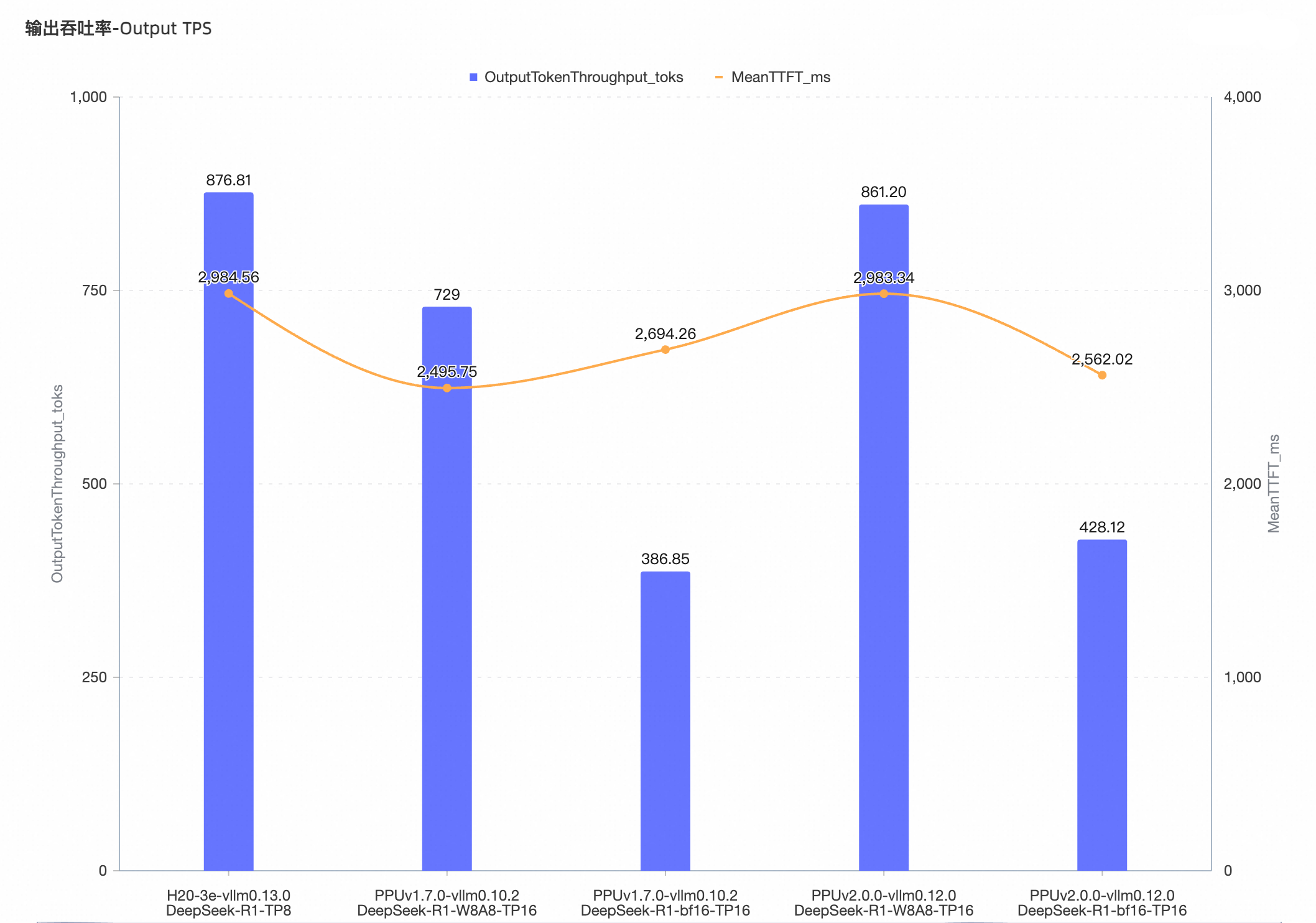

E2E性能评估

vLLM在线推理模式下,设置输入输出Token长度为4096/2048,控制TTFT < 3s 且 TPOT < 100ms,测试满足条件的最大并发量,对比吞吐。

DeepSeek-R1-bf16 :真武810E 单机 output token throughput 是 V1.7.0 的 110%。

DeepSeek-R1-W8A8:真武810E 单机 output token throughput 是 V1.7.0 的 118%。

Quick Start

以下示例内容仅通过Docker方式拉取inference-xpu-pytorch镜像,并使用Qwen2.5-7B-Instruct模型测试推理服务。

在ACS中使用inference-xpu-pytorch镜像可以通过控制台创建工作负载时输入指定镜像地址,或者通过YAML文件指定镜像引用。

在ACS环境下使用xpu大模型推理镜像的使用指导,请参见ACS集群形态的LLM大模型推理镜像使用指导。

在ACS环境下部署DeepSeek推理服务的使用指导,请参见在ACS中使用PPU快速部署DeepSeek V3/R1推理服务。

拉取推理容器镜像。

建议您使用VPC方式加速拉取AI容器镜像,减少镜像拉取的时间。

docker pull egslingjun-registry.cn-wulanchabu.cr.aliyuncs.com/egslingjun/inference-xpu-pytorch:[tag]从ModelScope下载开源模型。

pip install modelscope cd /mnt modelscope download --model Qwen/Qwen2.5-7B-Instruct --local_dir ./Qwen2.5-7B-Instruct启动以下命令进入容器。

docker run -d -t --network=host --privileged --init --ipc=host \ --ulimit memlock=-1 --ulimit stack=67108864 \ -v /mnt/:/mnt/ \ egslingjun-registry.cn-wulanchabu.cr.aliyuncs.com/egslingjun/inference-xpu-pytorch:[tag]执行推理测试,测试vLLM推理对话功能。

启动Server端服务。

python3 -m vllm.entrypoints.openai.api_server \ --model /mnt/Qwen2.5-7B-Instruct \ --trust-remote-code --disable-custom-all-reduce \ --tensor-parallel-size 1在Client端进行测试。

curl http://localhost:8000/v1/chat/completions \ -H "Content-Type: application/json" \ -d '{ "model": "/mnt/Qwen2.5-7B-Instruct", "messages": [ {"role": "system", "content": "你是个友善的AI助手。"}, {"role": "user", "content": "介绍一下深度学习。"} ]}'输出如下所示:

更多关于vLLM的使用方法,请参见vLLM。

使用建议

SDK 2.0.0 各框架支持的标准量化能力:

SAIL vLLM 0.12.0/0.14.0/0.15.0/0.16.0/0.18.0 支持的标准量化能力:per-token/per-channel w8a8(int8)

目前 SAIL vLLM 0.12.0/0.14.0/0.15.0/0.16.0/0.18.0 暂未对 Marlin kernel 进行适配和优化,AWQ(w4a16)、GPTQ (w4a16、w8a16)、mxfp4 性能较差,请使用 int8 w8a8 量化方案。

SAIL SGLang 0.5.6/0.5.7/0.5.8/0.5.9 支持的标准量化能力:per-token/per-channel w8a8(int8)、AWQ(w4a16)、GPTQ (w4a16、w8a16)

目前 SAIL SGLang 0.5.6/0.5.7/0.5.8/0.5.9 AWQ 和 GPTQ 未深度优化存在性能问题,后续视业务需要进行针对性优化。建议优先使用PTG提供的int8量化方案。运行 a8w8(int8)量化模型需要加

--quantization w8a8_int8选项。A8W8(INT8)量化演示模型

提供适配SDK2.0的量化模型示例,系统登录账密复用 PTG PIP 账密(如无,可联系您的客户经理获取):

DeepSeek-R1:支持 per-token/per-channel a8w8(int8)量化方案

DeepSeek v3.2:支持 per-token/per-channel a8w8(int8)量化方案

Kimi-K2-Instruct:支持 per-token/per-channel a8w8(int8)量化方案

Qwen3-235B-A22B:支持 per-token/per-channel a8w8(int8)量化方案

GLM-5:支持 per-token/per-channel w8a8(int8)量化方案

MiniMax-M2.5:支持 per-token/per-channel w8a8(int8)量化方案

Qwen3.5-397B-A17B:支持 per-token/per-channel w8a8(int8)量化方案

建议配合最新版本驱动使用本镜像获得最佳性能,设置方法请参考为ACS GPU Pod指定GPU型号和驱动版本和GPU驱动版本说明。

在ACS环境使用AcclEP-P(即PPU版本的DeepEP),需要设置环境变量

export EIC_VSOLAR=1(本镜像需要设置,预计后续镜像移除该限制)。本镜像内置环境变量

NCCL_SOCKET_IFNAME需要根据使用场景动态调整:当单Pod只申请了1/2/4/8卡进行推理任务时:需要设置

NCCL_SOCKET_IFNAME=eth0(本推理镜像内默认配置)。当单Pod申请了整机的16卡(此时您可以使用HPN高网)进行推理任务时:需要设置

NCCL_SOCKET_IFNAME=hpn0。

本镜像建议配合使用“阿里云提供的PPU PIP服务”,支持在ACS VPC内一站式免密使用PIP服务,不需要再组合使用其他PIP源。本镜像内已经内置了相应的pip config,还需要您结合您的使用场景根据文档的指引做必要的配置。

在对TTFT有严格要求的场景下,可以添加sever args:

--no-async-scheduling以降低TTFT。

Known Issues

vLLM0.12.0/0.14.0/0.15.0/0.16.0镜像

在 DP + EP 模式,使用 DeepEP low latency 的情况,对于 Qwen3 MoE BF16 存在精度问题。社区同样存在该精度问题。

Kimi-linear 模型使用DeepGemm将会导致server启动失败。请使用Acext MoE backend。

# 设置环境变量,使用Acext MoE backend export VLLM_USE_DEEP_GEMM=0 export USE_ACEXT_CUDA=1如果使用 DeepGemm backend,server 启动阶段则会自动进行 warmup,编译出需要用到的 DeepGemm kernel,可能会带来较长的 warmup 时间:

warmup时间较长。推荐做法是通过环境变量指定deepgemm cache 路径:

export DG_CACHE_DIR=<your-path>,从而避免重复编译。可以通过

export VLLM_DEEP_GEMM_WARMUP="skip"跳过 DeepGemm warmup,测试性能过程中请确保未出现 DeepGemm JiT 编译,否则会导致性能下降。

SGLang0.5.6/0.5.7/0.5.8/0.5.9镜像在server启动阶段会自动进行warmup,编译出需要用到的DeepGemm kernel,有以下注意事项:

warmup时间较长,推荐通过

--watchdog-timeout和--dist-timeout增加server超时时间,例如--watchdog-timeout 3600 --dist-timeout 3600。可通过

SGLANG_JIT_DEEPGEMM_PRECOMPILE关闭deepgemm warmup,测试性能过程中请确保未出现DeepGemm JiT编译,否则会导致性能下降。

附录

vLLM 0.16.0已知问题

社区vLLM在0.16.0上并未支持Qwen3.5系列模型,PPU进行了部分支持,但无法支持Qwen3.5系列模型的所有功能和场景。可能会遇到的问题包括但不限于:

开启MTP功能后概率性fail。

bfcl_v3 精度测试(enable tool call功能)fail。

为适配GLM-5和Qwen3.5系列模型,transformers版本已升级到5.2.0。此版本不支持Qwen VL模型, 运行Qwen VL模型需要将transformers版本降到4.57.1。

DP+EP+DeepEP low latency问题:

第一次启动server需要设置

export VLLM_ENGINE_READY_TIMEOUT_S=6000,否则server会启动失败。社区在GU8TF卡型上会存在相同问题。对于 Qwen3 MoE BF16 的场景存在精度问题。社区同样存在该精度问题。

MiniMax-M2.5模型 TP=16 时会导致服务启动失败,请使用TP=8 运行int8量化权重。

MiniMax-M2模型ifeval精度测试得分较低,GU8TF卡型上同样存在该问题。

--gpu_memory_utilization的值高于0.96时,低概率会因Driver OOM出现segment fault。Flashinfer Sampler可能会导致精度掉点。如遇到模型精度掉点问题,可通过

export VLLM_USE_FLASHINFER_SAMPLER=0关闭该功能。Kimi-linear模型存在精度问题,社区同样存在精度问题。

Kimi-linear | DeepSeek-OCR 系列 模型使用 DeepGemm 将会导致 server 启动失败。请设置环境变量,使用 Acext MoE backend。

# 设置环境变量,使用Acext MoE backend export VLLM_USE_DEEP_GEMM=0 export VLLM_MOE_USE_ACEXT=1 export VLLM_DENSE_USE_ACEXT=1 export ACEXT_NUM_TOKENS_LIMIT=16385如果使用 DeepGemm backend,Server 启动阶段则会自动进行warmup,编译出需要用到的 DeepGemm kernel,可能会带来较长的 warmup 时间:

warmup时间较长,推荐通过环境变量指定deepgemm cache 路径:

export DG_CACHE_DIR=<your path>,从而避免重复编译。可以通过

export VLLM_DEEP_GEMM_WARMUP="skip"跳过 DeepGemm warmup,测试性能过程中请确保未出现 DeepGemm JiT 编译,否则会导致性能下降。

量化方面,目前 SAIL vLLM 0.16.0 暂未对 Marlin kernel 进行适配和优化,AWQ(w4a16)、GPTQ (w4a16、w8a16)、mxfp4 性能较差,请使用 int8 w8a8 量化方案。

SGLang 0.5.9已知问题

SGLang 0.5.9在server启动阶段会自动进行warmup,编译出需要用到的DeepGemm kernel,有以下注意事项:

warmup时间较长,推荐通过

--watchdog-timeout和--dist-timeout增加server超时时间,例如--watchdog-timeout 3600 --dist-timeout 3600。可通过

SGLANG_JIT_DEEPGEMM_PRECOMPILE关闭deepgemm warmup,测试性能过程中请确保未出现DeepGemm JiT编译,否则会导致性能下降。

为适配GLM-5和Qwen3.5系列模型,transformers版本已升级到5.2.0。此版本不支持Qwen VL模型, 运行Qwen VL模型需要将transformers版本降到4.57.1。

vLLM0.18.0已知问题

GLM-5模型运行需要升级

transformers==5.2.0。DP+EP+DeepEP low latency问题:

第一次启动server需要设置

export VLLM_ENGINE_READY_TIMEOUT_S=6000,否则可能会因DeepGemm warmup编译超时导致server启动失败。社区在GU8TF卡型上存在相同问题。对于 Qwen3 MoE BF16 的场景存在精度问题。社区同样存在该精度问题。请不要使用DP+EP+DeepEP low latency这种组合启动Qwen3 MoE BF16 模型权重。

MiniMax-M2.5模型 TP=16 时会导致服务启动失败,请使用TP=8 运行int8量化权重。

--gpu_memory_utilization的值高于0.96时,低概率会遇到OOM问题,导致出现segment fault错误。开启Flashinfer Sampler可以获得性能提升,但可能会导致精度掉点(默认关闭该功能)。社区同样存在该问题。可通过

VLLM_USE_FLASHINFER_SAMPLER环境变量控制该功能的开启或关闭。如果使用 DeepGemm backend,server 启动阶段则会自动进行 warmup,编译出需要用到的 DeepGemm kernel,可能会带来较长的 warmup 时间:

warmup时间较长。推荐做法是通过环境变量指定deepgemm cache 路径:

export DG_CACHE_DIR=<your path>,从而避免重复编译。可以通过

export VLLM_DEEP_GEMM_WARMUP="skip"跳过 DeepGemm warmup,测试性能过程中请确保未出现 DeepGemm JiT 编译,否则会导致性能下降。

量化方面,目前 SAIL vLLM 0.18.0 暂未对 Marlin kernel 进行适配和优化,AWQ(w4a16)、GPTQ (w4a16、w8a16)、mxfp4 性能较差,请使用 int8 w8a8 量化方案。